千元机实测Gemma 4:生成一次需5分钟,本地AI或成旗舰专属

2024年4月,谷歌推出新一代开源大模型Gemma 4,一次性发布四种规格版本,覆盖手机到工作站,其中最小的两个版本专为移动设备设计,主打完全离线运行。这并非新鲜事,但关键在于谷歌此次意在让手机运行本地模型。

或许大家已刷到不少Gemma 4实装测试内容,不过网上现有测试基本在最新款iPhone或旗舰机上进行,这些旗舰本就属于性能与算力第一梯队,表现出色也在情理之中。

此时小雷不禁发问:若使用一台几百到一千多元的普通安卓机,配备中端处理器、算力不算顶尖,本地模型还能否正常使用?与旗舰机相比,差距究竟有多大?

往更深层次看,本地AI是否注定只能是旗舰手机的专属功能?为弄清此事,我们直接拿一台搭载中端芯片的千元安卓机实测Gemma 4,看看其表现究竟如何。

千元机运行本地模型,体验堪称“拉胯”

本次测试选用vivo Y500 Pro,这是一款典型的千元安卓机,虽非老机型,但SoC整体性能偏一般,毕竟定价在此,也没什么好说的。它搭载联发科天玑7400,采用台积电4nm制程,CPU配置为4个2.6GHz大核加4个2.0GHz小核,GPU为Mali - G615 MC2。

这套配置在千元价位段属正常水平,日常使用无问题,但与当前旗舰芯片比算力,完全不在一个量级。AI方面,天玑7400采用联发科NPU 655,官方称比上一代提升15%。

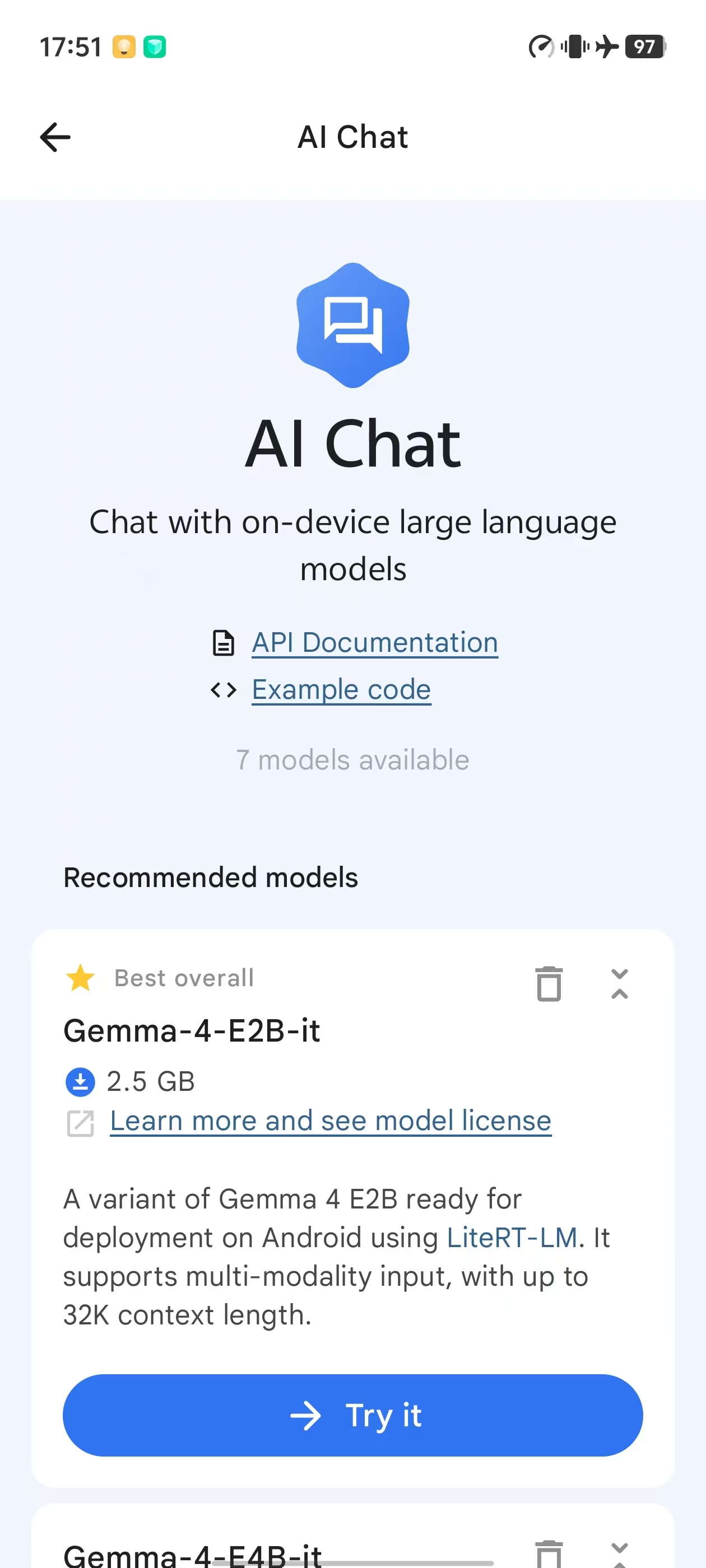

谷歌为Gemma 4手机端版本推出名为Google AI Edge Gallery的App,应用商店可直接搜索下载。下载打开后,选择Gemma 4 E4B,等模型文件下载完成,即可直接使用,全程离线,无需联网,也无需任何配置。谷歌在安装体验上做得挺用心。话不多说,直接开测。

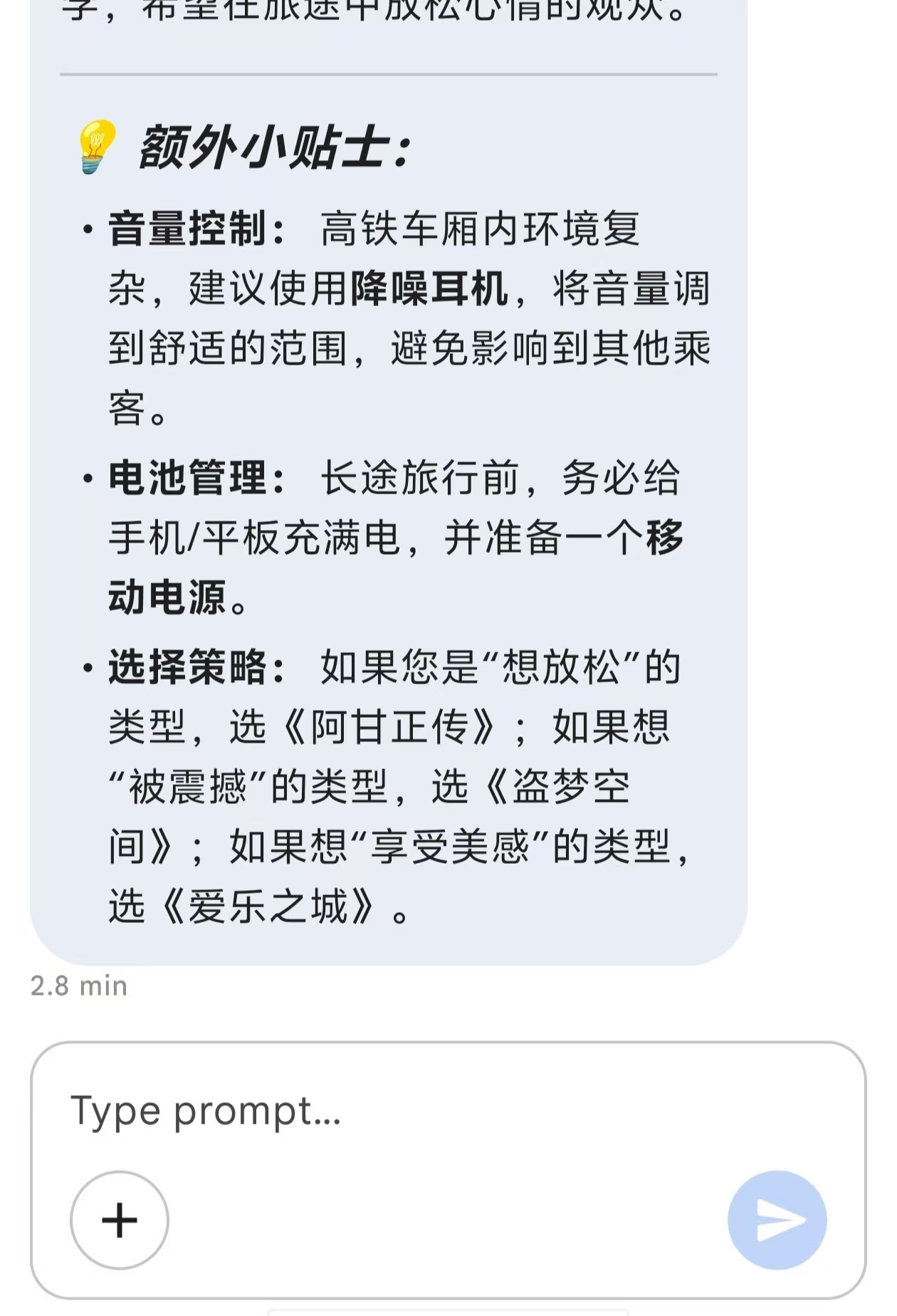

第一题我们问了一个生活化问题:推荐三部适合在长途高铁上看的电影,并说明理由。Gemma 4给出的答案是《阿甘正传》《盗梦空间》和《爱乐之城》,选片本身没问题,三部都很经典,推荐理由也合理,但问题是它给出了近500字的回答,还额外附上一条“小贴士”,比如高铁上看电影记得带耳机。

在vivo Y500 Pro上,这500字足足跑了2.8分钟,说实话,小雷看完才发现后半段根本没必要读。

这其实是小参数模型的常见问题,回答时往往不知何时该停止,偶尔还会用“建议”凑字数,仔细读会发现两三句话就能总结完。

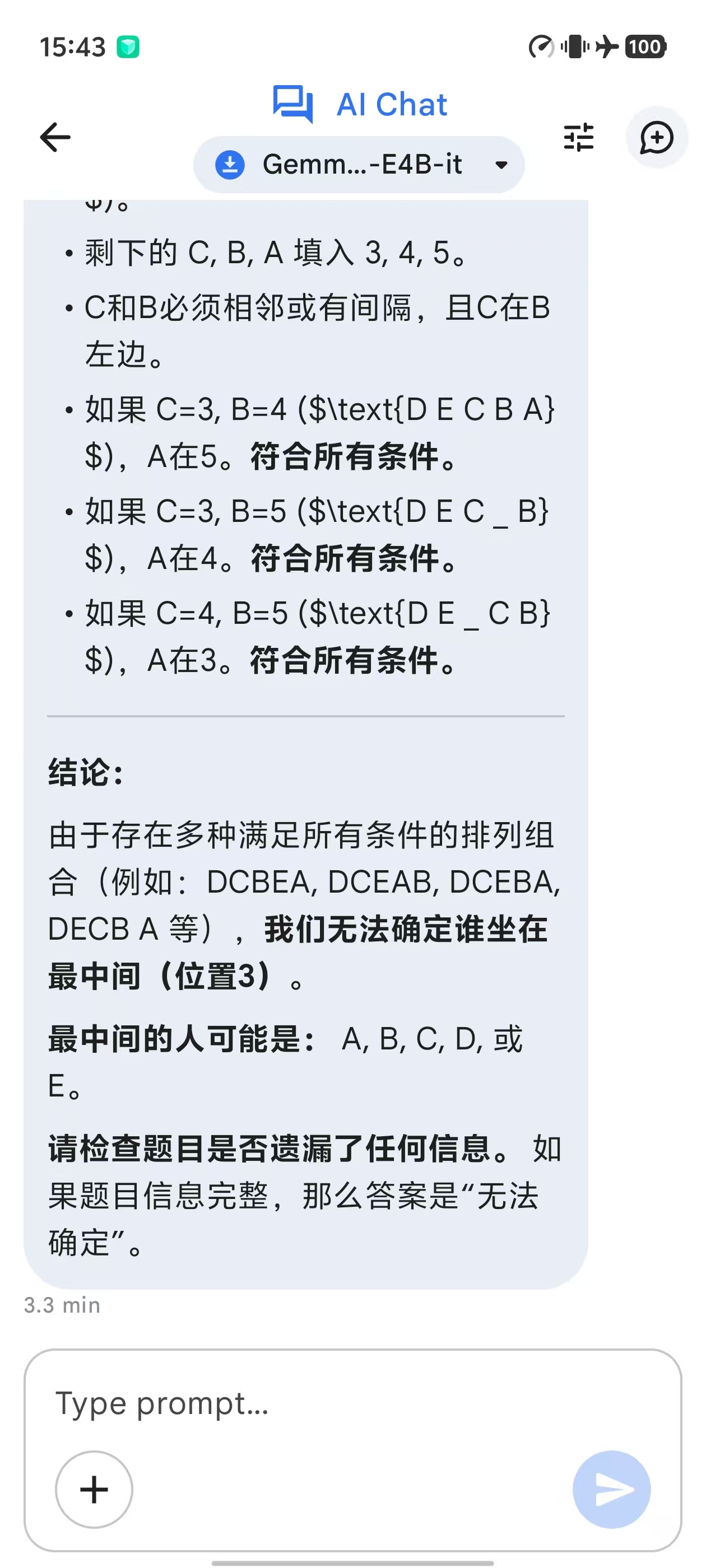

接下来我们选了一道经典多步逻辑推理题:五个人坐成一排,A不坐在最左边,B坐在C的右边,D坐在E的左边,E不坐在最右边,请问谁坐在最中间?虽然它认真地一步步列条件、排列组合,但最终给不出正确答案,甚至耗时3.3分钟,过程中不能退到后台等待,必须一直亮屏,这3.3分钟彻底被浪费。

当然,这不能怪Y500 Pro性能不足,我们在X300 Pro这款旗舰机型上也没得出正确答案,但X300 Pro回答速度几乎是碾压级的,1.6分钟就给出错误答案,就算错也错得干脆。

同样,小雷还尝试了之前难倒一大片AI大模型的经典问题:洗车应该开车去还是走路去?令人意外的是,两款手机在同一模型下有不同思考。Y500 Pro花了2.5分钟,告诉我们“如果你是为了‘洗车’去的,那应该选择走路”,这回答令人啼笑皆非。

而X300 Pro中间绕了些弯子,似乎也在反复确认“洗车”是否需要车,但最后提到,假如要去洗车,还是要开车去。

跑完这三道题,Y500 Pro上的Gemma 4 E4B给我们的整体印象是慢、废话多,但不怎么发烫。

慢是最直观的感受,每道题平均要等两到三分钟才能看到完整回答。这个速度在日常使用中很难受,没人愿意盯着屏幕干等三分钟只为看一个答案。不过有个细节值得说,慢不是因为模型没在跑,而是天玑7400的NPU算力实在有限,每秒能处理的token数就那么多,再努力也只能是这个速度。

出错率也挺高,但情有可原。模型处理复杂逻辑时,需要在中间步骤反复“思考”,算力越充裕,这个过程越完整,而在千元机上,这个过程很可能没走完就被迫给出结论,因为算力有限,若给推算分配太多资源,后续就难以为继,所以更容易出现幻觉。

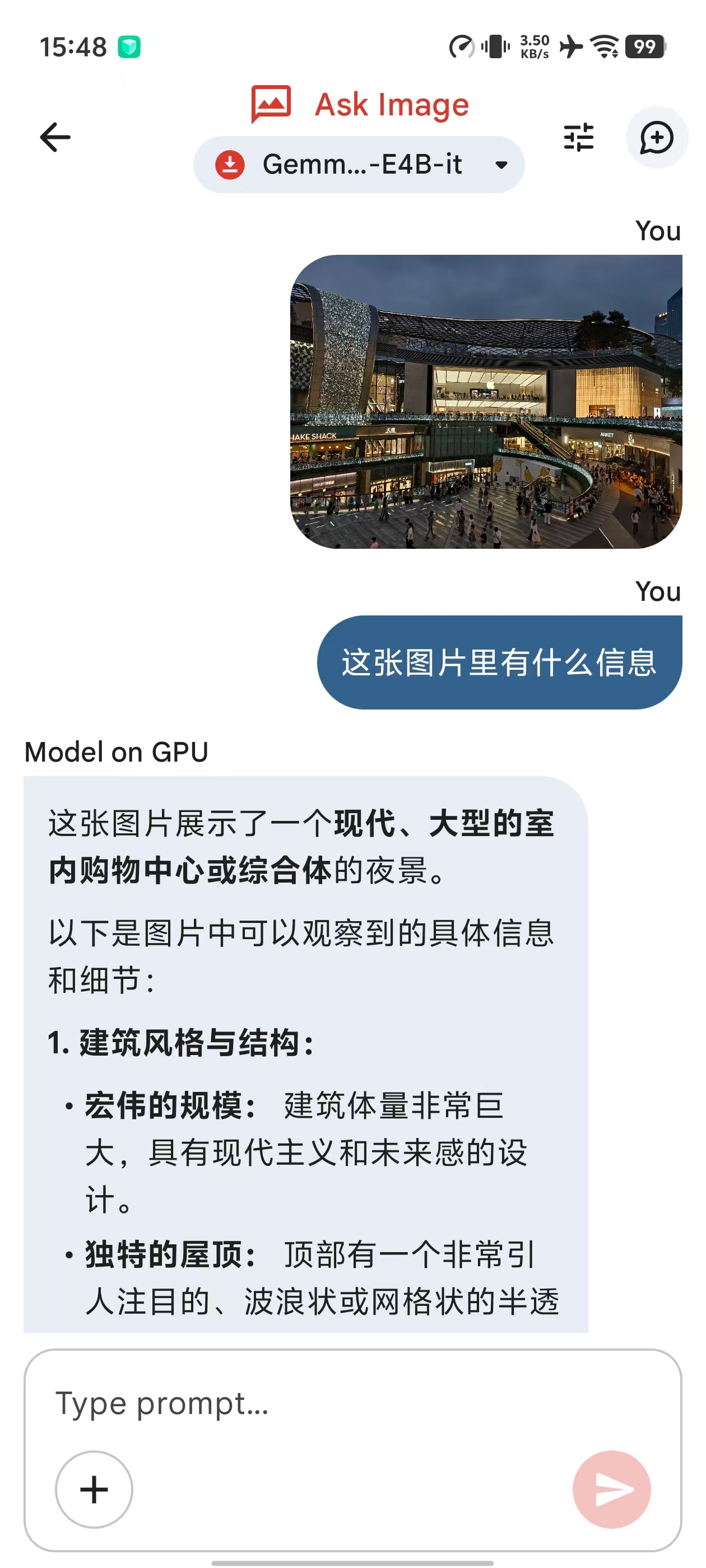

Gemma 4 E4B是多模态模型,我们也让Y500 Pro试试识图效果。先丢一张夜景购物中心的照片进去,问图里有什么信息。

回答还算过得去,描述了建筑规模、屋顶结构、夜景氛围,方向是对的,但有个明显问题,图里那么大的Apple Store招牌,它完全没提到,只说了“现代大型购物中心”。品牌识别对模型要求很高,需要将看到的视觉信息和背后的品牌知识对应起来,E4B这个参数量显然不够用,能看出轮廓,但认不出品牌。

第二张图,我们随手拍了个绿植图片问是什么,然后它就开始转圈。整整五分钟,没有任何回答,只有一直在转的加载动画,更崩溃的是,这段时间里整个App完全无法操作,不能打断只能干等。其实这张图片就是非常简单的地插式喷头,浇花用的,并非罕见装置。

那X300 Pro能否正确识别呢?其实可以,X300 Pro仅用32秒就回答了这个难倒Y500 Pro的问题,可惜它没能准确说出装置是什么,只是猜测这是一个小型传感器。

跑完这三轮测试,Y500 Pro上的Gemma 4 E4B并没有像我们想象中那样完全无法运行,相反还有点小惊喜,比如基本不发烫、也不是很卡顿,一些简单问题能正确回答。但问题在于,作为本地模型,回答速度实在太慢,目前Google AI Edge Gallery权限也不够,除了开关手电筒,做不了其他系统级操作。

这就很尴尬了,若只能达到这样的水平,回答速度慢、还容易出错,用户为什么还要继续使用呢?说白了,除非真到了彻底断网的场景,否则还不如在线大模型好用。

本地模型,普通手机真的能用吗?

从前面的测试来看,Gemma 4目前确实得旗舰手机才能达到“及格线”标准,尽管仍有出错情况,但至少速度不拖沓,不像千元机那样又慢又不准。

但回过头看,谷歌做这个App,背后到底在布局什么?

Google AI Edge Gallery里有个叫Mobile Actions的功能,可将自然语言指令直接转化为对Android系统的操作,比如“帮我创建一个午餐日历事件”或者“打开手电筒”,模型理解意图后,直接调用系统工具完成。

这条路其实已在旗舰手机上开始走,三星Galaxy S25系列推出跨应用执行链,只用一句话就能让多个App协同工作,比如“帮我导航到今晚开会的地方”,AI会自动从日程表读取地址,再直接传给地图,整个过程无需复制粘贴,也无需手动切换。还有此前全网爆火的豆包手机,更是实现了“手机自动驾驶”。

但有个重要事实需说清楚,这些自动化操作大部分并非真正意义上的本地模型在运行。三星、苹果,甚至豆包手机都是如此。

本质上,本地模型的能力上限摆在那里,参数量越小能做的事情越少,而用户对AI的期待越来越高,单靠本地根本撑不起需求。所以云端成了兜底方案,本地模型更多承担一些轻量、实时的任务,比如通知总结、语音识别这类对速度要求高的场景。

所以,谷歌这款App更像是在试水本地模型进入移动端,逐步开放自动化操作手机的功能权限,让尽可能多的设备能运行起来,然后等芯片算力跟上来。但芯片厂商何时愿意把真正够用的AI算力下放到千元机价位?毕竟旗舰手机从来都不是手机市场的销量大头。

联发科、高通这几年每代新旗舰芯片发布,都会重点强调NPU算力提升多少倍、AI性能比上一代强多少,可中低端芯片往往不重视这些,能效才是它们更在意的。因此,普通用户能否用上真正好用的本地AI,取决于整个产业链有没有足够动力推动这件事。谷歌在软件层面开了个口子,接下来就要看芯片厂商和手机厂商如何接招了。

本文来自“雷科技”,36氪经授权发布。

本文仅代表作者观点,版权归原创者所有,如需转载请在文中注明来源及作者名字。

免责声明:本文系转载编辑文章,仅作分享之用。如分享内容、图片侵犯到您的版权或非授权发布,请及时与我们联系进行审核处理或删除,您可以发送材料至邮箱:service@tojoy.com