美国AI公司热衷选用中国大模型

如今,“媚外”之风竟吹到了大洋彼岸的AI圈。国外头部AI编程产品Windsurf最近有个有趣的发现。

它在自家产品里上新了一个号称专门为速度和Agentic设计的神秘模型。许多人好奇这个模型的来历,按常理,其背后公司Codeium是美国本土企业,接入的大模型大概率来自OpenAI、Anthropic或谷歌。

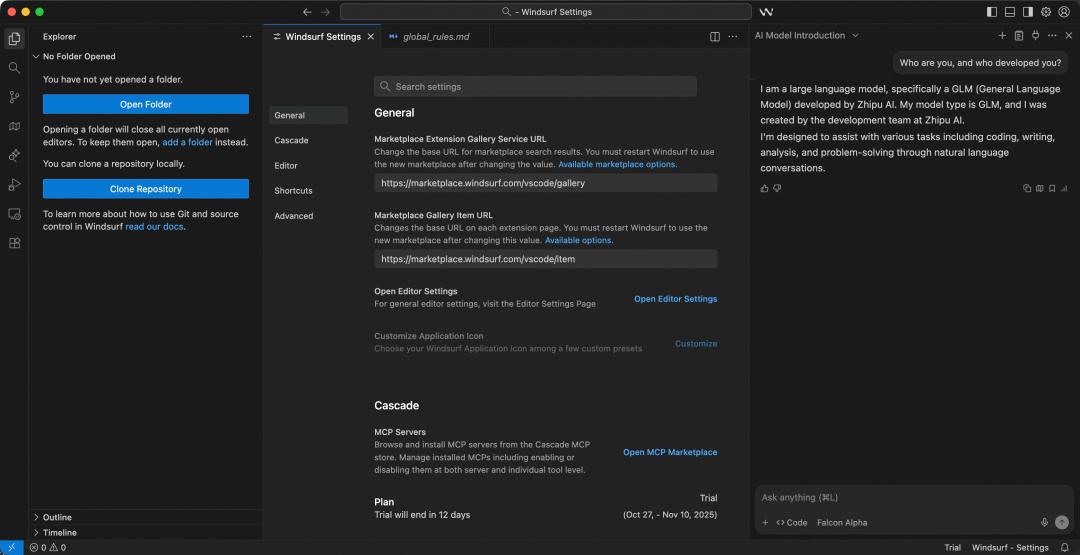

然而,网友尝试越狱后发现,这个神秘模型来自中国,正是智谱的GLM。

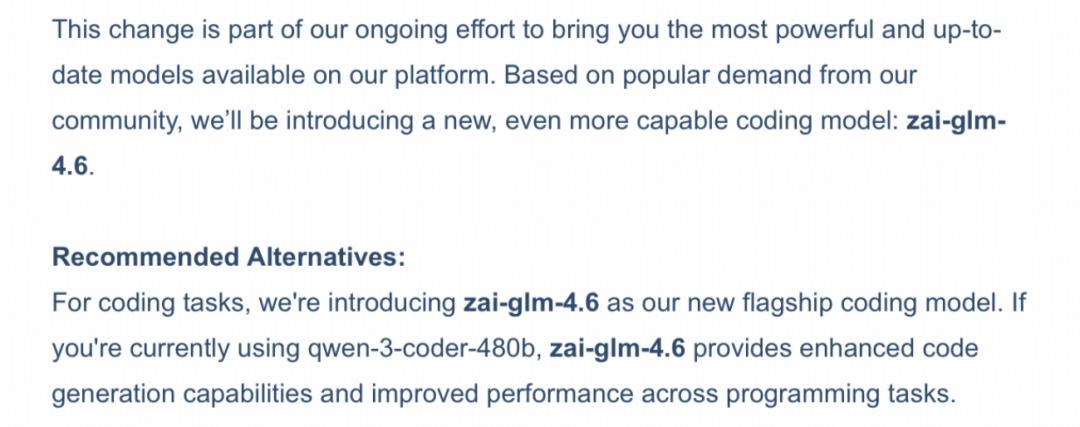

进一步了解还发现,有网友提到GLM 4.6在Cerebras上运行(Cerebras是去年发布全球最大AI训练芯片,后进军推理市场推出AI推理服务的公司)。原来,Cerebras前几天发邮件称已上架GLM - 4.6。

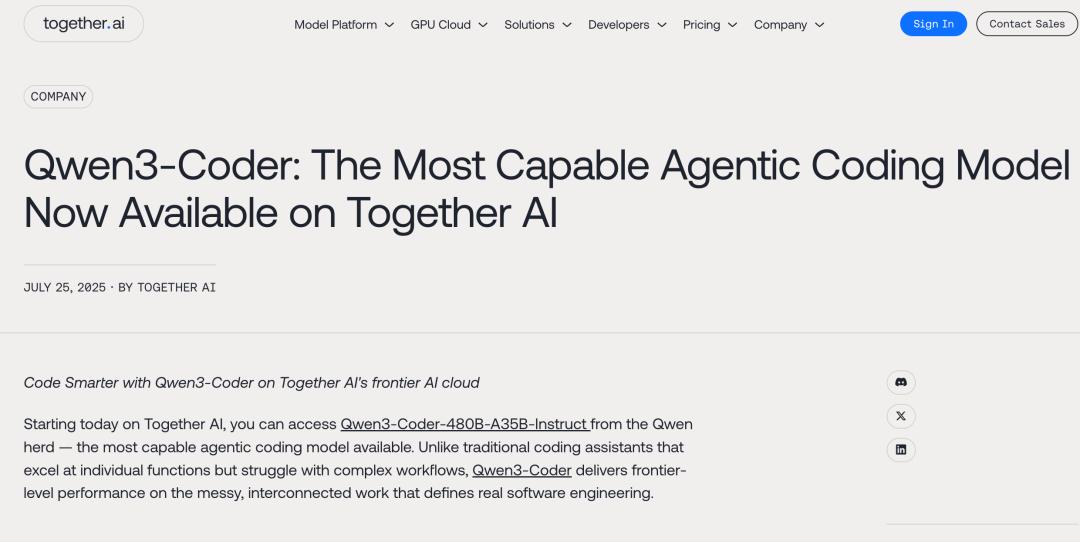

此外,在油管搜索相关关键词,能看到“中国的MiniMax M2挑战了商业模式”等内容。更早之前,美国云服务平台Together AI在今年7月官宣部署Qwen - 3 - Coder。

看来,美国的AI公司开始纷纷使用中国的大模型了。

这并非个例

前面提到的例子涉及GLM和Qwen3,领域包括AI编程和AI推理。深入挖掘发现,部署中国大模型并非少数情况。

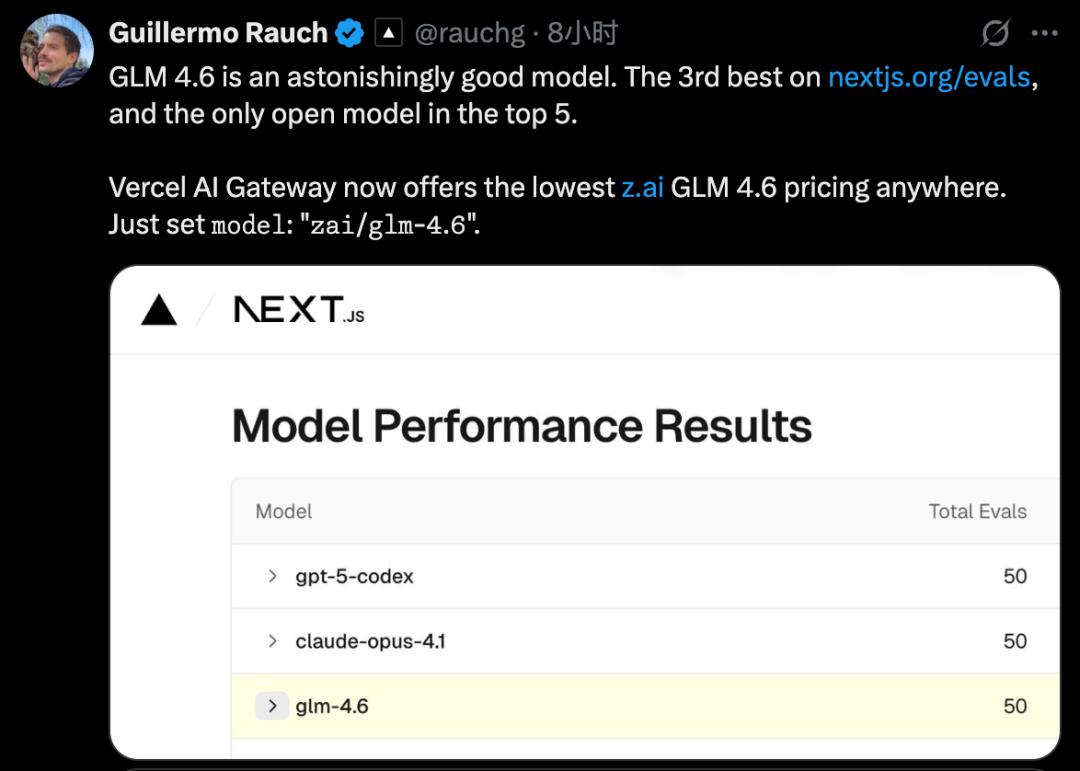

在AI Agent领域,估值93亿美元的Vercel表示已和智谱达成合作,提供GLM - 4.6的API服务。其老板Guillermo Rauch转发帖子并称赞GLM - 4.6很好,在http://nextjs.org/evals上排名第三,还是前五名里唯一开源的模型。

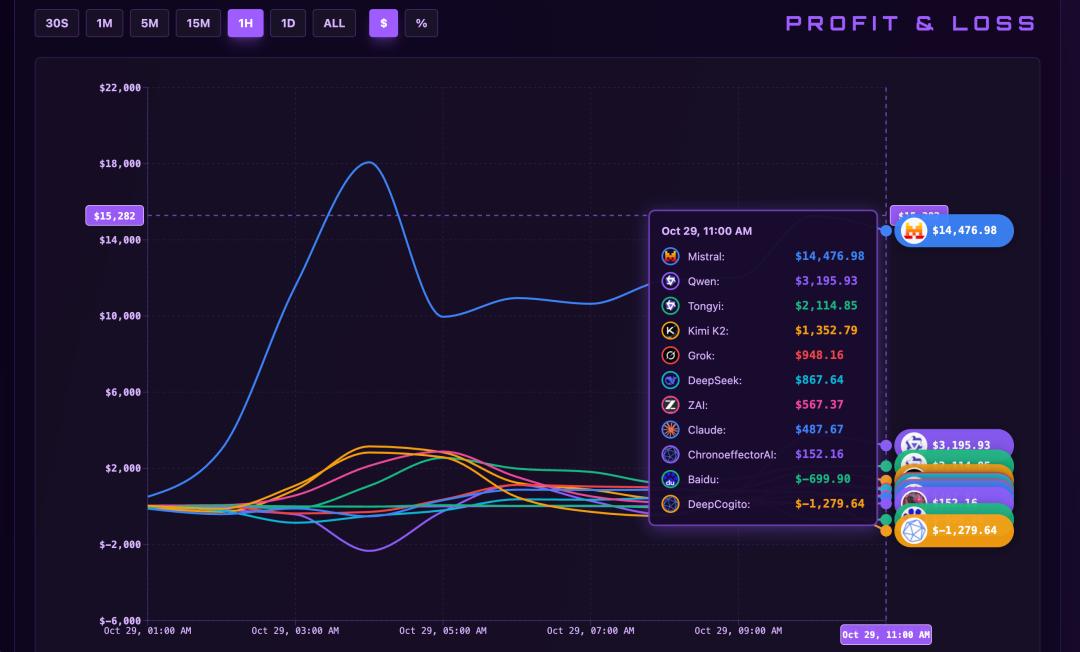

更早时,无服务器AI推理平台Featherless在Kimi K2发布时表示支持其新模型。最近爆火的让AI模拟炒股玩法中,各个国产大模型也陆续被采用。

很多人不禁要问,美国大模型性能强悍,为何纷纷选择中国国产大模型呢?

量大管饱,价格实惠

简单来说,“量大管饱又便宜”的原则在AI圈很受欢迎。

首先,性能过硬是关键原因。从Vercel公司老板对GLM - 4.6的称赞,以及今年以来DeepSeek、Qwen、K2等国产大模型在海外爆火且频频上榜,能看出国产大模型的实力得到了国内外AI玩家的认可。

其次是性价比。Social Capital公司创始人Chamath Palihapitiya直言,他们在Groq上已开始使用Kimi - K2,因为OpenAI和Anthropic的模型太贵。他解释,用编程工具时,Groq默认路由是Anthropic,虽性能好但价格高昂。而且公司发展时,将提示词传给不同大模型需长时间微调设计,这让消费者很痛苦。

总体来看,性价比是美国AI公司选择中国大模型的关键因素。中国AI厂商在价格竞争上经验丰富,近期动作不断:快手AT - Coder - Air - V1注册就送2000万token;智谱在1024程序员节推出GLM Coding Plan包月套餐折上折,新人5折;Kimi在程序员节针对程序员推出优惠套餐;MiniMax M2将限时免费日期延至11月7号,快手也将免费日期延至11月10号。

这反映出AI产业正从技术炫技阶段迈向务实应用阶段。企业大规模部署AI功能时,成本、速度和可扩展性成为关键问题。Vercel和Social Capital等公司的选择,打破了“唯最强模型论”,证明高性价比的适用技术才是商业落地的关键。这场因“太贵了”而引发的务实选择,或许预示着全球AI新时代的到来,竞争将更加多元化和激烈。

大模型圈里,中国造的含金量正在不断上升。

参考链接:

[1]https://x.com/windsurf/status/1982619448352854428

[2]https://x.com/rauchg/status/1982973728423325803

[3]https://x.com/karminski3/status/1982945655548194923

[4]https://www.reddit.com/r/LocalLLaMA/comments/1ohdl9q/silicon_valley_is_migrating_from_expensive/?tl=es-419

本文来自微信公众号 “量子位”(ID:QbitAI),作者:金磊,36氪经授权发布。

本文仅代表作者观点,版权归原创者所有,如需转载请在文中注明来源及作者名字。

免责声明:本文系转载编辑文章,仅作分享之用。如分享内容、图片侵犯到您的版权或非授权发布,请及时与我们联系进行审核处理或删除,您可以发送材料至邮箱:service@tojoy.com