黄仁勋称其为“灾难”:DeepSeek在华为芯片上成功运行

DeepSeek V4的API定价已经公布——Flash版输入1元/百万token,Pro版12元。与此同时,GPT - 5.4和Claude Opus 4.6的调用成本大约是它的50倍。

这不是便宜一半,而是便宜50倍。这个数字大到让人感觉它们似乎不在同一场竞争中。

但价格本身并非重点。回顾前三代产品——V2的训练成本是GPT - 4 Turbo的1/70,V3是GPT - 4的1/14,R1是GPT - 4o的1/20。DeepSeek勾勒出了一条急剧下降的成本曲线。就连奥尔特曼自己也表示,AI成本每12个月下降10倍,比摩尔定律还要迅猛。

V4还带来了一个更大的变数:它在技术报告中明确将华为昇腾NPU与英伟达GPU并列进行验证,是首个在昇腾平台上原生适配的前沿大模型。黄仁勋在播客中称,这件事是“灾难性的”。英伟达的护城河并非GPU算力本身,而是CUDA作为默认起点的软件生态地位。

价格便宜50倍,还能在昇腾上运行。DeepSeek到底是怎么做到的?这条效率路线走到终点,又意味着什么?

50倍的价格差

DeepSeek V4的API定价如下:Flash版输入1元/百万token,输出2元;Pro版输入12元,输出24元。在缓存命中的情况下,Flash版输入价格可低至0.2元/百万token。

同期,GPT - 5.4和Claude Opus 4.6的API调用成本大约是V4的50倍。

V4基于MIT协议完全开源,发布时间恰好赶在OpenAI上线新Agent功能的前一天。贴身竞争的意味十分明显。

但V4的定价并非一次孤立的降价行为。回顾前三代产品,DeepSeek呈现出一条陡峭的成本下降曲线。

2024年初,V2的训练成本降至GPT - 4 Turbo的1/70,这得益于MLA架构和MoE稀疏架构的组合创新。同年年底,V3的训练成本为560万美元,相比GPT - 4的7800万美元降至1/14。紧接着,R1的训练成本为600万美元,与GPT - 4o约1.2亿美元的训练开支相比,压至1/20。

三代产品,每一代都在成本上降低一个数量级。这不是一次促销,而是一条持续下降的曲线。

一年前,R1发布当天,英伟达单日市值蒸发近6000亿美元,“DeepSeek时刻”成为整个科技圈的记忆点。V4则将这个故事又向前推进了一步。

当然,这条曲线并非没有争议。谷歌DeepMind负责人哈萨比斯直言DeepSeek的成本数据“被报小了,并且有些误导性”,声称该公司“只公布了最终训练阶段的成本,而这只是总成本的一小部分”。分析机构SemiAnalysis进一步估算,DeepSeek在硬件上的花费远高于5亿美元,论文中600万美元的数字只是预训练运行的GPU成本。

即便DeepSeek的硬件投入超过5亿美元,这也是一笔包含芯片采购在内的资本开支;而GPT - 4o约1.2亿美元的训练成本,指的是单次训练运行的算力费用,两者的统计口径并不相同。不过,即便将OpenAI背后数十亿美元的算力基础设施投入也纳入考量,DeepSeek在单次训练成本上的优势依然是数量级的。争议的焦点恰恰证明了一个结论:即便成本被低估,它仍然便宜得惊人。

这不仅仅是DeepSeek一家的故事。从GPT - 4到GPT - 4o,OpenAI自身的每token价格也下降了约150倍。即便降了这么多,DeepSeek的API价格仍然比OpenAI便宜95%。

奥尔特曼在2025年2月的文章中明确写道:使用特定水平AI的成本每12个月下降约10倍。摩尔定律曾以每18个月翻一倍的速度改变世界,而AI成本的下降“更加强劲”。

当你的竞争对手亲口为你的叙事提供论证时,这个叙事就不再仅仅是叙事了。AI行业正在经历属于自己的摩尔定律,而DeepSeek,是这条定律最积极的践行者。

定律背后的机制是什么?三代产品的成本为何能持续大幅下降?答案就藏在DeepSeek的技术路线中。

从算法延伸至芯片

V3训练仅使用了2048张H800。同级别模型的训练集群动辄需要上万张卡,但DeepSeek用这2048张卡就训练出了可与GPT - 4对标的模型,依靠的是一项当时没人敢在大规模训练中真正应用的技术:FP8混合精度。

英伟达的Transformer Engine早就支持FP8训练,但在V3之前,没有开源大模型真正在训练阶段成功运行FP8。DeepSeek成为第一个吃螃蟹的,通过细粒度量化策略,将激活值按1x128的tile量化、权重按128x128的block量化,在不损失模型质量的前提下大幅降低了计算成本。

武器不在于数量多,而在于会使用。2048张卡就能完成别人上万张卡的工作。

V4在这条路上又向前迈进了一大步,直接对注意力机制本身进行了改造。

核心是两种全新的注意力结构。CSA(压缩稀疏注意力)将每4个token的KV缓存压缩成1个条目,再通过一个名为Lightning Indexer的筛选器从所有压缩块中只挑选出最相关的512个进行计算。

HCA(层次化压缩注意力)更为激进,压缩比达到128倍,直接跳过筛选环节进行全量计算以捕捉全局结构。两种注意力交错配置,再配合滑动窗口保留最近128个token的原始KV,多管齐下降低了百万token长文本的推理开销。

深度求索方面直接表示:“从现在开始,百万上下文将是DeepSeek所有官方服务的标配。”以前百万token是各家发布会上用来展示技术的指标,现在则成为了默认参数。

当技术成本低到可以成为默认选项时,它就不再是竞争优势,而是基础设施的一部分。

效果直接体现在基准分数上。

V4 - Pro,1.6万亿参数、激活49B,在100万token上下文下处理一个新token所需的算力仅为V3.2的27%,KV缓存只占10%。资源消耗减少到原来的四分之一。

而顶配的Pro Max呢?在知识基准SimpleQA中获得57.9分,比开源最佳成绩高出20个点;在数学竞赛Putnam 2025中取得120/120的满分;在编程竞赛Codeforces中在人类选手中排名第23。三个完全不同类型的任务,同时达到了顶尖水平。

算力使用了四分之一,成绩却冲到了第一。这不是简单的降本增效,而是采用了一套全新的运行逻辑。

但V4最值得关注的变数,不在算法层面。

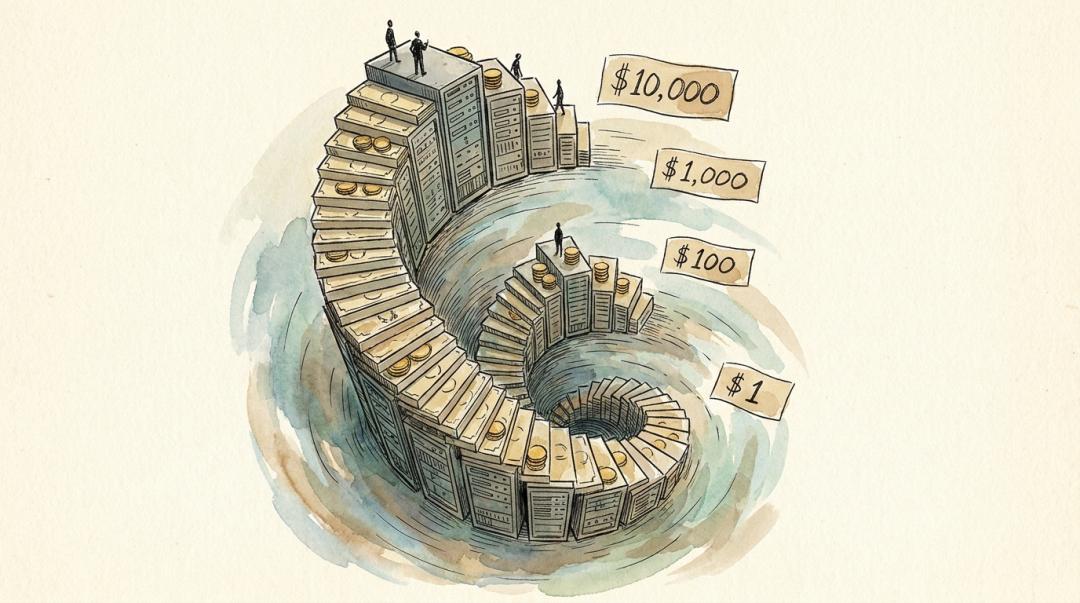

V4技术报告3.1节有这样一句话:“我们在NVIDIA GPU和华为昇腾NPU两个平台上验证了这个细粒度的专家并行方案。”两个平台并列,写在验证结论里。这不是“兼容适配”的表述,而是“原生支持”的姿态。

这套方案的核心是将MoE的通信和计算切成更细的颗粒按“波”调度,通用推理加速1.50到1.73倍,强化学习长尾小批次最高加速1.96倍。昇腾已经从备选项变成了并列选项。

迁移过程并不轻松。据接近DeepSeek的工程师透露,V4从CUDA到CANN的适配过程中,最耗时的不是算子重写,而是精度对齐。要让同样的模型在英伟达和昇腾上跑出完全一致的数学结果,需要反复调试。

此前使用910C训练时,DeepSeek遇到过问题:1024卡集群梯度同步超时、CANN旧版缺少关键算子,稳定性一度不足。950PR针对性地弥补了这些短板:芯片间带宽翻了3倍,CANN Next内置了FlashAttention和PagedAttention算子。

真正的技术迁移不是更换芯片品牌,而是让两套完全不同的硬件跑出相同的数学结果。DeepSeek打通了这条路,为后来者降低了一大截门槛。

华为的策略也很明确。昇腾950PR在FP4精度下算力达到2 PFLOPS,芯片间互联带宽2TB/s。CANN Next的定位不是推倒重来,而是无缝替换:新增的SIMT编程模型与CUDA高度对标,让开发者沿用CUDA的编程习惯,最终编译出昇腾优化程序。

黄仁勋在帕特尔的播客专访中说出了英伟达真正担心的事情。不是中国做出了优秀的模型,而是优秀模型不再以CUDA为默认优化起点。

英伟达的护城河从来不是GPU本身的算力,而是CUDA作为“事实标准”运行了近二十年的软件生态地位。几乎所有主流AI框架、算子库、开源模型的首发优化,都将CUDA作为默认起点。DeepSeek在昇腾上完成原生适配,恰恰打破了这条链条的起点:至少存在一条真实、可运行、被顶级模型验证过的非CUDA路径。

当世界上最好的开源模型证明了一条完整的非CUDA路径,二十年的生态壁垒就出现了第一道裂缝。效率路线从算法延伸到芯片,触及了英伟达最害怕的领域。

算力成为公共资源

中信建投在V4发布后的研报中进行了这样的划分:R1回答的问题是“中国能不能做出世界级模型”,V4回答的是两个更具体的问题——“能不能在算力封锁下持续发展”,以及“大模型能不能成为能盈利的企业级产品”。

第一个问题,学术界已经给出了答案。2025年9月,R1论文登上Nature封面,8位专家逐条审稿,这是全球首个通过顶级学术期刊同行评审的主流大模型。“中国能不能做”这个问题已经有了定论。

第二个问题才是V4真正要回答的。

巨头们正用最传统的方式抢占市场。2026年春节期间,字节、阿里、腾讯三家烧掉近百亿元进行拉新。千问豪掷30亿元送“奶茶大礼包”,豆包登上央视春晚,元宝抛出10亿元现金红包。

QuestMobile数据显示,截至2026年2月,豆包活跃用户1.03亿、千问3245万,DeepSeek以2477万用户排在第三。

但DeepSeek面临的困境与巨头不同。日活从1.2亿飙升至约2亿,半年增长超67%,而算力仅增加了约8.3%。日均算力成本超千万元,今年已经三次大规模宕机,每次都发生在晚间用户高峰期。

用户增长67%,算力增长8.3%。这个差距就是DeepSeek必须走效率路线的原因,也是V4必须在昇腾上运行的原因。

融资信号也在发生变化。2025年初DeepSeek最热门的时候,梁文锋拒绝了所有投资机构。他曾提出类似OpenAI与微软投资协议的回报上限条款,没有任何机构接受,此后再未与投资人见面。

一年后的4月17日,DeepSeek传出至少100亿美元估值的融资消息;五天后,路透社报道阿里和腾讯正在洽谈投资,估值已被抬到200亿美元以上。一位接近DeepSeek的投资人表示:“这不是一个你出得起价就能进入的项目,在梁文锋的筛选标准中,钱是最不重要的那一项。”

一年前拒绝所有人,一年后所有人争相进入。改变的不是梁文锋的态度,而是DeepSeek的市场地位。它从技术验证期走到了商业化的转折点。

DeepSeek“换芯”昇腾引发的连锁反应正在扩散。阿里、字节、腾讯已向华为批量采购昇腾950PR,订单合计数十万颗,集中采购推动芯片价格近几周上涨20%。当行业龙头用实际行动跟进非CUDA路径时,效率路线就从一家公司的选择变成了行业共识。

商业化数据也在印证这个转折点。智谱2025年全年收入7.24亿元,同比增长132%,MaaS API平台年度经常性收入达到17亿元,同比增长了60倍。大模型正在从烧钱的概念变成赚钱的生意。

当行业中开始有人盈利时,“AI泡沫”的说法就该改变了。

米勒在《巴伦》杂志的判断提供了另一个视角。他说,美中之间的差距不在于人才、不在于创新,而在于训练时投入的运算资源。这是典型的存量思维,谁的卡多谁就赢。

但DeepSeek采用的是增量思维:让每张卡的产出更高。V4在昇腾上运行,就是用效率将存量差距变成了一个可以绕开的问题。

而政策信号,可能是三重信号中最值得玩味的。

工信部发布了《普惠算力赋能中小企业发展专项行动》,目标是到2028年底显著降低中小企业使用算力的门槛。文件中出现了两个概念:“算力银行”和“算力超市”。企业可以把闲置算力存进去,按需取用,按卡时、核时甚至Token来计费。

当政策开始用公共资源的逻辑来管理算力时,前沿智能就真的在成为基础设施。DeepSeek从算法层到芯片层持续降低成本,政策从顶层将算力变成公共服务。

一个从供给侧降低成本,一个从制度侧实现普惠。两条线交汇的那个点,就是AI不再是军备竞赛的那一天。

本文来自微信公众号“NEXT趋势”,作者:方远,36氪经授权发布。

本文仅代表作者观点,版权归原创者所有,如需转载请在文中注明来源及作者名字。

免责声明:本文系转载编辑文章,仅作分享之用。如分享内容、图片侵犯到您的版权或非授权发布,请及时与我们联系进行审核处理或删除,您可以发送材料至邮箱:service@tojoy.com