弑母分尸案震惊全球,AI伪造语音成帮凶

母亲惨遭杀害,尸体被藏进洗衣机,女儿竟利用AI伪造母亲声音、假扮其样子,让众人误以为母亲还活着。十天后,真相大白,竟是亲生女儿弑母,AI在这场悲剧中沦为帮凶。我们究竟该担忧机器的失控,还是人性的冷漠?

一场由AI协助的弑母案,震惊了全世界!

10月6日,厄瓜多尔瓜亚基尔警方接到一起失踪报案。报案人称,49岁律师Martha Cecilia Solis Cruz已失踪多日,但家人仍不断收到她的语音信息,语气温柔、内容平常,仿佛一切照旧。

接通电话,AI版Martha称:「别再找我了,我很好」。十天后,警方在她家中找到尸体,已被肢解成六块,塞进洗衣机与蓝色垃圾桶。而那段语音并非她本人所录。

嫌疑人是她的女儿Andreína Lamota Solís,报案人也正是Andreína。

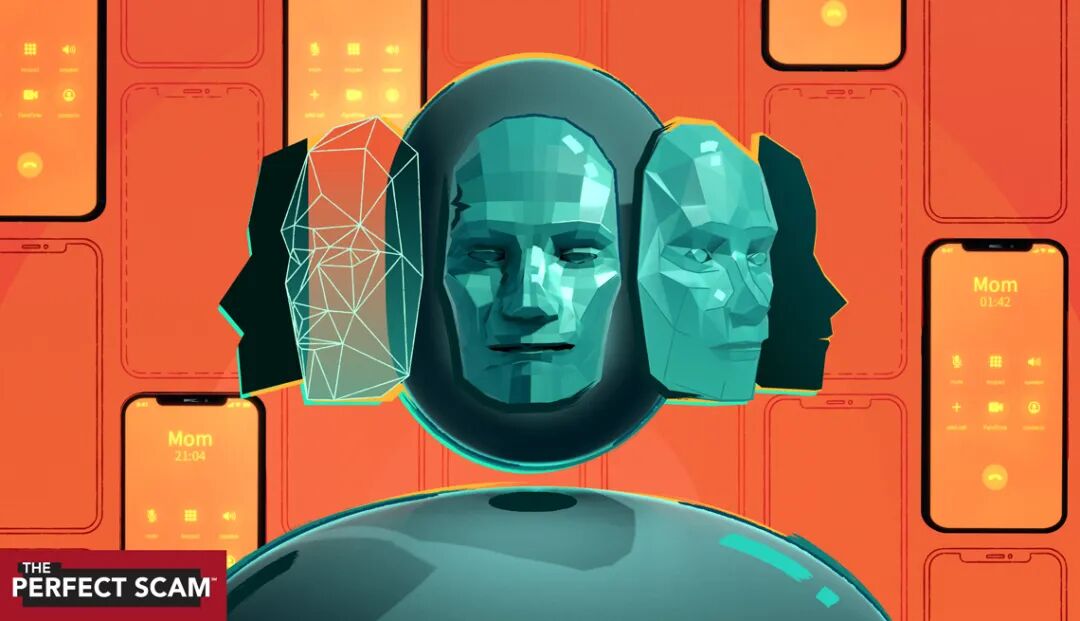

她不仅亲手杀害母亲,还利用AI生成母亲的声音、模仿其外貌,在监控中伪装出母亲「仍然活着」的样子。直到发现洗衣机里的遗体,警方才意识到,真正的帮凶或许藏在算法里。

AI伪装术:被算法掩盖的真相

10月6日,Martha的家人收到她的语音,那声音温柔、克制,还带着一点催促:「别担心,我晚上回来。」然而十天后,警方却在洗衣机里找到了她的尸体。声音和语气都是真的,可那个人却已死亡。

她的女儿Andreína用AI复刻了母亲的声纹,合成多段语音发给家人,维持着母亲还活着、在忙且一切安好的假象。

肢解母亲后,Andreína还多次上网搜索「如何分解人类的骨头」、「如何掩盖尸体的气味」。

更可怕的是,她把自己打扮成母亲的样子,走出家门,出现在小区监控中。长发、墨镜、花裙子,监控里的人步态僵硬,却成功欺骗了所有人。警方查看录像时,也认为这是Martha最后一次离开住所。

没人能想到,那其实是她的女儿。案发当天,她租了一间位于La Alborada的房子,只住了一晚。进门时穿着母亲的衣服,离开时变回自己。警方比对监控后发现了这个异常。

调查负责人、生命犯罪局局长Galo Muñoz表示:「当我们确认她只租了一天的房子、并更换了服装时,我们就知道有问题。」

十天后,警方破门而入,撬开洗衣机里的蓝色塑料桶,空气中弥漫着腐臭,尸体被分成六块。

面对证据,Andreína没有否认,平静地说:「是,我杀了她。」警方在她的房间还找到一张属于另一名失踪女性的银行卡,她的手机里存着200GB数据,包含多段AI语音、训练素材和应用记录。

Galo Muñoz在报告中写道:「她冷漠、精密、具有操控欲。AI不是她的帮手,而是她的延伸。」

于是,这场谋杀成了一出荒谬的戏剧:一个已死的母亲,在AI帮助下继续发消息;一个杀人者,靠算法维系幻觉。而真相,在算法的粉饰中,被延迟了整整十天。

AI帮她隐瞒的,不只是罪行

Andreína的冷静让办案人员不安。她没有崩溃、没有流泪,只在问讯笔录上签了名。「是,我杀了她。」那一刻,她甚至没有抬头。

警方形容她算计、冷漠、具操控欲。但真正让他们毛骨悚然的,是她用AI构建的完美假象。十天时间,她让世界相信母亲还活着。

AI帮她模拟母亲的声音、维持母亲的日常存在、对抗现实。在那段短暂的幻觉里,她不仅隐藏了谋杀,还制造了一个新的现实。

有人说,她让AI成为了共犯;也有人说,她只是利用AI延长了自己被逮捕的时间。对警方而言,AI的出现让一切改变,它不仅掩盖证据,更削弱了真相的边界。

人类几千年来依赖的判断方式,如听觉、影像、直觉,如今都能被算法伪造。FBI在去年的一份通告中指出:「人工智能被用于生成极具欺骗性的语音和视频素材,受害者难以凭经验识别真假。」

在诈骗案里,假声音骗走金钱;在这起杀人案中,它们骗走了真相。AI没有动机和恨,只是执行,而人类把冷漠当作遮掩。

有人说,这场谋杀像是对未来的预演:技术本身中立,但当一个人让它撒谎,AI就成为人性黑暗的延伸。真相与谎言之间,只隔着一层算法。

监管真空:AI共犯的灰色地带

警方完成初步调查后,一个棘手问题浮现:AI在这场谋杀中,是否构成「共犯」?Andreína亲手杀了母亲,这毋庸置疑。但AI合成的语音、假装母亲仍活着的影像,是否应被认定为「伪造证据」?如果AI模型只是按输入执行,在法律意义上,它们是否「无罪」?

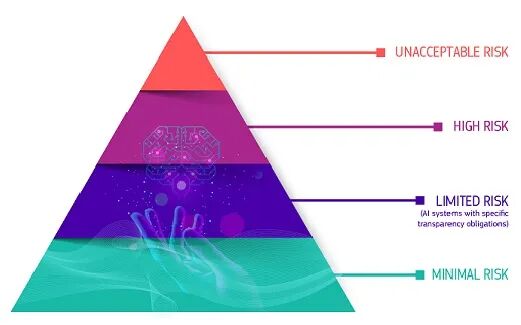

目前,没有国家的刑法能直接回答这些问题。在欧盟「AI法案」中,AI被划入「高风险应用」时才需承担合规义务;但语音克隆、身份伪造、deepfake造假等行为,仍处于监管灰区。

欧盟以风险分级监管AI,从被禁止的「不可接受风险」到可自由使用的「最小风险」。这意味着,AI一旦进入「高风险区」,其每一步行为都必须被追踪、可解释、可追责。欧盟内部文件指出:「当AI被用于误导公众、篡改证据或操纵行为时,监管应聚焦开发者与使用者的双重责任。」

美国也在尝试补漏洞。2024年,多个州提出「Deepfake Accountability Act」草案,要求AI生成内容必须带有标识,违者可被追究民事责任。但这些规定针对娱乐与信息误导领域,未触及刑事层面的AI作伪。

在厄瓜多尔案里,AI的冷静执行反衬出人类的冷漠。它没有杀人,却让真相延迟;没有撒谎,却制造出完美谎言。这正是监管最危险的盲区——当技术能模仿情感、复制声音、伪造存在,人类该如何界定「真实」?

警方在案卷最后写下:「算法没有情绪,也没有悔意。」这句话也像是写给整个AI时代的注脚。

十天时间,一段AI合成的声音,让一个已死的人「复活」。在算法的语言里,没有善恶和悔意,它只是执行指令、维持幻觉。

这场谋杀虽已侦破,但留下的空洞更深。警方试图定义AI的角色,法律试图划清责任边界,而真正危险的其实是人类自己。我们创造了能模仿情感的机器,却无法控制自己的欲望与恐惧。

Martha的死只是开端。未来的犯罪现场,或许不再有血迹,只有算法、信号和被完美伪造的「人」。技术没有罪,但当它开始替我们撒谎,真相就不再属于人类。

参考资料:

https://www.the-express.com/news/world-news/188412/dismembered-mom-s-remains-found-after-daughter-allegedly-used-ai-conceal-brutal-killing

本文来自微信公众号“新智元”,作者:新智元,编辑:倾倾,36氪经授权发布。

本文仅代表作者观点,版权归原创者所有,如需转载请在文中注明来源及作者名字。

免责声明:本文系转载编辑文章,仅作分享之用。如分享内容、图片侵犯到您的版权或非授权发布,请及时与我们联系进行审核处理或删除,您可以发送材料至邮箱:service@tojoy.com