人工智能时代的企业知识管理:把杂乱信息转化为业务运营效能

现在的生成式人工智能绝不仅仅是又多了一层软件工具,它会直白地暴露企业现有信息资产的真实状况。如果到2026年你还在费力搭建集中式的“单一信息源”,这根本算不上架构设计,更像是在做IT考古。现实很扎心:企业里大部分生成式人工智能项目失败,问题根本不出在大语言模型(LLM)的选择上,反而出在输入模型的数据结构质量太差。别再做那些华而不实、只能博眼球的脆弱概念验证(POC)了,现在该沉下心搭建基于扎实知识管理(KM)的工业级落地平台了。

引言:缺了知识管理支撑的人工智能,注定会程序性失败

我们必须打破一个危险的错误认知:别觉得人工智能能靠算法魔法,自行梳理清楚混乱的信息。过去“垃圾进、垃圾出”的说法,现在已经升级成了更隐蔽的问题:“垃圾进,垃圾放大”。传统搜索引擎顶多返回错误文档,用户大可以直接忽略;但大语言模型会把这些低质量数据全部吸收,再用极具迷惑性的流畅表达,把错误内容包装成“正确结论”输出。人工智能不只是重复错误,它还会把错误润色得逻辑通顺,藏在自然文本背后,直接消解用户的判断能力。

混乱无序的企业内网,是落地工业级人工智能的头号阻碍。把检索增强生成(RAG)链路直接接到一团乱麻的SharePoint服务器上——而服务器里堆满过期的人事制度、互相矛盾的技术规范,这完全是不负责任的行为。一旦人工智能对关键运维流程、合规问题给出错误答案,企业会立刻遭遇信任危机,而且这种伤害往往是永久的。作为架构设计者,我们必须认清楚:现在的知识库早就不是被动的存档仓库了,它是企业的语义计算核心。没有严格的管理体系和元数据结构,你的人工智能项目,不过是一个成本高昂、风险极高的玩具罢了。

知识管理核心框架:4个核心要素与四大支撑支柱

想要实现人工智能的产业化落地,我们必须重新回归知识管理的基础逻辑,同时匹配机器运行的速度和精度要求。知识的全生命周期,需要围绕4个核心要素(简称4C)协同运转:

隐性转显性:知识最初都存在于隐性的人际交流里。人工智能不只是用来回答问题,还可以捕捉各类互动的核心内容——比如支持工单、内部会议、即时通讯讨论,把这些零散的非正式信息,转化成结构化的企业资产。

源头化捕获:捕获不是简单“存成PDF文件”。它要求在信息被创建的那一刻,就提取出其中的实体、关联关系和创作意图。如果信息在产生源头没有做结构化处理,后续再加工的成本会高得离谱。

专业化审核:这是90%企业都做不好的关键环节。内容审核需要领域专家(SME)对信息做真实性验证。没经过验证的内容就是技术负债,最后只能靠人工智能的编造来填坑。

场景化流通:人工智能改变了知识的分发逻辑,从过去用户主动“拉取”(关键词搜索),变成了匹配当前场景的主动“推送”(对即时需求给出精准响应)。

其实在整个知识管理搭建工作里,技术只占20%。一个稳固的知识管理平台,要建立在四大支柱之上:人员(必须建立激励机制,推动专家贡献专业知识)、流程(清晰的数据治理工作流)、技术(RAG和知识图谱的基础架构)以及治理(明确信息的法律与道德责任)。这套体系的投资回报并不遥远:成熟的知识库能大幅缩短技术支持的平均解决时间(MTTR),核心原因不是搜索变快了,而是能给出清晰、无歧义的权威解决方案。

拆掉集中式单体:走联邦知识架构与数据网格路线

单一集中“信息源”的模式注定失败,这是历史已经验证的结论。硬要把所有信息集中管理,最后只会导致内容过期,还会打击业务部门的积极性。我们更推荐的架构,是基于数据网格原则的联邦制架构。知识本来就该归它的创造者所有——也就是企业各个业务部门,比如法务、人力、研发。

每个业务域都管理自己的“记录系统”,遵循符合自身需求的内容更新规则。架构师要做的,是在这些分布式系统之上,搭建一层全局索引和语义中介层。这样一来,RAG流程就能在各个数据孤岛之间顺畅切换,不需要把所有数据做大规模迁移。我们就此从静态的数据仓库,变成了互联互通的知识生态系统。这套语义网络能让人工智能识别:哪怕名称不一样,销售手册里的“产品X”,和缺陷记录里的“项目X-104”,其实指的是同一个东西。

内容规范与元数据基础:让内容适配AI需求

想要人工智能高效运转,必须给它提供“AI就绪”的合格内容,这要求内容创作像外科手术一样精准规范。黄金规则就是:“一篇内容只解决一个问题”。如果你的文档是50页、混了多个主题的“大段文字墙”,经过RAG流程分块处理后,只会得到一堆脱离上下文、逻辑不连贯的信息碎片。每一块内容都要简短(最多不超过200字),结构清晰,方便机器提取信息。

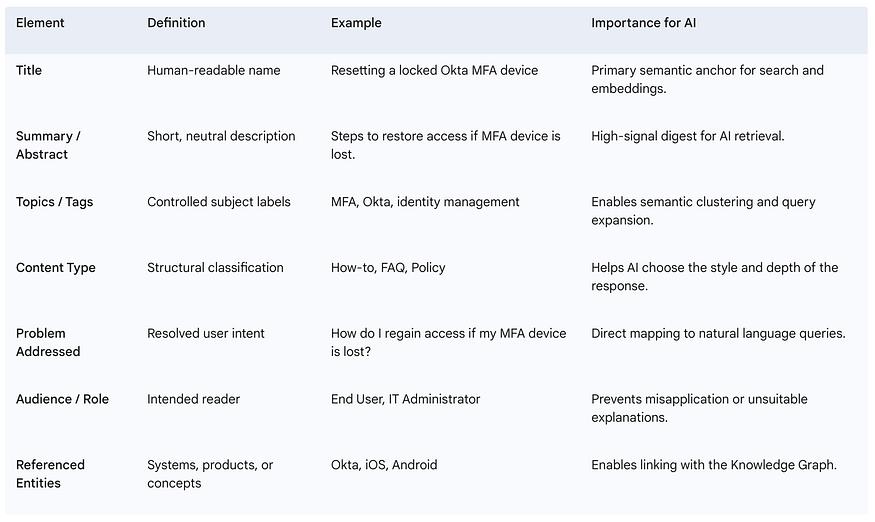

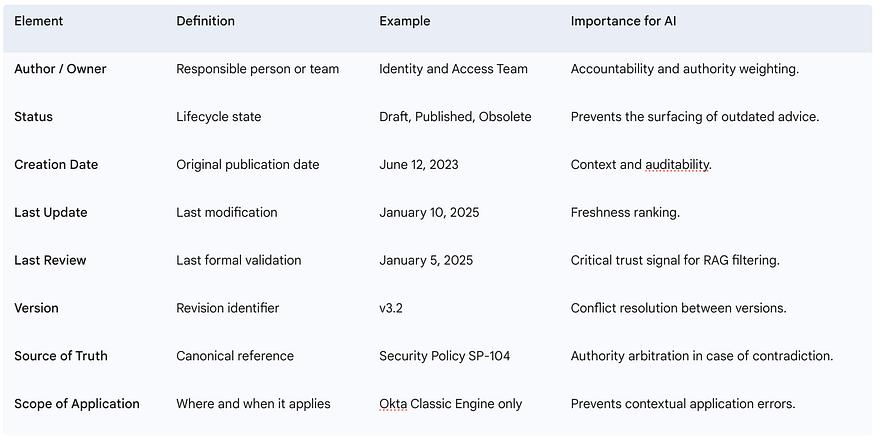

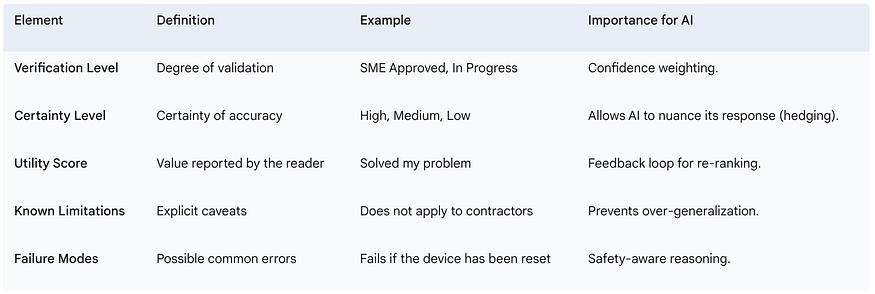

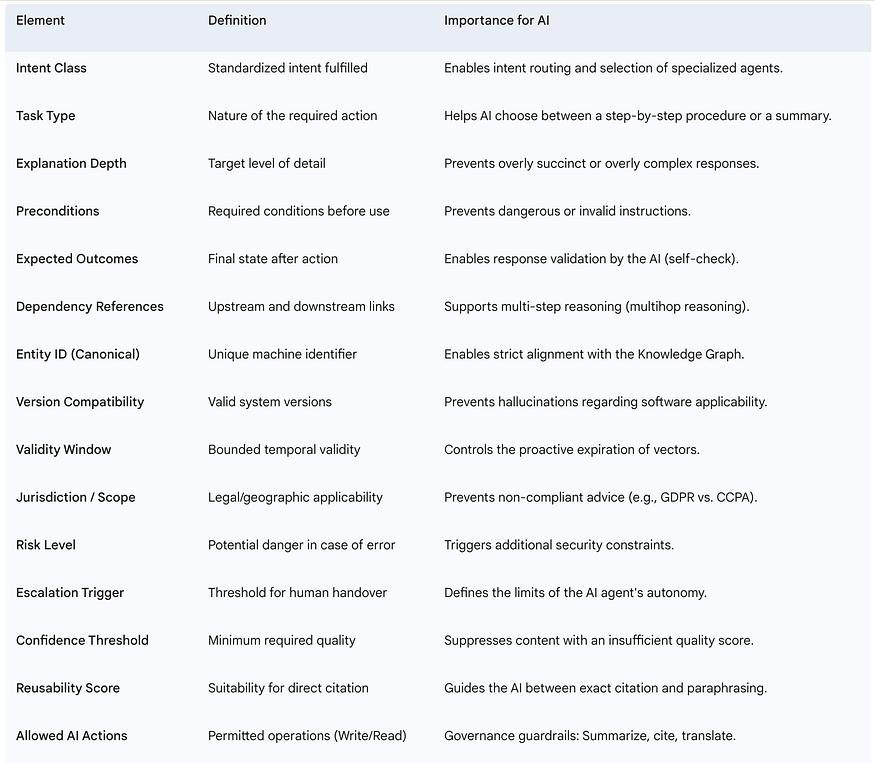

但真正能让体系运转起来的核心是元数据。人工智能不仅不会减少对元数据的需求,反而会把这种需求放大。如果没有清晰的标注信号,人工智能根本没法判断文档是不是过期、能不能给普通用户看、是不是只适用于特定地区的合规要求。下面是按照最高标准搭建的元数据策略的核心内容:

表 1:描述性元数据(搜索能力的核心)

表 2:管理元数据(保障内容新鲜度)

表3:定性元数据(构建反馈闭环)

AI专属适配元数据

这是区分专业架构和零散拼凑方案的关键。这些元数据能让人工智能读懂内容,而不只是找到内容。

表 4:AI 赋能专属元数据

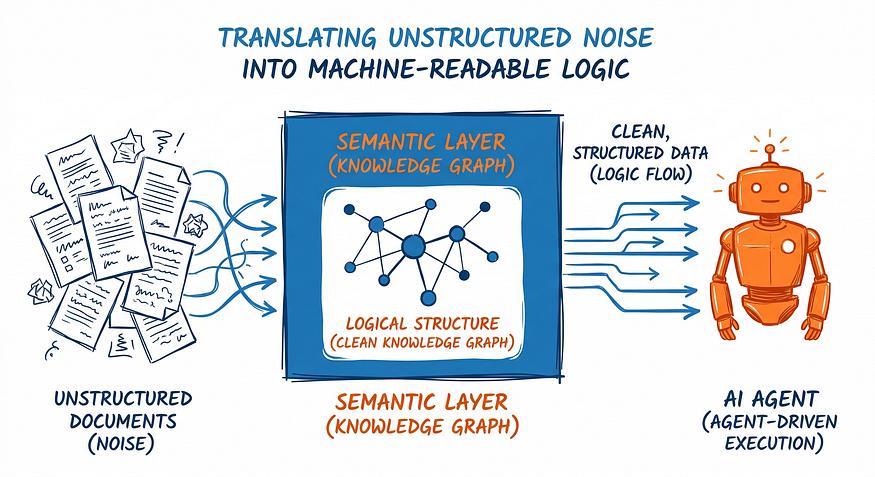

语义层与知识图谱

人工智能处理企业内部术语、同义词的时候经常出问题。比如用户要找“故障”的解决方案,但官方文档里用的是“服务中断”。在纯向量空间里,这两个词距离接近但不完全一致。解决方法就是搭建语义层,并用知识图谱(KG)把它落地。

和存储数学近似值的向量数据库不同,知识图谱用RDF(资源描述框架)和OWL(Web本体语言)这类标准,明确定义了实体(产品、系统、事件)和它们之间的关联。通过构建最小可行模型(MVM),我们就能把业务含义编码进系统。运营故障(OperationalIncident)这个实体,就会成为连接服务中断(Outage)、系统异常(ServiceDisruption)和应对方案(ResponseProcedure)这些实体的核心节点。

这种结构支持多步逻辑推理。如果用户的问题需要把安全规范,和特定地区的特定软件版本关联起来,知识图谱能让人工智能沿着逻辑链接(也就是“语义路径”)一步步推理,而不是靠猜统计上的关联性。默克公司的案例就是行业标杆:他们用大语言模型生成SPARQL查询,检索自身的临床数据图谱,强制人工智能只能在授权的结构化数据范围内输出内容,从根本上消除了编造内容的空间。知识图谱就像一道逻辑护栏,把大语言模型不受限制的想象框在了合规合理的范围里。

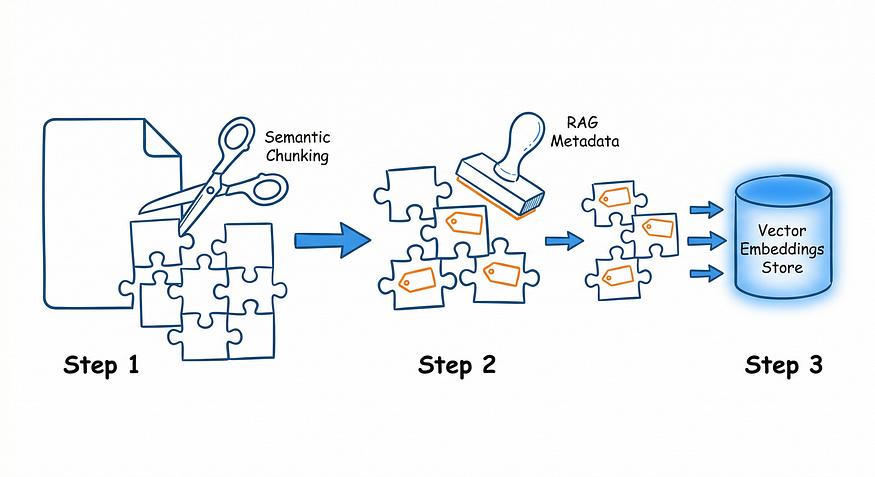

RAG(检索增强生成)的工业化搭建

RAG的技术落地,必须当成工业化生产线来打造,不能做成零散拼凑的Python脚本。

文本分块逻辑:文本分块是一门科学,本文更推荐递归文本分割法——这种方法会尊重内容本身的逻辑结构(段落、列表),而不是随便按照词元数量硬切。分块之间的重叠比例要精细调整(保持10-15%),才能留住两个分块之间的语义关联。更进阶的方案是父文档检索法,它支持用更小的分块做搜索(精度更高),同时把完整的父文档传给大语言模型,保证上下文信息完整。

向量嵌入的天生局限:向量嵌入虽然能力很强,但会受“维度灾难”的影响。遇到非常专业的技术术语、数字错误码时,余弦相似度计算就可能失灵。

混合架构:向量搜索+GraphRAG:现在行业的标准方案是GraphRAG,也就是把向量搜索的语义灵活性,和知识图谱的逻辑严谨性结合起来。上下文压缩这类技术,可以过滤掉检索到的无用片段,只把最核心的“信息精华”传给大语言模型,既降低了噪声,也减少了分词成本。

邦飞利公司的实践证明:把技术文档和完善的业务本体结合后,他们的AI回答准确率提升了40%。他们用了一个协调代理,会根据问题类型,自动判断该查询知识图谱(处理结构化数据)还是向量数据库(处理文本语义)。

总结:治理、指标与自主学习

运营这套知识平台,要放弃虚有其表的指标(比如累计产出文章数量),转而关注“AI就绪度”相关的关键绩效指标(KPI)。成功的衡量标准是这几项:

可查找性:首次搜索就能找到正确结果的比例。

页面停留时间与跳出率:如果用户处理复杂流程只在页面停留2秒,要么说明内容没用,要么说明索引没做好。

RAG准确率:经过领域专家验证的回答正确比例。

我们还需要把数据成熟度评估,分成四种AI就绪等级:

AI POC阶段:风险管控依赖个人能力,元数据覆盖不全。

多场景验证阶段:完成多场景的数据验证,开始搭建结构化体系。

落地实施阶段:切换到自动化准备工具和平台。

生产运营阶段:完善系统治理,监控输出偏差,实现自动纠正。

未来的发展方向是自学习知识库。通过分析搜索日志和无效回答,人工智能可以自动检测出“知识缺口”。它还能主动提示团队创建新内容,甚至可以基于已经解决的支持工单,自动写出内容初稿,再提交给人工做简化验证。

知识管理早就不是企业的辅助功能了,它是人工智能的神经系统。没有严谨的语义结构,你只不过是把原来的混乱自动化了而已。投资语义体系、元数据和治理能力,这是搭建真正能创造价值、不带来额外风险的人工智能的唯一路径。

别做样子好看的玩具,要搭能落地创造价值的平台。

本文来自微信公众号“数据驱动智能”(ID:Data_0101),作者:晓晓,36氪经授权发布。

本文仅代表作者观点,版权归原创者所有,如需转载请在文中注明来源及作者名字。

免责声明:本文系转载编辑文章,仅作分享之用。如分享内容、图片侵犯到您的版权或非授权发布,请及时与我们联系进行审核处理或删除,您可以发送材料至邮箱:service@tojoy.com