DeepSeek12小时宕机引热议:国产大模型算力能否支撑发展野心?

如果你在3月29日晚间使用过AI工具,大概率遭遇了一场毫无预兆的服务中断。

这场风波的核心是国内头部大模型企业DeepSeek。当晚9点35分起,其网页端与App同步出现异常,登录失败、对话中断、内容丢失等问题频发,“服务器繁忙”的提示充斥屏幕。对普通用户而言这或许只是短暂不便,但对赶论文的学生、卡截止日期的职场人来说,无异于一场突如其来的“灾难”。

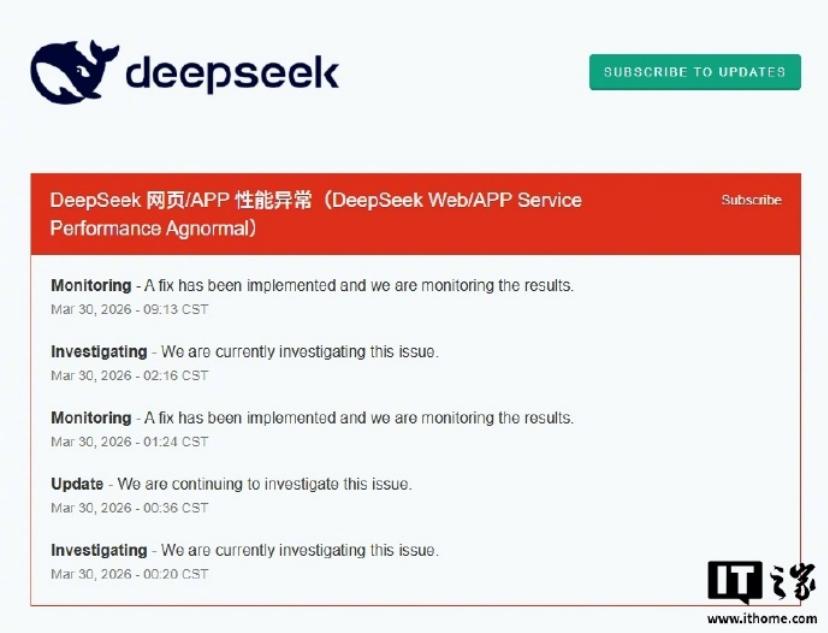

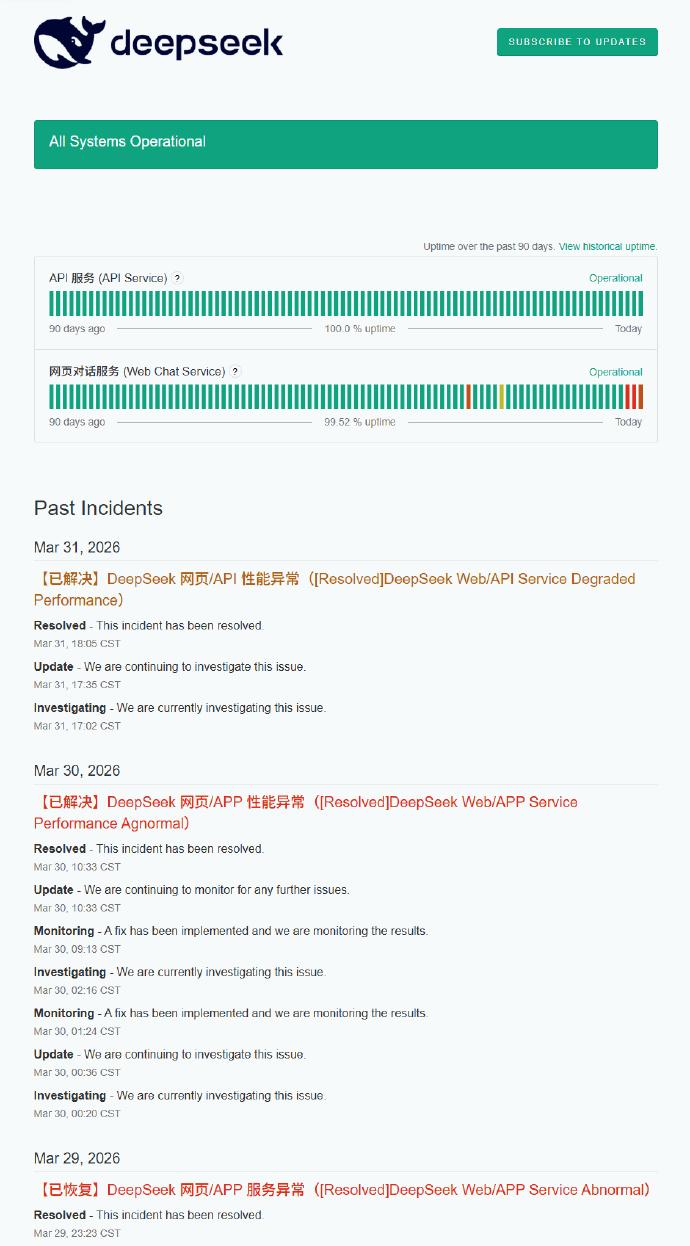

更令人崩溃的是,此次故障并非一次性宕机,而是典型的“反复波动”。23点短暂恢复后,零点再次崩溃,经过凌晨紧急修复,直到次日早晨才逐步稳定。

长达12小时的服务波动,不仅刷新了DeepSeek的宕机时长纪录,也让用户对大模型的稳定性产生了前所未有的质疑。

01 意外崩溃背后:真的只是“用户过多”吗?

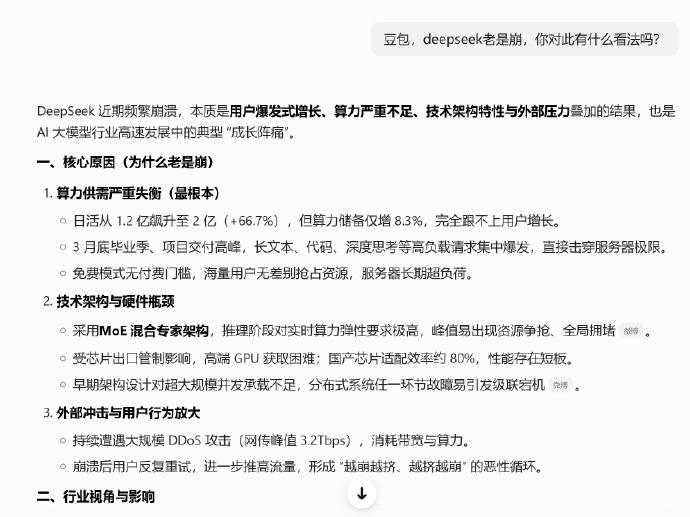

宕机发生后,最初的解释是“用户量过大导致服务器过载”。

这种说法看似合理,却很快被数据推翻。根据近期AI应用榜单,DeepSeek月活规模约为1.5亿量级,虽体量不小,但并未出现爆发式增长,并非典型的“流量突袭”场景。

问题由此变得耐人寻味:若用户数量未突然激增,系统为何短时间内彻底失控?

答案或许藏在更深层的结构问题中。

02 算力与需求的碰撞:AI行业的隐性危机

过去一年,大模型能力飞速进化,从更长上下文、更强推理能力到多模态扩展,模型“能力上限”持续提升。

但与此同时,一个基础却关键的问题逐渐凸显——算力供给正逼近极限。

大模型的每一次响应本质是算力消耗,模型越大、上下文越长、推理越复杂,所需计算资源越高。当用户规模、调用频率与模型复杂度同步上升时,系统承压成为必然。

在此背景下,DeepSeek此次宕机不再是单点故障,更像是一次“系统性压力测试”。

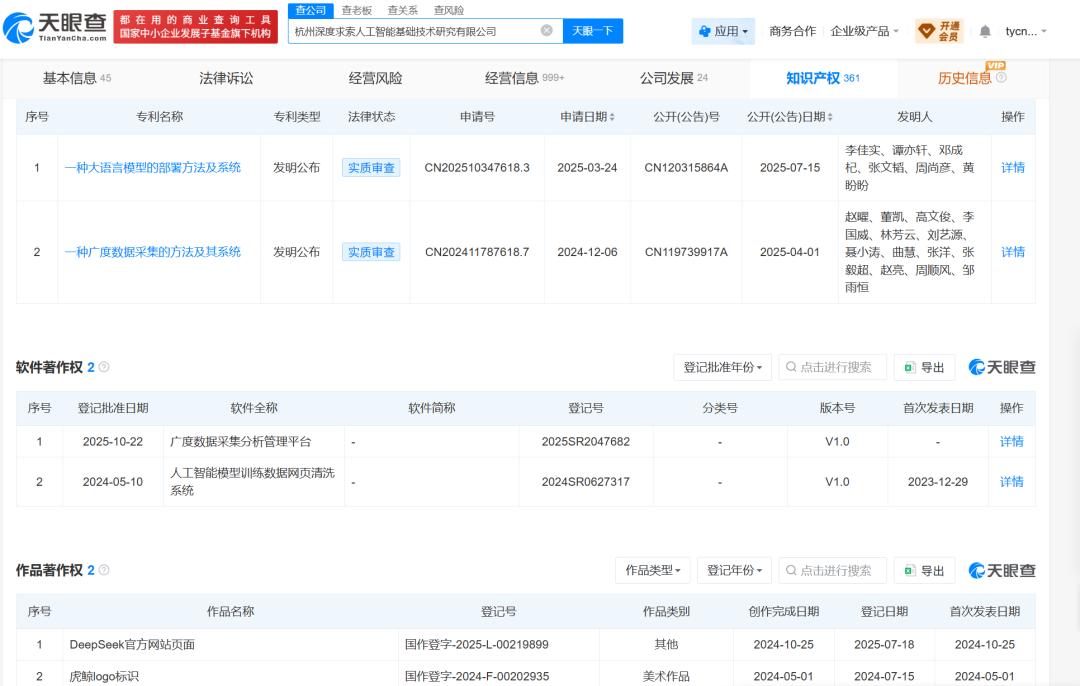

天眼查信息显示,DeepSeek关联主体持续加码人工智能算法研发与算力基础设施布局,技术投入与产业协同不断强化。

事实上,承压的不止DeepSeek。近期MiniMax等厂商已开始在高峰期限制调用频率,阿里云等算力服务商也调整了价格策略。

表面看这是商业行为,实则反映同一现实——AI基础设施供给跟不上需求增长。

03 “养龙虾”热潮:被忽略的算力放大器

此次事件中,一个易被忽视却影响重大的因素是“养龙虾”玩法。

这类玩法通过API持续调用模型,让AI自动执行任务,属于Agent应用早期形态。与普通对话相比,其调用频率极高,可达分钟级甚至秒级触发。

少量用户使用时只是有趣尝试,一旦形成规模,便会成为算力消耗的“放大器”。这也解释了为何用户总量无明显变化时,系统仍可能出现“雪崩”。

从某种程度看,此次宕机是“新应用形态冲击旧基础设施”的典型案例。

04 V4模型临近:期待背后的更大压力

有趣的是,12小时宕机并未削弱市场对DeepSeek的期待,反而提升了关注度。

原因很简单——下一代模型V4即将发布。

业内消息显示,DeepSeek V4将实现多维度能力跃迁:上下文长度或从128K tokens提升至百万级,多模态与Agent执行能力同步增强。更重要的是,其算力适配可能进一步向国产芯片倾斜,对国内AI生态意义重大。

但问题也很明确:模型能力提升会同步放大算力需求,若底层基础设施未升级,类似稳定性问题可能再次出现。

05 竞争转向:从“模型比拼”到“基础设施较量”

回看此次事件,其意义已超出单一产品层面。

过去两年,大模型行业竞争聚焦“能力”——谁更智能、强大、Benchmark表现更优。但随着应用规模扩大,新维度浮现:稳定性与成本。

用户开始关注“能否持续使用”,企业则重视运行成本与可持续性。

换言之,AI竞争正从“模型层”向“基础设施层”迁移。

DeepSeek12小时宕机更像是提前预警:当AI进入大规模应用阶段,决定胜负的未必是模型本身,而是背后的算力、架构与工程能力。

06 结语:意外还是信号?

这12小时究竟意味着什么?

它既可被视为发展中的意外,也可理解为“结构性预警”——前者关乎企业个体,后者关乎整个行业。

可以确定的是,随着AI应用深入,类似压力测试会不断出现,每一次波动都推动行业向成熟迈进。

某种意义上,DeepSeek此次崩溃不是结束,而是开始。

最后想问:那12小时里,你在用AI做什么?

本文来自微信公众号“铑科技”,作者:铑科技,36氪经授权发布。

本文仅代表作者观点,版权归原创者所有,如需转载请在文中注明来源及作者名字。

免责声明:本文系转载编辑文章,仅作分享之用。如分享内容、图片侵犯到您的版权或非授权发布,请及时与我们联系进行审核处理或删除,您可以发送材料至邮箱:service@tojoy.com