人工智能时代,社会学家如何使用AI?

本文来自微信公众号:严肃的人口学八卦,作者:严肃的人口学八卦组

从代码编写到图像生成,从信息查询到日常聊天,人工智能已渗透生活的各个角落,甚至不少短剧都由AI直接生成剧情。

学术界也不例外,越来越多研究者将AI工具融入工作流程。对社会科学领域而言,一个有趣且重要的问题是:社会学家、人口学家等社科工作者目前如何使用人工智能?又如何看待这项新技术?

在探讨这个问题前,先明确本文所指的“AI”——主要是生成式人工智能(Generative AI, GenAI)。这类模型能生成文本、图像、音频或视频等内容,在社科研究中,文本生成模型应用最广,研究者输入提示语或指令,模型便会生成相应内容。

1. 社会科学领域:谁在如何用AI?

Alvero等人2026年的研究,对50本社会学和人口学顶级期刊(如Demography、American Journal of Sociology、Annual Review of Sociology等)的作者展开调查与访谈。

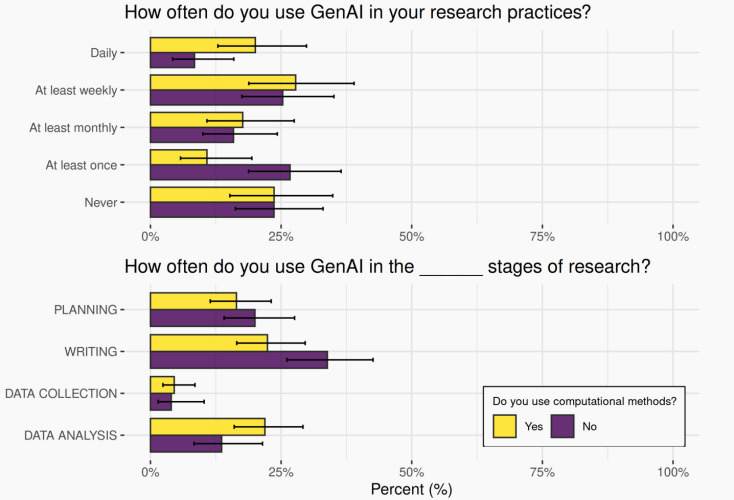

研究者选取219名非计算社会科学学者和214名计算社会科学学者进行分析。计算社会科学学者指在标题、摘要和关键字中包含计算机术语的文章作者;非计算社会科学学者则多为定性研究者,以及主要使用经典统计方法的量化研究者。

很多人直觉认为,计算社会科学学者更熟悉技术、常与代码打交道,会更依赖AI。但研究结果显示,两者在AI使用频率和态度上差异很小。计算型学者中“每周使用”最常见,“从不使用”紧随其后;非计算型学者中“至少使用过一次”最常见,“每周使用”排第二。

不过,这并不意味着社科研究依赖AI已成风气。调查将研究阶段拆分后发现,大多数学者在各阶段都未使用AI。在使用AI辅助科研的学者中,无论计算型还是非计算型,最常见的场景都是写作阶段,比如用AI润色段落、整理思路。同时,计算型学者在数据分析任务中使用GenAI的比例(约21.9%)略高于非计算型学者(约13.6%)。

部分受访者还提到,会用AI生成论文标题,或自动化处理科研相关邮件沟通。

图:社会科学研究者在科研中使用GenAI的频率与研究阶段

Source:Alvero,A.J.et al.,2026

2. 学者们为什么(不)使用AI?谁更相信它?

社科学者为何使用AI,又为何保持谨慎?

对已使用AI的学者而言,最直接的原因是节省时间、满足好奇心。同时,很多日常工具已整合AI功能,比如搜索引擎会自动生成AI摘要,即便研究者未刻意使用,也会接触到AI。

同辈压力也是推动因素,有人担心不使用AI会在学术竞争中落后,正如一位受访者所说:“我担心研究过程太‘慢’,甚至显得过时。”但整体来看,来自合作者、学科领域或学术机构的外部压力不强,学界尚未形成必须使用AI的制度要求。

此外,母语非英语的学者提到,AI在写作上的帮助让他们表达学术观点时更自信。

然而,学者们对AI能否真正改善研究工作态度谨慎。多数受访者认为,AI不会让原本不可能的研究变得可能,对于AI能否让研究者聚焦更有意义的问题、显著降低科研成本,很多人没有明确答案。

相比潜在收益,学者们更担心信息质量、数据隐私,以及科技公司对GenAI工具的控制权。许多人还担心过度依赖AI会削弱自身批判性思维能力。一位受访者表示:“理想中,GenAI应减轻‘不发表就淘汰’的学术压力。但如果它只是加快产出速度,让学界对产出要求更高,可能只会增加论文数量,未必能改善研究者和学生的处境。”

整体而言,学者们对GenAI未来两到三年的持续改进持乐观态度,但对其优势是否超过负面影响仍矛盾。即相信技术进步,却不完全信任结果。此外,男性学者对AI更乐观、信任,这与美国成年人口调查结果一致,女性、非二元性别和跨性别群体对AI态度更负面。

3. 社会科学应该塑造什么样的AI?

社科研究核心对象是人,GenAI的特别之处在于能“像人一样”说话、互动、分类甚至模拟行为,这与社科研究对象高度相关。

从研究角度看,AI现在或未来能帮社科研究做不少事。首先,设计调查和实验材料。社科实验中需准备新闻报道、招聘广告等材料,过去人工撰写难保证不同条件可比,GenAI能快速生成材料,通过调整让版本更一致、贴近现实,还能保护隐私。

AI还能模拟调查受访者,设定人口属性后可生成类似现实群体的回答,作为调查辅助工具。

此外,AI能复制经典社科实验结果,处理大规模文本资料(如新闻、社交媒体内容、访谈记录)并完成初步编码分类。甚至可引入实验环境,设计人机互动实验,观察群体行为和社会互动,为社科研究提供新可能。

AI应用的伦理问题是争论焦点。比如苏黎世大学的研究,在在线讨论社区测试AI是否比真人更擅长说服,创建账号让AI冒充身份参与讨论,推测用户属性进行定制化说服。该研究未获参与者知情同意,被认为违反研究伦理。

(本文不是用AI写的,严八永远坚持手搓)

若未来趋势无法阻挡,社会科学家应参与塑造什么样的AI?

一些学者认为,应发展更透明、可检查、可复制的模型体系,而非依赖科技公司的封闭模型。商业模型不断更新,研究结果难复制;GenAI输出对提示语敏感,开源模型能让研究者了解过程、保护隐私、提高透明度,还能形成研究社区,推进学术平等。若只有少数机构承担商业模型和算力成本,GenAI可能扩大学术资源不平等。

科学研究根本是求真务实,强调创作与表达的领域不应完全交给AI,AI的边界需继续讨论反思。

不必对AI过度焦虑,没学最新技术也不会慢人一步。至少在社科领域,最重要的仍是人。

技术改变工具,却不能取代人的判断。真正引起共鸣的,是从人出发、有温度与思考的内容。

Sources:

Alvero,A.J.,Stoltz,D.S.,Stuhler,O.,&Taylor,M.A.(2026).Generative AI in Sociological Research:State of the Discipline.Sociological Science,13,45-62.

Bail,C.A.(2024).Can generative AI improve social science?.Proceedings of the National Academy of Sciences,121(21),e2314021121.

O'Grady,C.(2025).'Unethical'AI research on Reddit under fire.Science,388(6747).

Spirling,A.(2023).Why open-source generative AI models are an ethical way forward for science.Nature,616(7957),413-413.

本文仅代表作者观点,版权归原创者所有,如需转载请在文中注明来源及作者名字。

免责声明:本文系转载编辑文章,仅作分享之用。如分享内容、图片侵犯到您的版权或非授权发布,请及时与我们联系进行审核处理或删除,您可以发送材料至邮箱:service@tojoy.com