Seedance2.0引爆AI视频圈后,豆包Seed2.0能否再续辉煌勇攀高峰?

本文来自微信公众号:极客公园,作者:连冉,编辑:郑玄,原文标题:《Seedance 2.0 炸场之后,豆包 Seed2.0 能否再度勇攀高峰?》

近期,Seedance 2.0在AI视频领域热度飙升,成为行业焦点。

从游戏制作人冯骥的认可到美国导演的关注,中国AI视频模型凭借「物理规律遵循」的突破性优势,首次在全球范围内实现领先。

不过,视频生成的火热只是字节AI布局的一部分。2月14日,豆包大模型2.0的跨代升级,标志着字节正式迈入「原生多模态Agent」时代,这才是更深层次的变革。

此次升级的核心在于字节跳动对底层能力的全面重构,推动AI从「信息分发」转向「任务处理」。与部署门槛较高的开源项目不同,豆包2.0将多模态理解、可调节思考长度的逻辑推理以及稳定的工具调用能力内化为模型的核心本能。

在字节跳动CEO梁汝波提出的「勇攀高峰」年度关键词指引下,豆包大模型2.0聚焦大规模生产环境的用户体验优化,致力于成为能通过一句话解决用户问题的端到端Agent。

在提升性能的同时,豆包2.0的定价也极具性价比——豆包2.0 Pro(32k)输入仅需3.2元/百万tokens,成本优势显著超过GPT 5.2与Gemini 3 Pro;而性能优于上代主力的Lite版,单价更是低至0.6元。

01

豆包2.0的「大脑」有哪些升级?

豆包2.0能否支撑Agent场景,关键在于其底层能力。

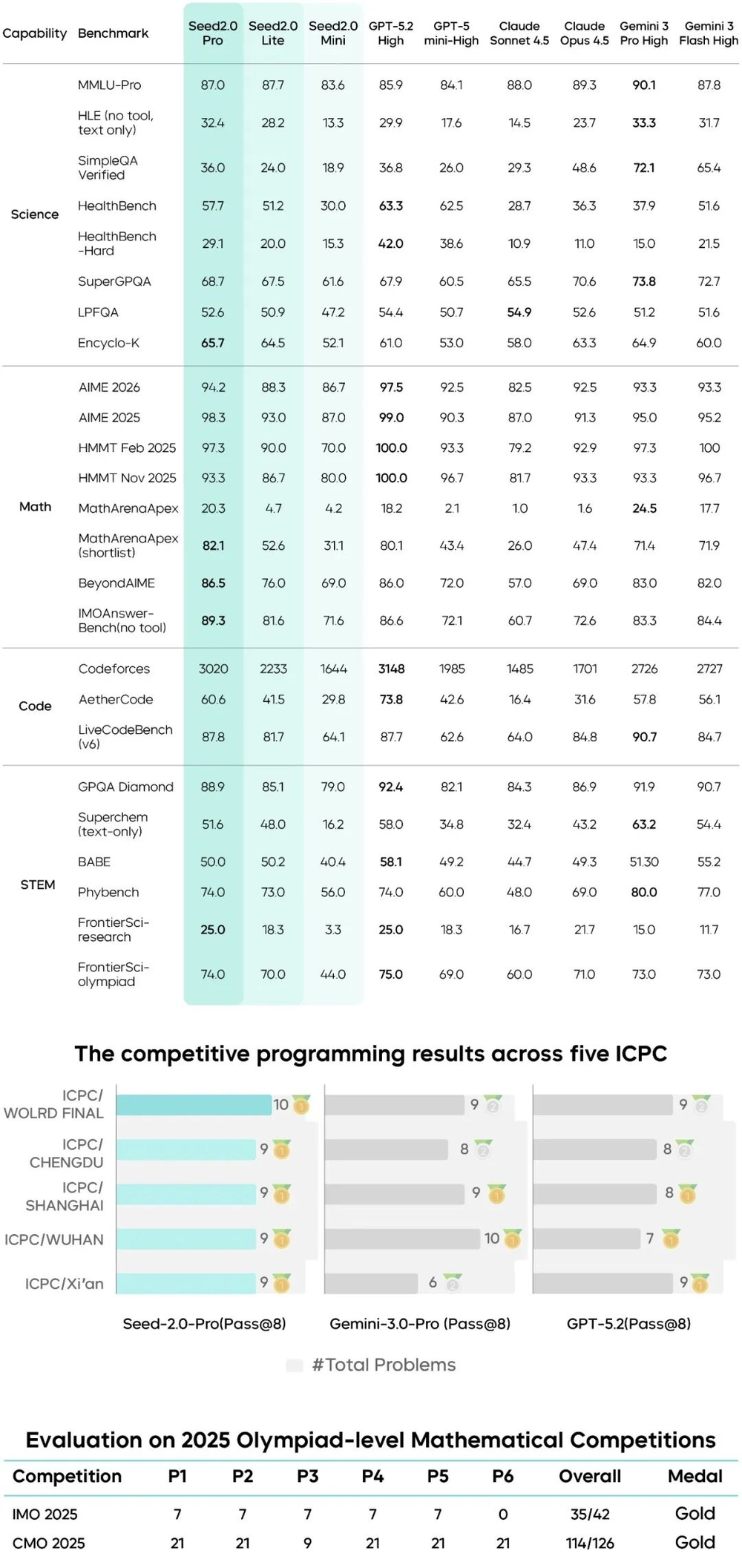

首先是逻辑推理能力的大幅提升。在推理与数学等核心评测中,豆包2.0已与Gemini 3 Pro处于同一梯队。更重要的是,它在实际任务中的表现更稳定:能对复杂任务进行结构化拆解,建立因果链条,规划多步骤流程,并在输出前校验结果。

这种能力对Agent至关重要。Agent的核心是「流程可靠」,只有模型能维持长链路逻辑一致性,工具调用才不会中途偏离,任务执行才不会出现「前期理解正确、后期逻辑断裂」的问题。可以说,推理能力的提升为完整任务执行搭建了稳定的框架。

推理能力决定了Agent的「思考深度」,而多模态能力的升级则拓展了它的「感知范围」。

豆包2.0的多模态能力优化不再局限于展示场景,而是直接针对高频生产需求:截图识别、图表解析、复杂文档阅读等实际工作输入成为优先优化方向。背后的逻辑很实际——企业真实流程中的信息,大量存在于截图、PDF、流程图、设备图纸、报表等非结构化视觉内容中。若模型无法可靠理解这些输入,就难以真正融入生产环节。

除基础识别能力外,豆包2.0在空间理解与运动理解上的进步,也扩大了Agent的感知边界。模型不仅能识别图像中的元素,还能判断它们之间的关联、运动方式和相互作用。

豆包2.0的升级旨在让模型具备更贴近真实世界的输入理解能力。推理能力提供决策结构,多模态感知提供现实上下文,两者结合,使Agent能突破文本任务限制,进入更复杂的生产场景。

当模型既能稳定思考,又能真实感知时,「端到端执行」才具备落地基础。

02

重构Agent能力

推理能力与多模态感知决定了模型的感知广度和思考深度,而能否进入企业流程,关键在于能否稳定完成整条任务链。

豆包2.0的变化正体现于此。

与以往依赖外挂插件或外层工作流拼接的Agent方案不同,这一代模型在底层原生支持多Skills调用、多轮指令持续遵循和高度稳定的结构化输出能力。也就是说,工具调用、搜索、格式控制不再是额外补充,而是模型推理过程的一部分。

这种差异在长程任务中尤为突出。真实企业流程往往不是单次问答,而是一系列连续动作:理解需求、拆解步骤、查询外部信息、调用工具处理数据、生成中间结果、汇总输出。过去的模型即使单步能力强,也容易在多轮执行中出现上下文断裂、目标漂移或输出格式失控的问题。

豆包2.0的改进,本质是让任务链路更可控。其中易被忽视的「格式输出稳定性」,在企业场景中至关重要。

在消费场景中,格式波动只是体验问题;但在企业场景中,格式稳定直接决定流程能否自动化衔接。比如日报今天是表格、明天是散文,可能导致数据系统对接不畅;接口调用若偶尔缺失字段,可能引发整条流水线失败。因此,稳定输出不是美观问题,而是生产可用的前提。

除了增强Function Call、搜索工具调用和多轮指令遵循能力,豆包2.0还通过更灵活的上下文管理机制,缓解了复杂任务中的「断片」问题。模型能在更长执行周期内保持目标一致性,理解当前步骤在整体流程中的位置,减少逻辑跑偏或重复执行的情况。这种持续状态感,才是Agent真正需要的能力。

豆包2.0展现出的完整长程任务执行能力,包括主动任务拆解、时间线推理、复杂知识整合、多轮指令持续遵循,以及长篇内容生成中的结构自检与逻辑一致性维护,都是企业级Agent在真实生产场景中必备的能力。

03

字节的「飞轮效应」与布局野心

字节跳动不仅在模型能力和应用形态上发力,更试图在底层AI云市场拉开差距。

火山引擎正扮演关键角色:将模型能力转化为可规模化交付的生产基础设施。对企业客户而言,大模型的竞争核心是能否提供稳定、低成本、易部署的云端服务,这正是火山引擎近两年的投入重点。

从市场结构看,字节跳动在AI云的优势源于AI原生业务带来的真实生产流量。抖音推荐系统、广告投放、内容理解、实时视频处理等高并发AI场景,长期运行在字节内部基础设施上,使其在推理调度、模型压缩、实时多模态处理和成本控制方面积累了丰富工程经验。火山引擎将这些内部能力产品化后,更贴合企业真实生产环境,而非实验室式的模型服务。

这也解释了豆包大模型2.0发布时为何强调API服务、生产环境适配与价格区间。据悉,豆包2.0 Pro按「输入长度」区间定价,豆包2.0 Pro(32k)输入仅需3.2元/百万tokens,成本远低于GPT 5.2和Gemini 3 Pro;豆包2.0 Lite单价低至0.6元,综合性能全面超越上一代主力模型1.8。

模型只是入口,企业长期使用的关键在于云平台能否持续提供稳定推理成本和弹性扩展能力。当模型进入大规模调用阶段,云市场份额不再只是基础设施之争,而是AI商业化能力的直接体现。

从这个角度看,梁汝波将字节2026年关键词定为「勇攀高峰」,也确认了一条完整路径:从底层模型能力,到开发工具层,再到云端服务生态,字节正构建闭环的AI实用化通路。而火山引擎争夺的市场份额,是这条通路形成产业壁垒的关键节点。

如果说模型决定技术高度,那么云的市场占位,才决定这套能力最终能覆盖多少真实场景。

本文仅代表作者观点,版权归原创者所有,如需转载请在文中注明来源及作者名字。

免责声明:本文系转载编辑文章,仅作分享之用。如分享内容、图片侵犯到您的版权或非授权发布,请及时与我们联系进行审核处理或删除,您可以发送材料至邮箱:service@tojoy.com