AI招聘人员马上上任,是公正的裁决还是偏见?

由于企业纷纷选择AI技术自动筛选简历,对面试进行评估,我们不禁会提出疑问:「AI招聘官」到底是铁面无私,一视同仁,还是携带偏见越走越远?

婴儿您是一名即将毕业的应届毕业生,对未来充满希望,决定毕业后在职场上也要叱咤风云。

但是,听到AI取代人类的你也万万没想到,找工作时遇到的第一个面试官,竟然是AI。

到时候,你登录系统,按照指示检查身份信息,检查摄像头是否打开,麦克风是否正常,坐直,最后在电脑前按下确定。

伴随着机械AI考官的理性和断断续续的提问,一次人机面试开始了。

申请新副本:「铁面无私」人机交锋

又到了一年的毕业季,上面的「你」也许是千千万万毕业生的缩影。

人工智能革命已经开始,几乎涵盖了每个人职业和个人生活的方方面面,包括学业面试和工作招聘。

企业管理层越来越意识到,人工智能可能会在供应链管理、客户服务、产品研发、人力资源等环节带来更高的效率。

在这些人中,可以用来招聘的,是传说中的。「AI面试官」。

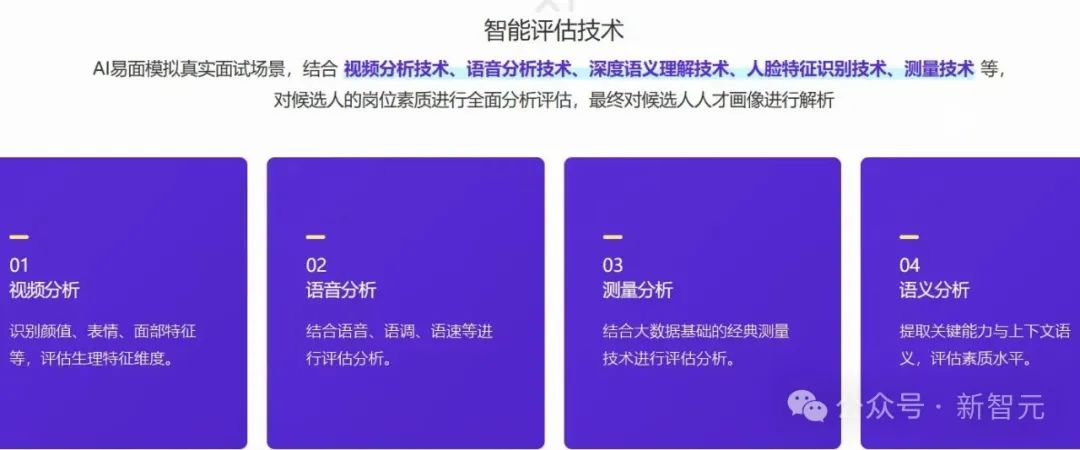

事实上,它是一个问答机器人,可以实时交互。通过语义识别、表情识别、声音识别等多种算法,对面试官的答案进行分析整理,最后给出参考分数。

例如,AI比人类在根据工作要求筛选简历时具有更高的准确性和质量优势,但在相对简单、流程标准化的初试中,也可以以最快的速度完成初试。

另外,AI面试官的确是物理上的。「铁面无私」,能避免面试官因偏见、歧视、亲缘等问题而产生的误差,提高决策的公平性和一致性。

根据《2023年中国网络招聘产业发展调查报告》,AI视频面试在应用场景中的比例已达31.8%,而且这一比例将来只会与日俱增。

不只是中国,在全球范围内使用AI来提高招聘效率也越来越普遍。

快速移动的巨头联合利华发布了一组数据:AI可以帮助节省10万小时的面试时间,每年可以节省100万美元的人工成本。

但是,虽然AI的引入可以降低成本,但人工智能的本质和背后的训练数据都有人类的品牌,不可避免地会引入人类的偏见,甚至在原有偏见的基础上。「得寸进尺」。

扩大人类的偏见

虽然在招聘中使用人工智能的一个原因是为了更客观,但是许多研究表明,这项技术实际上很可能存在偏见。

造成这种情况的根本原因是数据。假如数据有偏见和缺陷,人工智能也会复制这一缺陷。

The 在采访了22位人力资源专业人士之后,Decoder发现了两种常见的招聘偏见。——「刻板印象成见」和 「类似的成见也是如此」。

「刻板印象成见」正如其名称所示,它来自于对某个群体的刻板印象。比如喜欢某个性别的求职者,就会导致性别不平等。

「类似的成见也是如此」,也就是说,招聘者喜欢与自己有相似背景或爱好的求职者。

这些偏见会影响招聘过程的公平性。它们可能会流入历史招聘数据,然后用来训练人工智能系统,导致人工智能偏见。

例如,从2014年开始,亚马逊公司开始开发用于简历筛选的人工智能,希望从大量简历中快速挑选出最理想的候选人。

然而,这项技术仅仅过了一年,就有人发现,AI的筛选结果包含了强烈的性别倾向。

即使在备选简历中没有明确表示性别,AI也会在文字的线索中寻找。「线索」,比如「女子棋社队长」,或者毕业于女子大学。

据知情人士透露,这种人工智能培训材料是企业过去10年的就业历史,但在科技领域,长期的职业刻板印象和「亲男文化」,男性员工的数量大于女性,尤其是技术岗位。

亚马逊在2017年放弃了AI模型的筛选简历。

这一偏见的持续存在表明,无论是否使用AI,都必须仔细规划和监控,以确保招聘过程的公平性。

人能否消除偏见?

除人力资源专家外,The Decoder还采访了17名人工智能开发者,希望研究如何开发人工智能招聘系统,以减少招聘偏见,而不是增加招聘偏见。

在采访的基础上,他们建立了一个模型,让人力资源专业人员和AI工程师在研究数据和开发算法的过程中来回交换信息,质疑和消除先入为主的概念。

但是,研究结果表明,实施这一模式的困难在于人力资源专业人员与AI开发人员之间的教育与专业差异。

这些差异阻碍了有效沟通、合作甚至相互理解的能力。

传统上,人力资源专业人员接受员工管理和组织行为的培训,而AI开发人员精通数据计算和技术,这将导致合作中的误解和不协调。

怎样优化AI?+HR

近日,皮尤研究中心对11004名美国人进行了调查,发现66%的人不愿意向AI雇主申请工作。

只有32%的人说他们会申请,而其他人则不确定。而且71%的人反对AI做出的招聘决定。

所以,如果企业和人力资源行业想要解决AI招聘中的偏见问题,就需要做几个改变。

第一,要对人力资源专业人员进行培训,以信息系统开发和人工智能为重点的结构化培训尤为重要。

训练内容应该包括AI的基本原理,如何识别技术中的偏见,减少这些偏见。

另外,更好地促进人力资源专业人员与AI开发人员的合作也很重要。

企业应建立一个包括人力资源局AI专家在内的团队。这样有助于消除沟通鸿沟,更好地协调双方的工作。

另外,建立具有多元文化的高质量数据,确保AI在招聘过程中所使用的数据能够代表不同的人口。

最后,各国需要制定使用AI的指导方针和道德标准,以帮助建立信任,保证公平。各组织应在AI决策过程中实行问责制,提高透明度。

通过采取这些措施,我们可以创建一个更具包容性和公平性的招聘系统。由于AI擅长分析和参考客观数据决策,所以它被用作辅助工具,而不是缺乏训练。「蠢」以及复制偏见「坏」贸然成为命运的判官。

参考资料:

https://the-decoder.com/what-will-a-robot-make-of-your-resume-the-bias-problem-with-using-ai-in-job-recruitment/

本文来自微信微信官方账号“新智元”,作者:新智元,36氪经授权发布。

本文仅代表作者观点,版权归原创者所有,如需转载请在文中注明来源及作者名字。

免责声明:本文系转载编辑文章,仅作分享之用。如分享内容、图片侵犯到您的版权或非授权发布,请及时与我们联系进行审核处理或删除,您可以发送材料至邮箱:service@tojoy.com