AI按需智能:实习生执行+总监指导的新竞争维度

真的想隔空喊Anthropic别再卷了,他们又双叒叕推出新功能了:

Advisor策略已纳入Claude的API工具库,当Sonnet或Haiku在运行中遇到难题时,会向Opus咨询解决方案,随后继续运行,所有操作都在一次API请求内完成。

说实话,这种做法在开发者社区里一点都不新鲜,很多(预算有限的)开发者在自己的工作流中就是这么操作的:用低成本模型处理简单任务,仅在需要深度推理时才调用高价模型,只是需要手动切换模型。如今Anthropic将这个「经济型」工作流产品化,变成了一行代码就能启用的官方功能。

「实习生」执行任务,「总监」提供指导

在常规的AI agent架构中,常见的做法是让最强的模型担任指挥,将任务拆解成小块,分配给低成本模型执行。强模型在上层管理,弱模型在下层执行,呈现自上而下的结构。

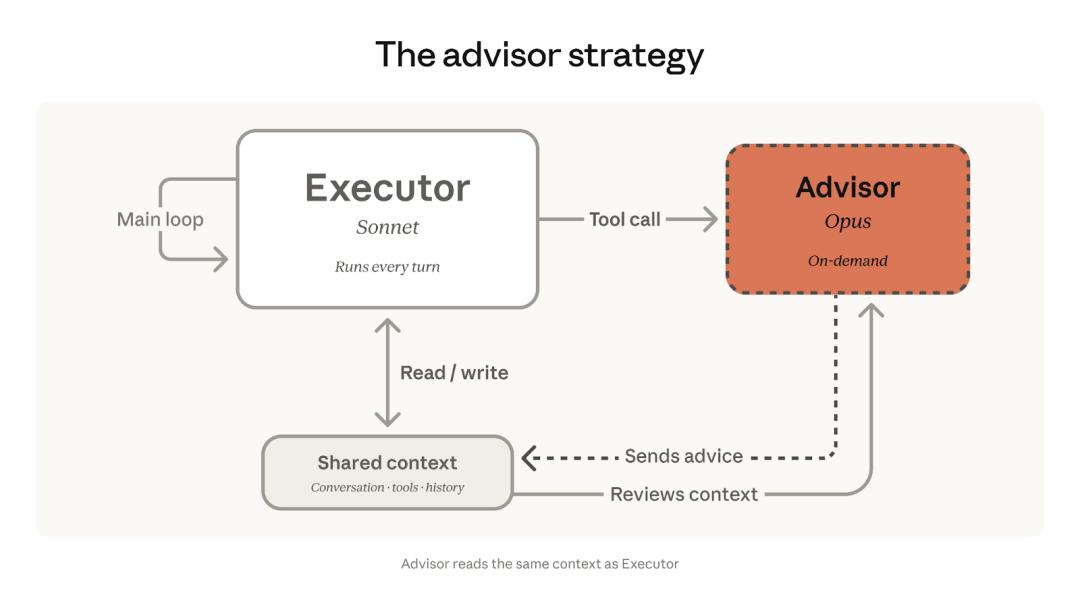

而Anthropic的advisor策略却反其道而行之,让弱模型作为主力,强模型充当顾问。

具体来说,Sonnet(或更便宜的Haiku)作为「执行者」全程处理任务——调用工具、读取结果、迭代操作。当它遇到自己不确定的决策点时,比如代码架构的选择,用方案A还是方案B?它不会盲目猜测,而是主动发起一次「举手提问」的tool call,把当前上下文和具体问题发送给Opus。

Opus作为「顾问」查看后,不会直接参与执行,不编写代码也不修改逻辑,仅返回简短建议(通常400-700个token):「选择方案A,原因是XYZ,注意Z部分。」Sonnet收到建议后继续执行。整个过程对用户不可见。

换个通俗的比喻:这就像实习生工作时遇到难题,举手向总监请教。总监指明方向后,实习生继续工作。总监按总监的薪资标准计费(Opus价格),但只说了几句话,所以费用不高;实习生全程工作(Sonnet/Haiku价格),但单价较低,因此总成本很低。

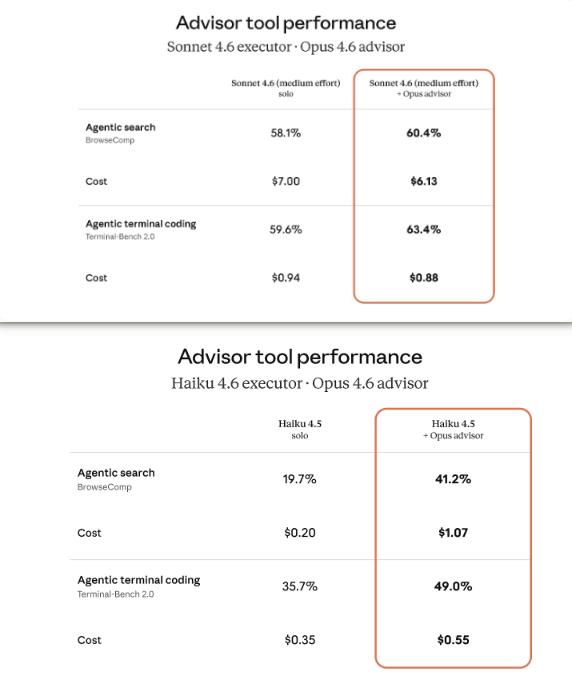

Anthropic自身的测试数据显示:

- Sonnet+Opus advisor在SWE-bench Multilingual上的表现比单独使用Sonnet高2.7个百分点,同时成本降低11.9%;- Haiku+Opus advisor在BrowseComp上得分41.2%,是单独使用Haiku(19.7%)的两倍多,但成本仅为Sonnet的15%;- Bolt的CEO评价:「复杂任务的架构决策明显更优,简单任务完全没有额外开销」;- Eve Legal的机器学习工程师表示:「在结构化文档提取任务中,Haiku通过advisor动态提升智能,达到前沿模型质量,成本降低5倍」。

即使是实习生也不能太笨拙

这个模式有一个容易被忽视的前提:实习生必须足够聪明,能准确判断自己何时能力不足。

这本质上是advisor功能的核心支撑,是整个功能能运作的前提。一个真正能力差的模型,根本不知道自己不懂,还可能自信地选择错误方案,无知者无畏。这种情况下不会触发advisor调用,比直接用差模型全程运行更危险:由于对话仅在模型间进行,不会推送给用户,你以为Opus掌控全局无需担心,实际上它从未被调用过。

这就是为什么Anthropic的advisor工具目前只支持Sonnet和Haiku作为执行者,而非任意模型。这两个模型在Claude家族内部经过充分训练,知道何时该求助、何时能独立完成。

这个策略的好处很明显:降低用户门槛,无需懂工程就能采用最佳实践。但它也有一个微妙的副作用:省了钱,但没有完全省到位。

当开发者自己搭建模型路由时,可以自由组合任何公司的模型:用DeepSeek做筛选,用GPT-5做推理,用Gemini做摘要,哪家便宜用哪家。这是一种开放、完全自主设计、跨平台的省钱策略。

但advisor工具仅支持Claude家族内部的模型,执行者必须是「嫡系」的Sonnet或Haiku,顾问必须是Opus。不能用GPT当顾问,也不能用Gemini当执行者。

理论上任何模型都可以通过tool call调用另一个模型,Anthropic这样做完全出于产品策略。

既然思路并非原创,自己动手做一个类似的,组合不同模型可行吗?Advisor工具是模型间有交互的场景,假设希望DeepSeek作为主力,遇到难题时把上下文发给Claude咨询建议,Claude返回后DeepSeek继续执行,可能会出现几个问题:

- 输出格式:Claude返回建议时的结构化方式(比如用XML标签包裹计划步骤),DeepSeek不一定能准确解析和遵循。嫡系模型之间的格式是对齐的。

-「语言」差异:每个模型有自己偏好的思考和表达方式。Opus给Sonnet的建议,措辞和逻辑结构是Sonnet最容易理解和执行的。Claude给DeepSeek的建议,DeepSeek能读懂,但执行精准度会打折扣——就像英语母语者给英语很好但非母语的人下指令,大部分情况没问题,但在细微之处会有理解偏差。

- tool use格式不兼容:不同厂商的function calling格式有细微差异。Claude的tool use和DeepSeek的tool use在JSON schema、参数传递方式上不完全相同。跨厂商构建agent链路时,中间的格式转换是个难题。

使用官方原生功能自然最好,但一旦工作流加入advisor,就意味着被锁定在Claude生态中。这是一个精妙的商业设计,Anthropic没有阻止用户省钱,显然还帮用户省钱,但它把「省钱」这个行为本身用作加固平台黏性的手段。

那性价比真的高吗?毕竟,DeepSeek再怎么说花的也是人民币,Claude烧的可是美金啊。

社区先实现,Anthropic只是加了个按钮

Advisor的思路并不新鲜,更像是Anthropic把已存在的实践包装成官方产品。

开发者社区中最常见的省钱技巧就是「模型路由」(model routing):用低成本模型处理简单任务(分类、摘要、格式化),仅在需要深度推理时调用高价模型,有大量开源项目实现这种模式。

现在我们常用的很多功能,都曾是开发者社区手动组装的:如今各家AI几乎标配的「Project」项目空间,曾是开发者在API层面手动拼接system prompt+文档上下文,所有内容围绕一个项目;Artifacts的雏形也是开发者用Claude/GPT/Gemini生成HTML/React组件,然后手动粘贴到预览器运行,现在这个功能也能在各家终端实现。

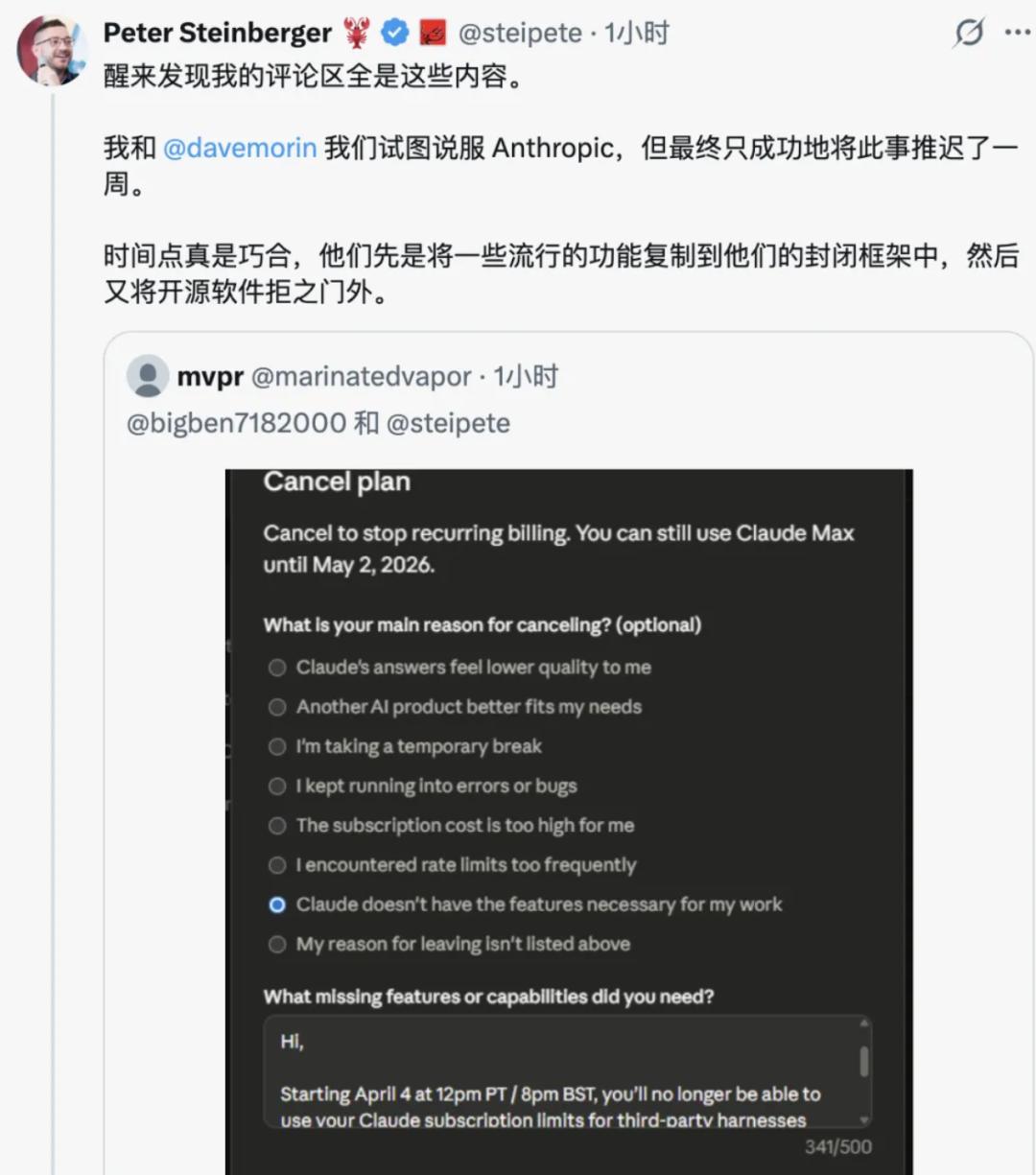

最近的一次是Anthropic推出Dispatch(手机遥控桌面)和Channels(IM集成),这就是Claude自己的OpenClaw,随后却转头「卸磨杀驴」,禁用了OpenClaw。

从产品策略来看,刚发布的Advisor策略反映出在算力紧张的情况下,性价比不仅是用户的追求,也是企业的痛点,是AI定价模式的一大趋势。

常规的AI定价很简单,选一个模型,按token付费:要顶级质量就用Opus,要便宜就用Haiku,选定后就是固定价格。本质上是在卖「算力时间」,即购买了多少token的处理能力。

Advisor模式更灵活,不再选择固定的智能级别,而是让系统根据任务复杂度动态分配智能,厂商也能更灵活地分配算力资源。

对最终用户而言,这是好事:不用为仅需2分难度的任务,支付需要深度推理的100%Opus价格。但对AI企业来说,这也意味着新的竞争维度,不再只是单一的参数、价格比拼,而是转向智能性价比的竞争。

本文来自微信公众号“APPSO”,作者:Selina,编辑:李超凡,36氪经授权发布。

本文仅代表作者观点,版权归原创者所有,如需转载请在文中注明来源及作者名字。

免责声明:本文系转载编辑文章,仅作分享之用。如分享内容、图片侵犯到您的版权或非授权发布,请及时与我们联系进行审核处理或删除,您可以发送材料至邮箱:service@tojoy.com