文科生与AI的真实联结:跳出标签化叙事,看见学科的深层价值

「文科生也能搞AI」「逆袭!」在中文互联网里,文科与AI的组合,俨然成了固定话题。

每隔一段时间,这个标签就会贴在某个人身上,制造出短暂的流量热潮。至于到底是逆袭故事还是嘲讽素材,全看评论区的风向。

一个标签,三种不同路径

最近的例子是AI创业者杨天润,他出身金融领域,正在开发多智能体协调平台。他自称「一行代码都不会写的文科生」,搭建了一组AI Agent,向GitHub热门开源项目OpenClaw批量提交代码贡献。

他想验证一个假设:完全不懂技术的人,能否仅靠指挥AI,就参与到顶级开源项目中。

结果是:提交了134个PR,21个被合并,113个被拒绝。前几个PR质量尚可,得到维护者认可并合并。但当他给Agent下达加速指令后,情况很快失控——Agent开始像流水线一样批量生产低质代码,还在评论区疯狂@维护者催促审核。OpenClaw管理员介入清理,GitHub随后修改了PR提交上限规则。

黑红也是红,红过之后再黑反而更受关注。杨天润被包装成「文科生逆袭」的代表,他本人似乎也乐于接受这个角色。在接受品玩采访时,他说:

不懂代码反而是优势。AI是梵高,你是个小画家,有什么资格告诉梵高中间该用什么笔触?

细想之下令人不安。他把「不懂底层结构」当成一种解放:不需要知道系统在做什么,只要告诉它想要什么。结果就是当Agent开始批量刷垃圾代码时,他连问题出在哪都诊断不出来,因为他根本不知道自己在操作什么。

他以为自己在指挥梵高,实际上是在盲开一辆没装刹车的车,还不知道刹车在哪里。

围绕这件事的讨论也走向两个极端:要么「文科生也能做AI」,要么「文科生别碰AI」;前者被视为跨越鸿沟的壮举,后者则成了掉进鸿沟的笑话。

如果我们对「文科生做AI」的想象只有这些,那就太狭隘了。

Claude为何需要哲学家

我们之前提到过,Anthropic的办公室里有一位真正的文科生,深度参与了Claude的开发。她不是测试Claude能否写代码,也不是检查它的数学能力,而是和它进行漫长的对话,内容涉及价值观、措辞分寸以及「面对不确定性该如何表达」。

Amanda Askell是苏格兰人,今年37岁。她的职业道路本身就不寻常:大学最初学美术和哲学,后来转向纯哲学,在牛津拿到BPhil学位,又在纽约大学获得哲学博士。她的博士研究方向是无限伦理学中的帕累托原则:当涉及无限数量的道德主体或无限时间跨度时,伦理排序应遵循什么规则。

这听起来像是离硅谷最远的学术方向,但她先后加入OpenAI的政策团队和Anthropic的对齐团队。2021年起,她成为Anthropic「性格对齐」团队负责人,工作重点是塑造Claude与人类对话的方式、在不确定时的立场表达,以及在价值观冲突中的判断。2024年,她入选TIME100 AI榜单。《华尔街日报》描述她的日常工作是「研究Claude的推理模式,用超过100页的提示词修正它的行为偏差」。据说她是这个星球上和Claude对话次数最多的人。

为什么AI公司需要哲学家做这件事?答案藏在一些具体的技术选择里。

今年1月,Anthropic发布了一份80页的文件,被称为Claude的「宪法」。媒体关注的是文件末尾关于AI意识的推测——当然,老板Dario Amodei也话里话外「暗示」了这一点。

但更值得注意的是其底层逻辑:教AI理解为什么要这样做,比告诉它应该怎样做更有效。这是一个技术判断,认为内化价值比遵守规则能产生更可靠的行为,而这种判断的知识根基,来自一个学美术和哲学的人。

Amanda的案例回答了一个问题:被视为「无用」的学科知识,能否成为技术系统的核心能力?答案是不仅能,而且没有她的哲学训练,Claude的对齐问题用现有的工程方法解决不了。

被重新定义的学科

如果说Amanda的故事表明某些「文科」学科训练可以成为AI的核心能力,那么林俊旸的故事则揭示了更重要的一点:有一整个学科,一直在大模型技术栈的底层发挥作用。

林俊旸离开通义千问后,中文互联网的报道反复提到他有应用语言学背景。传着传着,就变成了他是「文科生」。

这个标签和杨天润的一样,但其实被严重扭曲了。

林俊旸学的是语言学,这是一个伞状学科,分支涵盖语言教学、语言政策、翻译研究,也包括计算语言学。可以说,计算语言学就是自然语言处理(NLP)的基础。

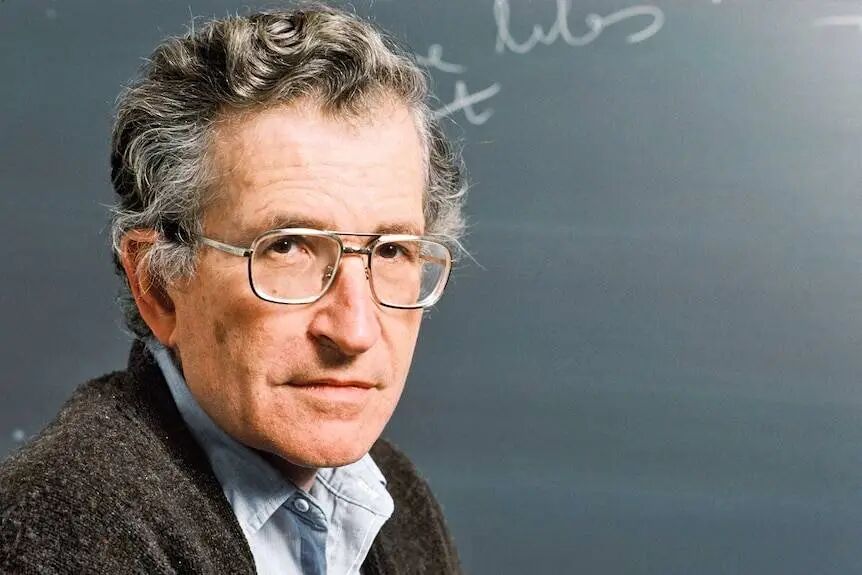

乔姆斯基在1950年代提出形式语法,这个理论工具直接催生了早期NLP的句法分析技术;Daniel Jurafsky和Christopher Manning,这两位NLP领域被引用最多的两本教科书的作者,都是语言学出身。

乔姆斯基

换句话说,「学语言学的人做NLP」就像「学物理的人做芯片设计」一样,是正统路径,并非跨界。

那种「意外感」完全是中国语境造成的。高考文理分科的制度惯性,把「语言学」塞进了「文科」的认知框架里。但语言学的核心方法论——形式化、统计建模、语料标注——本质上是工程思维。林俊旸在北大的合作者孙栩、苏祺,都是NLP方向的研究者;他2019年加入达摩院时进入的是NLP团队。这不是一个文科生误入技术领域的故事,从一开始就不是。

比「林俊旸不算文科」更值得探讨的,是语言学在大模型技术栈中实际扮演的角色。它比大多数人想象的更深、更隐蔽。

比如分词。所有语言模型处理文本的第一步,是把输入切成模型能处理的基本单元。英语有空格作为天然的词边界,看起来简单。但中文没有空格,而且每个标点符号的用法都能影响句子的意思。

「我在北京大学读书」是切成「我/在/北京/大学/读书」还是「我/在/北京大学/读书」?这不是一个有标准答案的工程问题,取决于对中文词汇结构和语义单元的理解。

2024年底有研究者专门发表论文,讨论如何优化Qwen模型的阿拉伯文分词效率,因为通用方案处理这类语言时效率明显下降。Qwen系列在多语言上的表现,不是把所有语言当成英语的变体,而是基于对语言间结构性差异的理解做出的设计选择。

再比如反馈对齐。RLHF流程中,标注员需要判断模型的两个回答哪个「更好」。这个判断看似主观,背后却有一套语言学研究了几十年的框架:语用学。

标注员评估「好的回答」时,实际上是在判断合作原则(回答是否提供了足够但不过量的信息)、会话含义(回答是否捕捉到用户真正想问的,而非字面意思),以及语境适切性(同样的内容,用这种方式说在这个场景下是否得体)。

「Helpful, Harmless, Honest」这套被广泛使用的对齐标准,本质上就是语用学基本原则的工程化转化。

从林俊旸的学术轨迹中,也能看到非常语言学的研究风格。他主导的OFA(One For All)2022年发表于机器学习顶级会议ICML,至今被引用近1500次。这个工作的核心思路不是为每个任务搭建专用方案,而是用一个足够通用的序列到序列框架,把图像生成、视觉定位、图像描述、文本分类等跨模态任务统一起来。

从OFA到Qwen-VL(被引超过2200次),再到Qwen2.5和最新的3.5,一条清晰的线索贯穿始终:与其为每个问题发明一套专门的解法,不如找到一个足够好的通用框架,让所有问题在同一个框架里解决。

用最少的规则覆盖最多的现象——这正是语言学几十年来的核心追求。生成语法的全部学术野心,就是找到一套有限的规则系统,能够生成无限的语言表达。OFA的架构哲学与此一致,为每种语言现象写一套专门规则不现实,应该寻找一个底层框架来统一它们。

林俊旸做大模型做得好,不是因为语言学背景「也能」做AI,而是语言学训练塑造了一种特定的学术品味,即对统一性和形式化的偏好。这种品味在大模型时代,恰好是核心竞争力。

看不见的地基,看得见的需求

三个人,同一个标签,三种完全不同的路径。

杨天润不懂底层结构,把「不懂」当优势,结果失控。这是「文科生做AI」的空壳版:标签制造了流量,但没有任何学科训练在起作用。他的故事恰恰体现了——当「文科生」只是一个营销标签时,会发生什么。

Amanda Askell的哲学训练构成了对齐问题的核心方法论。没有她,Claude就不是现在的Claude。她的故事回答的问题是,被视为「无用」的学科知识,能否成为技术系统的核心能力。答案是不仅能,而且不可替代。

林俊旸的语言学训练构成了大模型技术栈的隐性基础设施。他的「文科背景」从来不是跨界,而是正统路径。他的故事回答的问题是,文科对先进技术的贡献到底有多「隐性」,它是否正在变得显性。

而终极问题并不是「文科生能不能做AI」,而是我们能否意识到:用表面的「有用与否」评判知识与学科,已经过时了。

随着大模型从追求能用好用,走向追求可靠和可控,这些被归入「文科」的学科训练,价值不是在缩小,而是在扩大。模型越强大,越需要精确的评估体系来诊断它在哪里、为什么出错,也越需要理解语言和意义的复杂性来设计更好的训练数据,越需要在对齐问题上做出有学科敏感度的判断。

「文科生逆袭」这个叙事——无论是赞美还是嘲笑——掩盖了真正正在发生的转向:看不见的地基,正在变成看得见的需求。

本文来自微信公众号“APPSO”,作者:发现明日产品的APPSO,36氪经授权发布。

本文仅代表作者观点,版权归原创者所有,如需转载请在文中注明来源及作者名字。

免责声明:本文系转载编辑文章,仅作分享之用。如分享内容、图片侵犯到您的版权或非授权发布,请及时与我们联系进行审核处理或删除,您可以发送材料至邮箱:service@tojoy.com