A16z重磅预测:AI虚拟人将孕育许多市值数十亿美元的行业巨头

作者 |Justine Moore 这是一家风险投资公司 a16z 合作伙伴,特别是在消费领域,致力于消费。 AI 公司投资。在斯坦福大学拥有经济学学士学位和工商管理硕士学位。

来源 | Z Potentials 管理智慧 AI

咨询合作 | 13699120588

本文仅代表作者自己的观点。

摘要

AI 从虚拟模型架构来看 CNN、GANs 演变至 Transformer 扩散模型,实现从单一面部驱动到半身 / 全身动态生成的飞跃,嘴型同步与多模态的协同表现明显提高。

AI 虚拟人类的应用范围很广,个人客户领域为创意表达开辟了一个新世界,中小企业可以低成本做广告,大企业在员工培训等多个领域深度应用。。

当下 AI 在角色衔接、面部动作、身体动作、与环境互动、即时应用等方面,虚拟人们期待着更多的突破,许多创新即时应用领域有望在未来诞生。

当 AI 不再局限于内容生成,而是当内容具体化时,世界会发生怎样的变化?当下,AI 通过视觉和听觉维度的图灵测试,灵活运用了生成高度真实照片、视频和语音的技术。并且下一次重大进展,重点是 AI 虚拟人类领域:将特定的人脸与独特的声音相结合,创造出能自由交流的生动角色。

或许有些人会想,能不能简单地生成一个人脸图像,让它移动起来,配上画外音?实际操作并非如此简单。其中,考验绝不仅仅是准确实现嘴型同步,更重要的是保证脸部情绪与身体语言一致,实现自然流畅的配合。想象一下,如果一个人的嘴因为惊讶而大张旗鼓,但他的脸颊和下巴却站着不动,这一幕应该是多么奇怪。或者,声音充满了兴奋,但对应的脸没有波澜,所以精心制造的类人错觉会瞬间分崩离析。

令人欣慰的是,我们已经见证了这一领域的实际进展。AI 虚拟现在广泛应用于内容创作、广告投放、企业沟通等诸多领域。尽管现在的虚拟人大多只是可以说话的头部形象,虽然有一定的实用性,但是功能有明显的局限性。然而,回顾过去几个月,许多令人兴奋的创新成果不断涌现。可以预见,在不久的将来,这一领域将迎来更大的突破和发展。

本文以对为基础 20 余款 AI 虚拟人产品的个人体验和深度测试,我将深入分析当前可行的技术方案、未来的发展趋势,以及当今市场上最突出、印象深刻的产品。 AI 虚拟商品。

研究如何发展演变?

AI 虚拟人是一个具有独特挑战性的研究课题。要打造一个会说话的人脸形象,模型必须掌握视位投影中逼真的音素,即声音中的音素与相应的嘴型动作视位之间的关系。一旦这种投影出现偏差,嘴巴的动作和声音就会不同步,甚至完全脱节。

问题的复杂性在于,说话的时候不仅仅是嘴巴在动。脸的其他部分会一起运动,上半身有时会参与,甚至手可能会动。而且,每个人都有自己独特的说话风格。想想你说话的样子,然后比较你喜欢的名人:即使你说同样的话,双方嘴巴的动作也会有所不同。如果你把嘴型同步到名人脸上,效果会很奇怪。

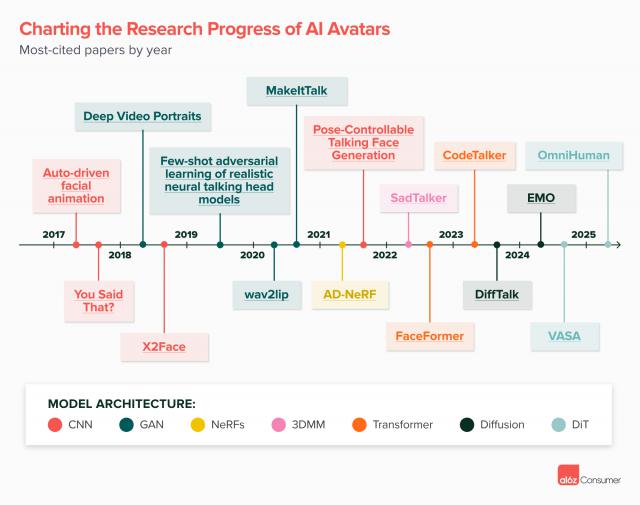

近年来,从研究角度来看,这一领域发生了显著变化。自 2017 从2000年开始,我仔细阅读 70 多篇相关 AI 会说话头像的论文,可以清楚地看到模型架构的发展脉络:从卷积神经网络(CNNs)并产生对抗网络(GANs),到达基于三维的神经辐射场(NeRFs)以及三维可变形模型等方法,然后演变成变换器。(transformers)和扩散模型,而且最近发展成了基于变换器架构的扩散模型(DiT)。下面的时间线标注了每年引用量最高的论文。

在 AI 在该领域,虚拟人类相关模型的生成质量和能力已经完成了飞跃式提升,和早期相比,简直不一样。最初的方法极其有限。以一张人物照片为例。首先覆盖人物脸部的下半部分,然后根据音频输入的目标面部特征生成新的嘴部动作。但是,这些模型训练所依赖的优质嘴型同步数据词库规模有限,而且大部分数据都只是紧紧地框定人物的脸部进行裁剪。就“让奥巴马对口说话”的效果而言,为了实现相对逼真的呈现,需要收集目标人物近几个小时的视频模板,最终的输出结果受到多样性和感染力的影响。

另一方面,模型的灵活性和强大程度令人惊叹。在同一个视频中,它们不仅可以产生半身甚至全身动作,塑造生动健谈的面部形象,还可以使背景呈现动态变化。这些新的模型训练方法更类似于传统的文本转换视频模型,依靠大量的数据集。为了在各种动态中始终保持嘴型同步的准确性,模型采用了丰富多样的技术手段。

早在今年 2 月亮,推出字节跳动 OmniHuman-1 模型便率先显示出这一前沿趋势(这个模型最近已经存在了 Dreamina 为用户提供在线平台)。整个市场发展迅速,3 月,Hedra 发布 Character-3 经过我们的直接对比测试,该模型在大多数实际应用场景中表现得非常出色。Hedra 强大的不仅仅是人类角色,像是 Waymo(知名自动驾驶公司)打造会说话的虚拟形象,客户也可以通过输入文本灵活设定角色的情绪状态和动作表现。

伴随着吉卜力工作室风格热潮等行业趋势的推动, AI 全新的动画应用领域如雨后春笋般涌现。

AI 现实世界中虚拟人的多样化应用

AI 虚拟人类的使用场景可谓应有尽有。不妨想象一下,每当涉及到与人物互动或观看人物演讲视频的场景,都有自己的立足之地。当前,从个人客户到中小企业,甚至大企业,已经在各个领域得到应用。 AI 虚拟人。

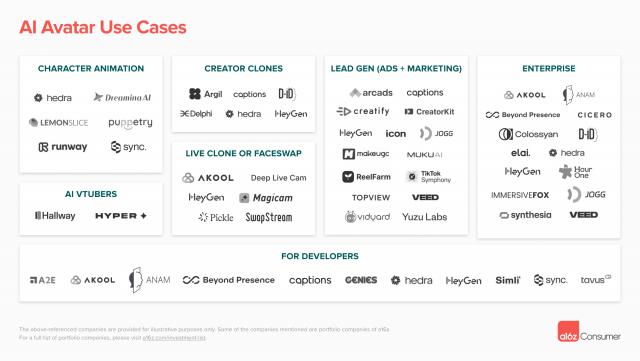

这是一个初始的市场结构图。这个领域发展迅速,商品之间的差异定义仍然广泛。理论上,许多产品可以为大多数甚至所有这些应用领域创造虚拟人。然而,在实践中,构建一个高效的工作流程并准确校准模型并在各个方面脱颖而出并不容易。下面,我们将逐一整理市场各个细分领域的应用。 AI 具体的虚拟案例。

个人客户领域:角色创作新时尚

现今,借助 AI,一般人只需一张图片,就可以轻松打造动画角色,这无疑为大众的创意表达开辟了一个全新的世界。渴望使用 AI 对于讲故事的人来说,这个突破意义重大,怎样夸奖也不过分。回顾早期阶段 AI 视频经常被吐槽为“照片堆砌的ppt”。其中一个症结就是缺乏自然对话的人物,声音通常只是一种枯燥的绘画外音方式。

而且当创作角色能够张口交流时,内容瞬间变得生动有趣。除传统的叙事视频外,每个人都可以借助 AI 创作不同风格的作品,如虚拟主播,AI 播音员和音乐视频等。此处附加的经典视频均来自此, Hedra 平台。在 Hedra 事实上,用户只需上传一张初始照片,再配上一段音频剪辑或脚本,就可以塑造出灵动、生动、健谈的人物形象。

假如你手头的素材是一个视频,Sync 工具可以派上大用场,它可以准确匹配嘴型,使人物的面部动作和音频紧闭。如果你想用真实的人类表演来驱动角色的动作,Runway Act-One 和 Viggle 等待专业工具可以帮助你一臂之力,实现创意设想。

在诸多运用 AI 在创作角色动画的创作者中,Neural Viz 这是我的心。它创造的《单一宇宙》系列大胆地想象了一个由格卢伦人主导的后世界,充满了奇怪的想象力。如今,加入这个领域的门槛大大降低,不难预见。AI 精彩的表演即将迎来爆发式的增长,甚至会催生出一批独特的虚拟网红,这只是时间问题。

随着虚拟人员实时直播技术的不断完善,我们可以预见,许多面向消费者的公司将虚拟人员深入到操作界面中,成为关键组成部分。想象一下,当你学习英语的时候,陪伴你的不再是冷漠,没有爱情的电子声音,而是一个生动的、生动的、实时的互动。 AI “专属教练”。像 Praktika 这样的先锋公司,已经开始了这种创新尝试。随着时间的推移,这种人机交互方式必将越来越普及、自然,融入到大众日常生活的方方面面。

中小型企业:挖掘潜在客户的新工具

当今数字化运营浪潮中,广告领域率先转变为 AI 虚拟人大展身手的“主阵地”。在过去,公司通常需要聘请专业演员来建立一个庞大的制作团队,这需要大量的人力、物力和财力。如今,借助 AI,企业只需轻点鼠标,就可以让惟妙惟肖的虚拟人物为自己的产品摇旗呐喊。以 Creatify 和 Arcads 以这个前沿企业为例。公司只需要提供产品链接,就可以一站式完成广告制作的全过程:从精心雕刻剧本,到选择合适的辅助镜头和产品图片,再到精准“选择”虚拟演员,一气呵成,无缝衔接。

这种变化彻底打破了传统广告制作成本的堡垒,让很多中小企业成为广告推广的舞台中心。电子商务企业、游戏制造商和消费应用开发公司,AI 生成广告的方式非常流行,热度居高不下。也许,你在刷 YouTube、TikTok 时间,不经意间就已经被这种事了。 AI “吸粉”广告。目前,B2不仅尝到了面向消费者的公司的甜头,B 该领域的企业也在借助商机的帮助下,敏锐地抓住了商机 Yuzu Labs、Vidyard 等待先进工具,巧用 AI 虚拟化的人,进行内容操作,或进行精确的个性化推广,开拓新的业务渠道。

在实际制作过程中,很多产品会将虚拟演员的形象(既可以是现实人物的复制品,也可以是原创独特的人物)与产品照片、精彩视频片段、适配音乐等多种素材有机融合。用户不仅可以独立控制各种材料的呈现位置和节奏,还可以创造出独特的创意风格;还可以一键打开“智能管理”模式,让系统根据产品特点和营销目标一键生成醒目的视频。剧本创作阶段同样灵活,不仅支持用户亲自操作,而且融入独特的构思;也可以借助 AI,快速生成专业的脚本框架,赋能创作。

大企业:大型内容产生的新引擎

对大企业而言,AI 虚拟化人类的应用范围早已突破营销界限,在多个关键领域深度赋能,发挥着不可低估的作用。

•员工的学习和发展:大企业员工规模庞大,员工培训教育需求复杂。在培训教育视频的支持下,从新员工引导,到合规政策解读,商品知识科普,再到技能提升,都是不可或缺的。传统的制作方法费时费力, Synthesia 等前沿 AI 工具的出现,彻底创新了这种局面。它可以自动化内容创作过程,大大缩短生产周期,实现快速、大规模的生产。例如销售职位,销售人员可以借助销售职位。 Anam 等待产品中的虚拟人物,反复模拟谈判情景,沉浸式磨练谈判策略,切实提高业务能力,使训练效果事半功倍。

•本地化内容定制:跨国企业的客户和员工遍布全球,内容本土化尤为重要,以适应不同地区的文化、语言差异。以前本土化工作繁琐复杂,现在 AI 虚拟人使这个难题得以解决。公司可以通过智能技术快速更换视频中的语言、文化元素,准确适应不同地区的受众。再搭配 ElevenLabs 公司提供的先进在线翻译技术,可以轻松将同一个视频转换成几十个语言版本,语音自然流畅,完全不违和,帮助企业跨越语言鸿沟,深入融入全球市场。

•提高高管形象扩展和影响力:高管形象在各类企业内部沟通和对外品牌塑造中尤为重要。借助 AI 企业可以复制高管形象的虚拟人,打造专属数字分身。从此,在产品发布、重要节日问候等场合,其数字分身可以准确传递信息,无需高管亲自拍摄,大大扩大了高管的知名度覆盖面。此外,Delphi、Cicero 创新公司还为公司思想领袖搭建了与公众深度互动的桥梁,打破时空限制,让领导者轻松回应来自各方的问题,进一步加强企业品牌的权威性和亲和力。

AI 分析虚拟人的构成要素

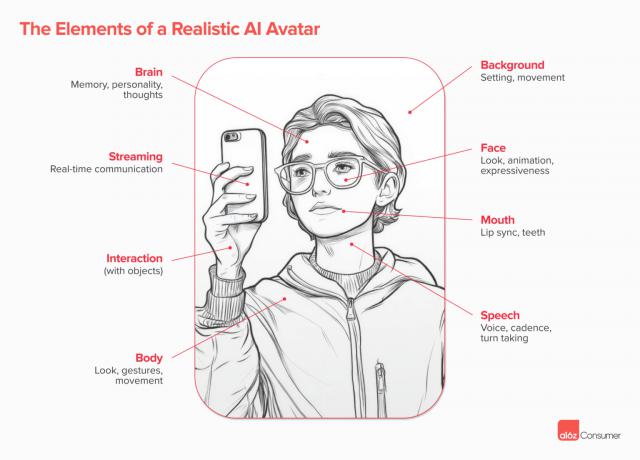

创造一个令人信服的 AI 虚拟人,这是一项非常具有挑战性的任务。每一个与真实感相关的元素都隐藏着一个棘手的技术问题。这不仅仅是避免“恐怖谷效应”那么简单,其实这是一个关键问题,包括攻破动画制作、语音合成和实时渲染。以下,我们深入分析构建虚拟人所需要的核心要素,探讨为什么要达到完美的效果,以及当前的进展情况:

•脸部:无论是复制现实人物还是塑造新人物,都要求虚拟人物的面部在不同的画面框架之间保持连贯和一致,说话时面部动作可以生动。然而,让虚拟人物根据自己的情况自然表现出相应的面部情绪仍然是一个巨大的挑战。比如虚拟人说“我累了”的时候,同时打哈欠也不容易。

•声音:声音不仅要真实自然,还要与虚拟人物高度契合。想象一下,一个看起来像年轻女孩的虚拟人,如果配上中年女人的声音,违和感就会迎面而来。目前,我们接触过的大多数人 AI 虚拟公司,都喜欢使用虚拟公司 ElevenLabs。该平台拥有丰富的语音资源,还支持用户复制自己独特的声音。

•嘴型同步:实现精确、优质的口型同步,技术难度极高。Sync 等待公司就致力于解决这个难题。和 Meta 推出的 MoCha,以及 OmniHuman 这种模式依靠海量数据集进行训练,运用多种技术,使面部生成过程与配套音频紧密绑定,使每一帧面部画面都能准确匹配音频,实现口型同步。

•身体:虚拟人不能只是一个“光杆指挥官”,只露出一个头漂浮在空中。新一代模型可以创建全身虚拟人,支持动作呈现。然而,无论是进一步拓展其功能丰富性,还是提升用户体验,目前还处于起步探索阶段,还有很长的路要走。

•背景:虚拟人在真空环境中独立存在。它所处环境的光线效果、空间景深、与周围物体的互动状态都必须与整体情况相协调。在理想状态下,虚拟人应该具备与环境物体互动的能力,比如轻松拿起一个产品,真正融入情境。

如果你期望虚拟人员实时参与对话,比如加入。 Zoom 视频会议,还需要增加以下核心要素:

•“智能大脑”:虚拟人必须有“思考”的能力。目前,大多数用户可以上传知识库或访问目前的知识库,以支持对话功能。展望未来,更先进的产品版本有望赋予虚拟人更强的记忆力,塑造鲜明的个性。这样,虚拟人就能清晰地记住过去与用户的沟通内容,在互动中展现出独特的风格。

•实时流传送:技术难度极大,在保证低延迟的前提下,顺利实现上述所有功能的实时传输。LiveKit、Agora 等待商品在这一领域取得了一定的突破,但是要使各种模型协同运行,同时将延迟保持在最低限度,仍然面临许多挑战。虽然像 Tolan 这一集语音与面部形象于一体。 AI 外星合作伙伴,在实时传输方面表现不错,但从整体行业来看,后续仍有大量优化工作亟待推进。

如何才能取得突破?

AI 虚拟人类领域仍然蕴含着巨大的发展潜力,迫切需要我们去发展和完善。下列几个方面是当前关注的重中之重:

•人物的连接和可塑性:过去,AI 虚拟人的形象千篇一律,一般只有单一、成型的外观设定。不管是着装风格,身体姿势,还是环境背景,都处于静态状态,缺乏改变。现在,情况开始转变,一些产品已经尝试为用户提供多样化的选择。以 HeyGen 推出劳尔这个角色(Raul)举例来说,他拥有高达 20 各种各样的形象,让人眼前一亮。但是,我们希望未来能有更快更强的功能,让用户可以随意塑造和转换角色,真正实现创意自由。

•面部动作和表情的进步:长期以来,面部表现一直是 AI 虚拟人类难以克服的弱点。过去虚拟人的脸部呈现出生硬、呆板的效果,就像机械娃娃一样,缺乏活力和灵动。然而,随着技术的迭代更新,这种情况正在逐步扭转。比如,Captions 新公司发布的公司 Mirage 模型,便成功地实现了质的飞跃,能展现出更自然逼真的面部外观,以及更丰富多样的表情。我们渴望未来 AI 虚拟化的人能深刻理解剧本中的情感内涵和情境信息,并给予准确、适当的反应。想象一下,当一个角色在逃离怪物紧张的场景中,能够瞬间表现出惊恐的表情,无疑会大大增强虚拟人的沉浸感和感染力。

•自然地呈现身体动作:目前,绝大多数 AI 虚拟人在面部以下的身体部位缺乏动作,即使是最基本的手势动作,也是极其罕见的。现有的手势控制方法多依赖于预先设定的程序逻辑,缺乏灵活性和真实性。以 Argil 例如,客户只能在有限的列表中为视频的不同片段选择特定类型的肢体语言,不能满足自然交互的需要。展望未来,我们热切期待能见证更多自然流畅、贴合情境的身体动作,让虚拟人在举手投足之间展现真实与生动。

•与“现实世界”的互动扩展:现阶段,AI 虚拟人与周围环境的互动能力几乎为零,这是限制其应用领域扩张的关键瓶颈。短期来看,一个切实可行、有价值的目的是赋予虚拟人在广告场景中与产品互动的能力,比如自然地拿起和展示产品。值得高兴的是,Topview 在这方面,公司已经迈出了坚实的步伐。伴随着模型特性的不断优化,我们对未来在这一领域的更多突破充满期待。

•全面扩展即时应用场景:在未来,AI 在人们的日常生活中,虚拟人有望深度融入,催生许多具有创新性和实用性的实时应用。想象一下,和 AI 医师进行视频咨询,专业的 AI 在销售助理的陪同下浏览自己喜欢的商品,或通过 FaceTime 和喜欢的电视剧角色聊天...虽然距离人类自然交互的理想状态在延迟控制和稳定性方面还有一定差距,但技术的快速发展让我们越来越接近这个目标。

这个行业将走向何方?

回顾过去几年的基础模型企业和 AI 在应用领域的投资过程中,我们深刻理解了一个道理:准确预测某个领域的未来趋势几乎是一项不可能完成的任务。但是,有一点是可以肯定的:随着底层模型质量的显著提高,人们已经可以产生良好的印象,不再“不忍直视” AI 会说话的头像,这无疑为网络层的爆发式增长奠定了坚实的基础。

我们大胆预测,这一领域将孕育许多市值数十亿美元的行业巨头。届时,市场将根据不同的使用场景和目标客户群体对产品进行细分。例如,与粉丝为朋友制作简单的动画角色短视频相比,企业高管希望借助 AI 为客户拍摄专业视频的克隆体,对产品质量和真实感的要求会更加严格,而且还愿意为此付出更高的代价。

另外,高效率的工作流程也是不可或缺的。如果你打算借助的话 AI 虚拟在线名人广告,一个综合平台,可以自动提取产品详细信息,准确编写剧本,智能添加协助镜头和产品图片,一键将视频推送到各大社交平台,实时评价广告效果,将成为你的得力助手。相反,如果你致力于使用它, AI 人物创作故事,那么一个支持人物与场景储存复用,方便快捷地拼接各种视频短片的工具,无疑会更适合你的创作需要。

原文:AI Avatars Escape the Uncanny Valley

https://a16z.com/ai-avatars/

本文仅代表作者观点,版权归原创者所有,如需转载请在文中注明来源及作者名字。

免责声明:本文系转载编辑文章,仅作分享之用。如分享内容、图片侵犯到您的版权或非授权发布,请及时与我们联系进行审核处理或删除,您可以发送材料至邮箱:service@tojoy.com