奥特曼百万年薪挖角谷歌TPU人才,想砸7万亿实现。「芯片自由」?

【新智元导读】OpenAI 自主研发芯片的计划最终看到了实质性的进展。依据 SemiAnalysis 最近的一篇文章,他们正在从谷歌开始。 TPU 团队招聘人才,扩大自己的芯片研发团队。

OpenAI 关于芯片的欲望传闻已经很久了。

近几年见证了 PC 和 AI 经过两次重大的半导体供应危机,Sam Altman 传统芯片制造商如台积电、三星代工和英特尔代工似乎没有足够的生产能力,无法满足全球的需求。 AI 需要快速增长的芯片。

不单单是 OpenAI 为了减少对英伟达芯片的依赖,奥特曼甚至希望建造更多的晶圆厂,能够稳定地供应给其他公司。

据华尔街日报报道,今年 2 月亮,奥特曼会见软银 CEO 与台积电的谈判代表,探讨合资事宜,计划在未来几年内共同建设和运营数十家芯片制造厂。

TSMC 新建工厂位于亚利桑那州

不过,造芯片要烧的钱比训练大模型要少,不会多。

据奥特曼个人估计,建造新型半导体制造设备及相关基础设施的成本可能高达 5-7 亿美元。

因为传统的私人风险投资很难一下子花这么多钱,奥特曼曾经去美国商务部长那里讨论,甚至去新加坡和阿联酋见当地官员,寻求国有资产的支持。

经过半年多的规划和发醇,OpenAI 芯片工作似乎真的要开始了!

谷歌,芯片人才大战 vs. OpenAI

据 SemiAnalysis 最新报道,OpenAI 近期开始大规模招募,计划将只有少数人的芯片团队扩展到数十人。

而且,他们延续了一贯的招聘策略——挖角谷歌。

最近招聘的绝大多数研究人员,都是谷歌现任或前任。 TPU 团队人员。

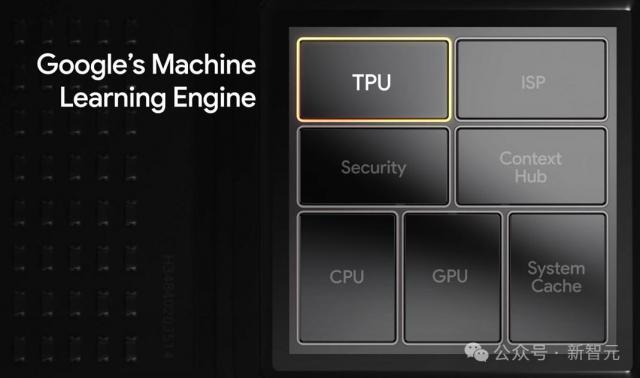

与最初设计的图像处理和实时渲染不同 GPU,TPU 这是谷歌从零开始设计的,专门用来加快机器学习和神经网络的计算,能更好地解决张量计算问题。

GPU 以 ALU(高级算术逻辑单元)是核心部件, TPU 矩阵乘法器模块的核心是(MXU),矩阵乘法和积累可以以高吞吐量进行。

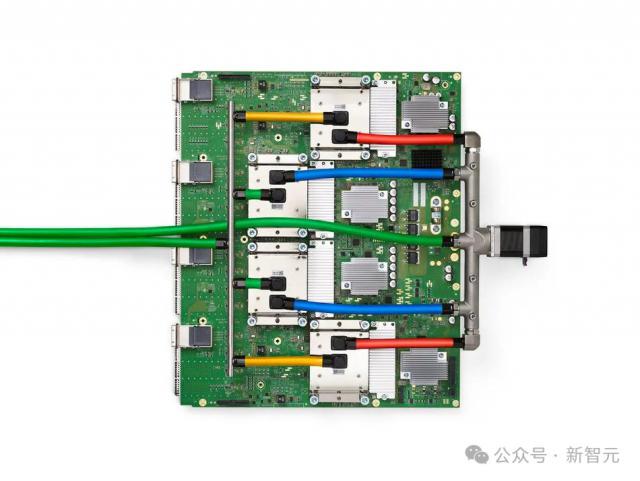

谷歌 TPUv4

尽管 TPU 任务的实用性不如 GPU,特别是没有 CUDA 这类编程界面,但在计算性能和能源效率方面表现良好,尤其是那些经过谷歌团队特别优化的任务。

所以可以说,TPU 这是世界性能 /TCO最好的机器学习基础设施(总体成本)。

尽管谷歌的 TPU 虽然取得了如此高的成就, OpenAI 在许多方面,芯片团队的工作机会仍然具有吸引力。

第一,大公司和创业公司在发展速度世界上的本质差异。

TPU 第一次发布是在那里 2013 年,到今年 5 月亮最新推出 TPUv6,团队有十多年的发展经验。珠玉在前面,系统设计和微结构很难有很大的变化,更多的是迭代和渐进的改进。

加入 OpenAI 然而,在重新设计、重新开发的过程中,成员们有机会尝试更加创新和激进的方法。

并且 OpenAI 一向雄心勃勃,他们的目标是建立一个由数百万个加速器组成的系统,这比较 GPT-4 还有几个量级的练习。

此外,团队合作模式还有很大的不同。

虽然谷歌在尾大不了, TPU 团队也会和 DeepMind 合作,但是仍然会遇到很多非技术障碍。

相比之下,OpenAI 内部芯片与模型团队之间,沟通与合作将更加紧密顺畅。

除此之外,还有薪资的差别。

事实上,Google TPU 在半导体设计领域,团队已成为工资最高的团队之一,工程师的平均收入远远高于 AMD、大多数半导体公司,如英特尔、高通等,都可以与领先的企业英伟达相媲美。

OpenAI 虽然基本工资并不丰厚,但作为一个未上市的创业团队,每年向高级工程师提供的价值数百万美元的股权更具吸引力。

加上这些因素的叠加, CEO 奥特曼本人亲自参加了大部分的招聘工作,OpenAI 招募的人才质量令人惊叹。

GPT-4o 和 Sora 在模型发布的时候,团队成员的背景,能力的强大总是让网友大吃一惊。

GPT-4o 17 人 Omni 金牌队首揭秘!清北上交中科大 6 位华人领衔

SemiAnalysis 记者向同行询问了这些挖角的人。 TPU 有才华的时候,总能得到这样的答案,「她们是我合作过的最好的工程师之一」。

OpenAI 为什么要看谷歌? TPU 团队不仅希望获得最先进的技术和人才,而且在商业竞争中也有考虑。

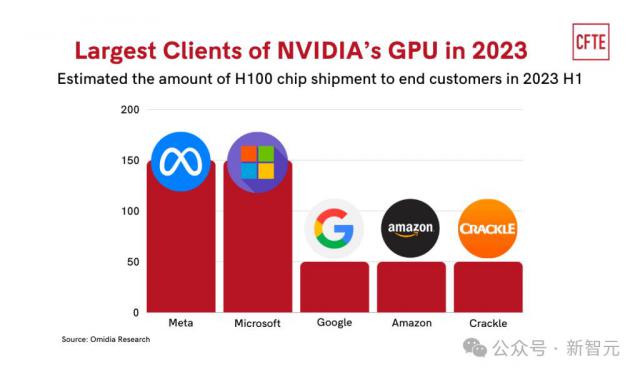

只有谷歌开发的在硅谷的众多科技巨头中 TPU 可以成功地替代英伟达的芯片,并在公司内部部署云服务。

Meta、虽然亚马逊和微软等公司也在自主研发芯片方面做了很多努力,但仍然严重依赖英伟达。

将来很长一段时间,AMD 像英伟达这样的半导体公司仍将是 OpenAI 合作伙伴,所以很容易得罪。

只有面对与生俱来的死敌谷歌,OpenAI 敢于如此肆无忌惮地挖角。(甚至连发布会都要抢谷歌。 I/O 会议前一天召开)

虽然获得了如此强大的人才队伍,但芯片研发仍然需要付出巨大的努力。

预估需到 2027 年末,OpenAI 可以推出第一代自研芯片。在此之前,他们仍然完全依赖商业芯片。

渐渐地,与微软的关系变得微妙

OpenAI 自研芯片的决定有些令人摸不着头脑。背靠微软的资金和 Azure 云服务的强大算率,为什么要烧钱自研芯片?

事实上,OpenAI 和微软的关系已经越来越紧张了,毕竟对微软来说,OpenAI 这是一家结构很奇怪的公司。

现在,它本质上仍然是一个完全独立的非营利组织, OpenAI Nonprofit 管理。作为一个没有投票权的股东大会观察员,微软几乎无法控制。 OpenAI 发展方向。

如果因为 AGI 安全问题,OpenAI 股东大会要求中止协议,收回模型使用权,微软只能乖乖听命,没有还手之力。

AGI 从商业和知识产权许可协议中分离出来。

董事会决定什么时候实现? AGI。 再次强调,AGI 它指的是一个高度自治的系统,在有经济效益的工作中优于人类的表现。这种系统不包括在与微软签署的系统中。 IP 这些条款只适用于许可和其他商业条款。 AGI 以前的技术。

所以,双方都在实施自己的目标。「脱钩」计划。

OpenAI 在芯片和计算率方面需要逐步分开,微软正在努力减少。 OpenAI 依赖模型。

比如最近微软的投资 Inflection AI,并组建自己的团队开发团队 Phi-3、MAI-1 等待模型,都是出于这方面的考虑。

当前,许多企业客户通过 Azure 使用 OpenAI 技术,包括超越 65% 的《财富》500 强公司。

希望微软能拥有自研 GPT-4 等级 LLM,以及一系列满足不同用户需求的模型,保证在 Azure 更换推理服务 OpenAI。

对于 OpenAI 因此,要想在计算率上自给自足,购买英伟达芯片的成本太高,并非最佳选择。所以,自研芯片似乎是唯一的出路。

实际上,不只是 OpenAI,Meta、同时,微软、谷歌、亚马逊等公司也在大力投资,开发自己的 AI 加速器。

这些 AI 在成为英伟达最大用户的同时,巨头也成为了最强大的竞争对手。

毕竟,在模型训练的过程中,计算率已经成为最大的支出。如果购买芯片的资金可以转化为内部投资,就可以制造成本部署 GPU 或 TPU,模型的成本也会大大降低。

本文仅代表作者观点,版权归原创者所有,如需转载请在文中注明来源及作者名字。

免责声明:本文系转载编辑文章,仅作分享之用。如分享内容、图片侵犯到您的版权或非授权发布,请及时与我们联系进行审核处理或删除,您可以发送材料至邮箱:service@tojoy.com