AGI渐行渐近,该加速还是要踩刹车?

人们离第一个AGI的出现越来越近了!

今年早些时候,马斯克预测AGI可能会在2026年投入使用。首席AGI科学家ShaneepMind创始人 在一次采访中,Legg认为,在2028年,人类开发第一个AGI的概率为50%。不过,百度CEO李彦宏的观点更加谨慎,他认为AGI还需要10多年才能出现。

自1956年达特茅斯会议提出“人工智能”的概念以来,实现人类水平的智能一直是AI领域的圣杯。去年上半年,一些主流研究人员提出,大语言模型已经表现出“通用人工智能的火花”(sparks of AGI)。

这似乎表明AGI已经从哲学猜测变成了未来。然而,关于AGI的观点有不同的看法,大语言模型中经常出现愚蠢的行为,这些都引起了对AGI的质疑。

我们离实现真正的AGI还有多远?如何预防AGI带来的潜在风险?

AGI,未到的黎明

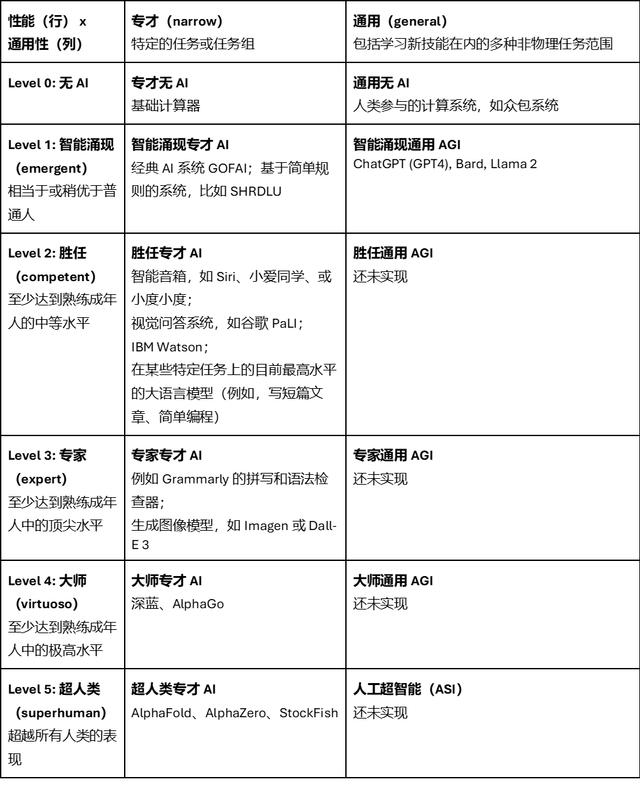

人与AI的关系可以从性能强度和实用性两个方面分为六个阶段:没有AI。、智能化涌现,担任,专家,大师,超人。而且现在大语言模型的出现,正处于AGI的第一个时期:AGI原型。

AGI(Artificial General Intelligence),也就是说,通用人工智能的目标是实现人类通用智能,这意味着AI可以像人类一样理解随机通用任务,并以人类的智商水平完成。基本上,AGI是人类对人工智能的终极梦想,除了“自我意识”的形成。

AGI是让智能身体像人一样,不仅能独立感知环境,思考,做出决定,学习新技能,做出任务,还能与人类或其他智能身体有效合作。同时,智能身体可以理解人类的情绪,遵循社会伦理和道德规范。

一个完整的AGI需要三个基本特征:第一,它必须能够完成无限的任务,而不是只能完成人们定义的有限的任务。第二,我们应该在场景中独立发现任务,这通常意味着“眼睛里有工作”。第三,它需要独立的价值来驱动,而不是被动的数据驱动。

同时,AGI还应该处理一些关键的技术问题,比如构建智能身体的认知结构,让智能身体在现实世界中有效行动,由价值驱动,与社会现状互动,使智能身体的决策过程透明可解释,与人类建立信任关系。

ChatGPTOpenAI、谷歌Bard、以MetaLlama为代表的大模型在实用性上显示了AGI的潜力。因为大语言模型可以完成广泛的各种任务,展示“元认知”能力,比如学习新技能。

与大模型的“鹦鹉模式”相比,AGI是一种以“小数据、大任务”为结构的“秃鹰模式”。智能体现为独立的智能,能够独立感知、认知、推理、学习和实施,不依赖大数据,基于无标记数据进行无监督学习,智能系统功耗低。就像乌鸦喝水一样,看似简单,却属于自我推理行为。它是一种由价值和因果驱动的高级智能,也是AI未来的发展趋势。

假如仅从AI的性能维度来看,“窄AI”(Narrow AI)“AI类型已达到完全超越人类理解的水平。使用AlphaFold、以AlphaZero为代表的专业领域AI,已经可以在特定领域找到人类智商无法发现的新事物,这种新事物被称为“超人类窄AI”。而且在某些领域,AI可以达到90%的人类水平,比如文件纠正AI。 Grammarly,DALL·E Imagen等生图AI被称为“专家级窄AI”。一般智能助理,如Siri、谷助手等,在特定领域可以达到普通人的平均水平,被称为“一般窄AI”。

所谓“窄AI”,是指那些特别擅长处理单一任务或在特定范围内工作的系统。在许多情况下,他们在特定领域的表现远远优于人类。然而,一旦他们遇到的问题超过了适用空间,效果就会急剧下降。换句话说,他们不能把学到的知识从一个领域转移到另一个领域。

虽然窄AI不能完全执行需要人类智能的任务,但在特定的场景中仍然非常实用,并且已经在许多应用中发挥了自己的作用。谷歌搜索查询现在可以用窄AI算法回答问题。窄AI系统将推荐用户可能感兴趣的视频在YouTube和Netflix,并根据自己的喜好在Spotify中整理出周推音乐列表。

然而,在窄AI已经覆盖的能力维度上,AGI还没有相应的案例。人类还没有达到对AGI概念的统一认知,因为真正意义上的AGI还没有出现。

AGI的开始是谁?

从信息时代到智能时代,“语言”已经成为开启新时代的关键。著名作家、思想家路德维希·维特根斯坦在他的《逻辑哲学论》一书中提到:“我的语言边界代表着我的世界边界。”

对于人们来说,语言是承载世界知识、思考、交流和文化的关键。语言本身的发明意味着每一个单词都增加了世界的认知维度,单词之间的逻辑关系和表达意味着人类对世界的完整建模。这一模型并非在图像中,而是通过语言来承载,所以语言边界就是世界边界。AI的核心是将现实世界中的现象翻译成数学模型,通过语言使机器充分理解现实世界与数据的关系。

如今,人们已经走出了用一个公式解释世界的原始物理方法,更多的是依靠海量数据在各个层面进行独立建模。上层建模是由大量数据驱动的。语言模型也是如此,生命建模也是如此,2021年最大的成就就是DeepMind的AlphaFord系统,针对基因到蛋白质的三维结构建模,通过这种模型预测基因被转录或表达为蛋白质后所拥有的形态,也是世界生命领域轰动一时的突破,也是由数据和AI驱动的。

虽然大型模型已经取得了一些惊人的进展,但是如果对比AGI的三个特征,就会发现大型模型还没有达到AGI的要求。

首先,大模型处理任务的能力有限,只能处理文本领域的任务,不能与物理和社会环境互动。这意味着像ChatGPT这样的模型并不能真正“理解”语言的含义,因为它没有身体去体验物理空间。

其次,大模型不是独立的。它们需要人类具体定义每一项任务,就像一只“鹦鹉”,只能模仿受过训练的文字。真正的自主智能应该类似于“秃鹰智能”,可以独立完成比现在的AI更智能的任务。目前的AI系统没有这个潜力。

第三,虽然ChatGPT在不同的文本数据词库中进行了大规模的训练,包括隐含人类价值观的文本,但它没有能力理解人类价值或与人类价值保持一致,即缺乏所谓的道德指南针。

但是,这并不妨碍科技巨头对大型模型的推崇。OpenAI、包括谷歌在内的科技巨头,都把大模型视为走向AGI的关键一步。OpenAI CEO Sam Altman多次表示,GPT模型是AGI发展的重要突破。

然而,Meta人工智能首席科学家杨立昆(Yann LeCun)感觉现在的大模型路线不能通向AGI,而且极其危险。

他指出,虽然目前的大模型在自然语言理解、对话交互、文本创作等领域表现良好,但它仍然只是一种“统计建模”技术,实际上并不具备真正的“理解”和“推理”能力,而是在学习数据中的统计规则中完成相关任务。

他认为,“世界模型”更接近真正的智能,而不仅仅是学习数据的统计特征。以人类的学习过程为例,孩子在成长过程中,更多的是通过观察、互动和实践来认识世界,而不是简单地“注入”知识。LeCun的“世界模型”路线是通过模拟和补充视频、音频等媒体,让AI也能经历这样一个独立学习的过程。

同时,他也承认,实现“世界模式”并不容易,这个雄心勃勃的目标可能需要10年的时间才能实现。

在可控范围内控制风险

图灵是最早警告AGI带来的风险的人之一。1951年,他说:“一旦机器开始考虑,它很快就会超过我们。因此,在某个时候,我们应该期望机器能够被控制。”因为当一个比人类更强大的智能体出现时,人类很难维持自己的权力,尤其是当这些智能体目标不正确或不完整时。

如果有人认为现在考虑到这些危险的言论,如何回答这样一个问题:如何在比人类更强大的智能体面前永远保持权力?此外,在AI领域,一些人试图避免这个问题,否认AGI的可实现性,但没有提供任何证据。

OpenAI CEO Sam 在他的文章中,Altman《Planning for AGI and Beyond》在此基础上,探讨了AGI对社会、技术和伦理的潜在影响,并强调了谨慎规划和责任发展的重要性。

文章指出,AGI有很大的潜力通过增加资源丰富度、促进全球经济增长和帮助新技术知识的发现来提高人类的生活质量。这不仅是智商的巨大增长,也是人们创造力和想象力的巨大拓展。

然而,AGI的出现也可能带来严重的滥用风险、事故和极端事件的可能性以及对社会结构的剧烈动荡。因此,OpenAI倡导AGI开发者和全社会在探索AGI时,必须找到正确的实现和利用这项技术的方法,以确保其与人类核心价值观一致,并公平分享其利益。

另外,OpenAI认为,从长远来看,AGI的出现只是智商发展的一个节点,未来AI的进步可能会持续很长时间。OpenAI提出了一个安全的AGI发展愿景,即在短时间内以较慢的速度转换为AGI,让社会有时间去适应和优化。

虽然未来不可预测,但OpenAI表达了一些他们最关心的原则:希望AGI能最大限度地促进人类在宇宙中的繁荣;希望AGI带来的好处、浏览权和治理能够得到广泛公平的分享,成功应对巨大的风险。

因此,OpenAI提倡在短时间内进行渐进过渡,继续创建越来越符合目标的模型,并在全球范围内进行长期对话,讨论如何控制这些系统,如何公平分配它们的好处,如何公平分享浏览权。在极高的风险和收益下,人类需要团结一致,让AGI以最有利的方式在未来世界绽放。

至于如何防止AGI对人类的威胁,AGI的能力空间和价值空间可以逐渐放开,一开始就关在“铁笼”里,慢慢打开权限。

对于AGI来说,它的适用场所和运动空间可以先限制在特定的区域。随着人们对机器的信任度的增加,在确定AGI的安全性和可控性后,可以逐渐给予更多的空间。此外,算法决策过程的透明度应该进一步推动。如果你能清楚地了解AGI的认知结构,然后知道它是如何工作的,你就能更好地控制它。

人类对AGI的探索和思考才刚刚开始,我们还有很长的路要走。AGI的进步不仅代表了技术创新,也是对未来人机交互方式的重新想象。随著AGI未知领域的逐步发展,稳健有序的发展变得更加重要,我们应高度警惕AGI带来的问题,并充分重视AGI创造的机遇。两千多年前,苏格拉底说:“认识自己”,今天,随着AGI技术的发展,人类需要“重新认识自己”。

本文来自微信微信官方账号“科技云报道”(ID:ITCloud-BD),作者:科技云报道,36氪经授权发布。

本文仅代表作者观点,版权归原创者所有,如需转载请在文中注明来源及作者名字。

免责声明:本文系转载编辑文章,仅作分享之用。如分享内容、图片侵犯到您的版权或非授权发布,请及时与我们联系进行审核处理或删除,您可以发送材料至邮箱:service@tojoy.com