4.5亿美元融资背后:Rhoda AI以DVA技术挑战机器人主流架构

本文来源:微信公众号“42号电波”,作者兰博,编辑James,原标题《4.5亿美元融资背后:Rhoda AI用DVA挑战机器人主流架构》

沉寂18个月后,美国机器人企业Rhoda AI近期结束隐身状态,推出核心技术DVA(直接视频动作)模型,试图打破VLA(视觉-语言-动作)模型在行业内的主流地位。

与VLA模型相比,Rhoda AI的技术路径差异显著。DVA模型旨在让机器人直接从视频中学习世界的变化规律,再将这种预测能力转化为动作控制指令。

在VLA模型占据具身智能领域半壁江山的背景下,DVA堪称“反主流”路线,但资本的态度已给出明确信号。

伴随DVA模型发布,Rhoda AI宣布完成4.5亿美元(约合人民币32亿元)A轮融资,公司估值达17亿美元(约合人民币123亿元)。

单轮融资超30亿元的规模,即便在国内也仅有少数明星机器人企业能企及,这背后是资本对DVA技术路线的坚定押注。

这场技术路线之争的核心问题只有一个:何种方式才能让机器人真正走进现实生活?

数据:路线之争的导火索

要理解机器人行业为何有如此多复杂的技术路线,需先明确数据在其中的关键作用。

当前主流的VLA模型训练高度依赖机器人遥操作数据,这类数据包含视觉观察、机器人状态及人类操作动作。每条数据都需真实机器人、专业操作员和专用设备支持,数据成本极高。

更关键的是,VLA模型难以覆盖现实世界中的长尾场景。实验室环境下机器人任务成功率看似可观,但在真实应用场景中成功率会大幅波动。

出现这种差异的原因很简单:真实世界的变化远多于训练数据。在此背景下,行业开始探索机器人脱离大量人类标注数据完成任务的可能性。

Rhoda AI的DVA模型在数据处理上采取了截然不同的策略。

Rhoda AI先利用大规模互联网视频对模型进行预训练,让系统从海量视频中学习物体运动、接触关系及人类操作模式等基本物理规律。完成视频预训练后,再通过少量真实机器人数据微调,将对“世界如何变化”的理解映射到具体机器人动作控制中。

按照这一技术逻辑,DVA试图将机器人学习的大部分过程,从昂贵的机器人数据转移到规模更大的视频数据上。

毕竟,即便遥操作数据再丰富,在数十亿小时的网络视频数据面前也只是冰山一角,且网络视频数据成本更低。

DVA:将机器人控制转化为视频生成

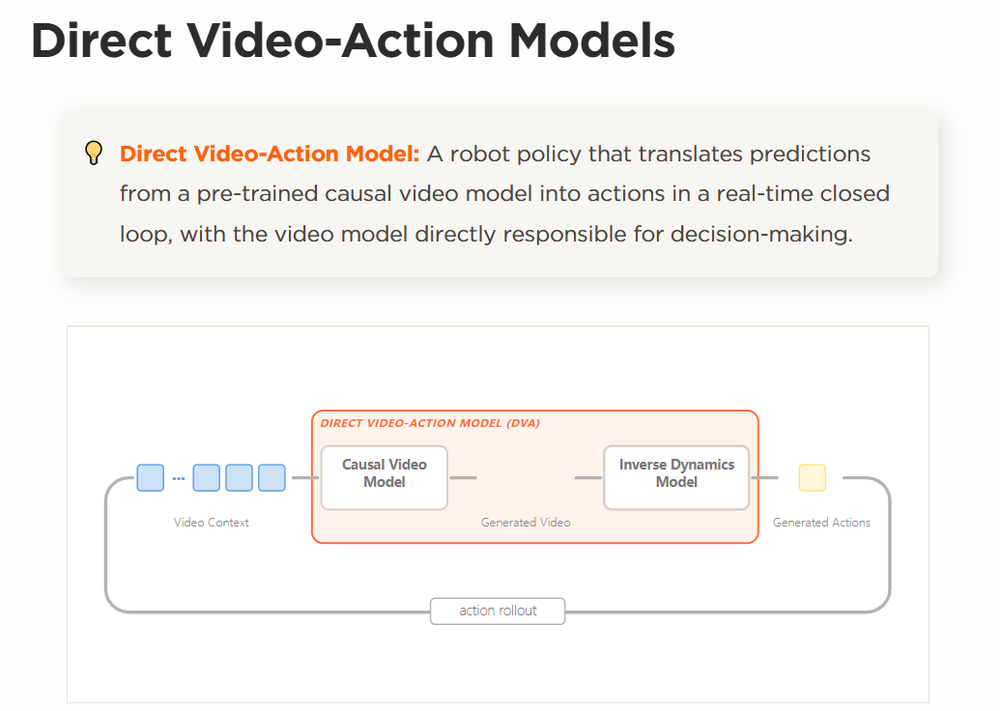

Rhoda AI提出的DVA架构,核心思路是让机器人先“想象”未来,再决定动作。

初看之下,这与此前热议的“世界模型”似乎并无二致。但DVA的最大创新在于将“预测未来视频”直接转化为动作控制,整个系统分为两步:

预测未来视频:首先运用因果视频模型,根据当前视觉观察预测未来几帧画面。机器人会先设想“若采取此动作,世界会发生何种变化”。

视频转动作:预测完成后,通过逆动力学模型,根据预测的视频变化反推机器人应执行的动作。形成“观察-想象-行动-再观察”的闭环,每秒重复多次。关键在于,该模型仅需约10小时数据即可完成训练,且能跨任务复用。

为使视频预测真正实现机器人控制,Rhoda AI还提出两项关键支撑技术:

上下文摊销:传统视频模型通常逐帧预测未来,而Rhoda AI的方法是在多个时间点同时预测未来帧。这让模型能处理数百帧的长上下文视频,拥有更长视觉记忆,使机器人具备处理长程任务的能力。

蛙跳推理:由于视频生成需大量算力,Rhoda AI采用类似流水线的策略——机器人执行当前动作时,模型已在预测下一步视频。这种推理与执行并行的方式,可大幅降低延迟。

不依赖遥操数据规模

Rhoda AI在技术博客中展示了完整实验,以证明DVA在真实任务中的数据效率和任务控制能力。

其中颇具代表性的是拆箱任务:机器人需从箱子中取出物品并倒入另一容器,过程包含抓取、移动、倾倒等连续动作,对视觉理解和动作协调要求较高。

根据Rhoda AI披露的数据,该任务仅用约11小时机器人真机操作数据,模型即可稳定完成操作。

相比之下,传统依赖遥操作数据训练的机器人模型,往往需要数百小时甚至更长时间的数据才能达到类似水平。

这正是DVA路线反复强调的优势:通过互联网规模视频预训练,模型已提前掌握大量物体运动和物理变化的“运动先验”,因此在机器人场景中只需少量数据即可完成适配。

另一项接近工业环境的任务是容器拆解:机器人需识别容器结构,完成拆解和分类处理等步骤,属于典型的多阶段流程操作。

该任务使用的机器人真机数据约17小时,同样远低于传统机器人训练规模。更重要的是,这类任务存在明显时间依赖关系,步骤必须按正确顺序执行,否则流程会失败。

实验结果显示,DVA在这类任务中表现稳定,团队将其视为视频预测路线在长流程操作中的重要优势。

总体而言,Rhoda AI的核心观点清晰:将机器人控制转化为视频预测问题后,系统可借助互联网规模视频数据学习物理世界基本规律,从而大幅降低对昂贵机器人数据的依赖。

在此框架下,机器人并非直接学习“应执行何种动作”,而是先学习“世界接下来会发生什么变化”,再根据预测结果推导动作策略——这正是DVA架构与主流VLA路线的最大差异。

机器人的Transformer时刻是否到来?

整体来看,DVA架构确实新颖:通过将控制问题转化为视频生成,降低了对遥操数据的依赖,同时具备长上下文记忆和可解释性。

因此,DVA在数据效率和泛化能力上,让人联想到Transformer在自然语言处理领域引发的范式转移,它或许能为具身智能领域带来类似突破。

但问题并非如此简单,实时推理延迟是DVA模型目前面临的最大挑战。

尽管Rhoda AI提到用蛙跳推理降低延迟,但现实生活的复杂性决定了机器人所处环境多变,部分实时操作问题需要机器人瞬间反应。

若一个简单的“拿起杯子”动作都需机器人反应五六秒,其生活使用体验将大打折扣;更不用说做饭这类长程任务,若延迟过高,菜可能会糊掉。

另一个问题是算力。虽然DVA在数据成本上有所节省,但需在算力上代偿——大量视频生成所需的计算开销巨大,且当前全球算力稀缺,短期内算力成本下降并不现实。

因此,Rhoda AI的DVA模型能否真正改变行业,关键在于算力成本、实时推理适配落地等问题能否解决。

若这些问题得到解决,未来机器人学习世界的方式或许真会从“预测动作”转向“预测未来”,这可能正是具身智能的下一次范式转移。

参考链接:

https://www.rhoda.ai/research/direct-video-action

本文仅代表作者观点,版权归原创者所有,如需转载请在文中注明来源及作者名字。

免责声明:本文系转载编辑文章,仅作分享之用。如分享内容、图片侵犯到您的版权或非授权发布,请及时与我们联系进行审核处理或删除,您可以发送材料至邮箱:service@tojoy.com