Nano Banana 2发布:图像生成下半场,“世界知识”成核心竞争力

2026年以来,图像生成模型逐渐淡出大众视野,行业焦点转向agent技术。多数从业者认为,图像生成的技术路线已基本定型,后续仅需工程优化与成本控制。

国际调研机构Fundamental Business Insights在《AI图像生成器市场规模和份额预测》中指出,2024年全球市场规模为4.1024亿美元,2025年达4.785亿美元,2026年预计为5.4136亿美元。可见,图像生成模型市场已趋于成熟稳定,增长空间有限。

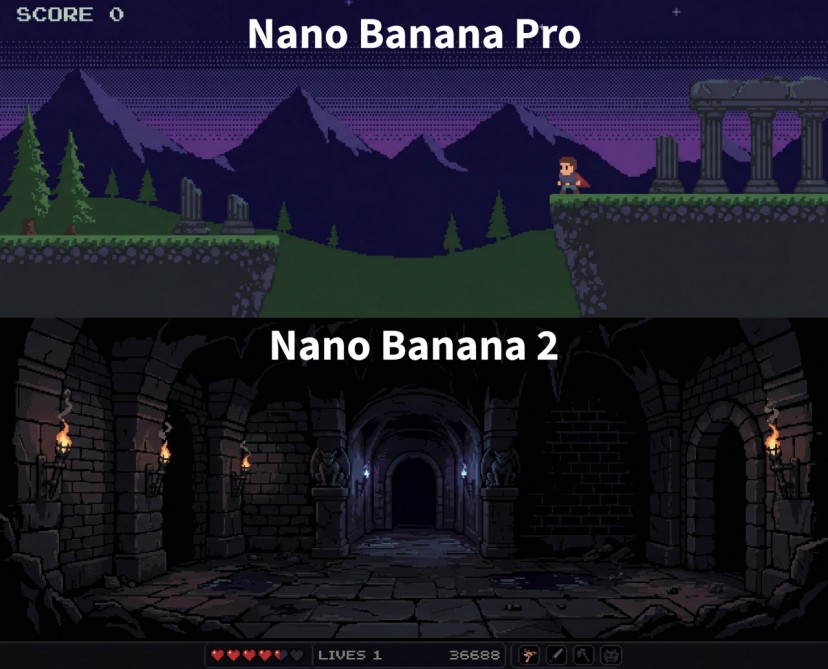

就在此时,谷歌推出了Nano Banana 2。通过相同提示词生成的图片对比显示,Nano Banana 2与Nano Banana Pro在呈现方式上存在显著差异。

这并非简单的版本迭代。谷歌发布当天便宣布,Nano Banana 2将立即取代所有旧版本,成为Gemini、谷歌搜索、AI Studio等产品的默认图像生成模型,甚至谷歌的AI编程工具Antigravity也完成了接入。

谷歌为何突然“全面押注”?过去,用户常面临两难:生成4K分辨率图片需等待较长时间,快速生成则只能选择低分辨率模型。而Nano Banana 2实现了“又快又好”。谷歌认为,在agent时代,图像生成仍是值得重点投入的领域。

01 Nano Banana 2的核心特点

Nano Banana 2最突出的特点是速度快,能在4-6秒内生成4K分辨率图像。谷歌Gemini系列一直保持两条产品线:Pro追求性能,Flash注重效率。但将该架构迁移到图像生成领域并非简单的模型压缩,图像生成的计算密集度远高于文本生成,一张2K分辨率图像的信息量相当于数千个文本token。如何在不牺牲视觉质量的前提下提升推理速度,是一大工程难题。

Nano Banana 2采用分层生成策略解决这一问题。

模型先在低分辨率下完成场景理解、构图规划和物理关系推理,再通过高效的上采样管道将图像提升至2K甚至4K分辨率。这种“先思考,后渲染”的流程,使模型在保持Pro级别一致性和细节质量的同时,降低了计算成本。

除速度外,Nano Banana 2还引入了“世界知识”概念。

传统图像生成模型本质是强大的视觉模式匹配器,通过海量图像数据训练学会“什么样的画面真实”,但并不真正理解画面中的物理规律、地理特征或文化背景。例如,生成“巴黎铁塔雨天景象”时,可能出现铁塔结构细节模糊、巴黎建筑风格不准确、雨天光线特征错误等问题。

Nano Banana 2的不同之处在于,它直接继承了Gemini大语言模型的世界知识库,并能实时调用谷歌图像搜索作为“视觉参考库”。当生成真实地点场景时,模型不仅知晓该地点的地理位置、气候特征、建筑风格,还能检索相关真实照片作为视觉基准,从而生成更准确的图像。

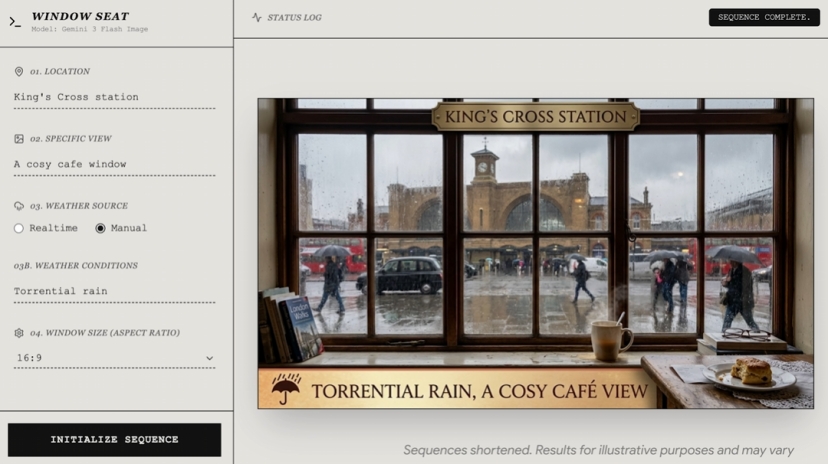

在谷歌的“Window Seat”演示中,模型可根据用户指定的地点和实时天气数据,生成该地点窗外的逼真景观。

例如,《哈利波特》中通往霍格沃茨的9¾站台位于英国国王十字车站(King's Cross station)。在Window Seat中输入该车站,窗户样式设为温馨咖啡馆,天气指定为瓢泼大雨,Nano Banana 2就能生成相应场景。

将“世界知识”注入Nano Banana 2,是大语言模型推理能力与图像生成渲染能力结合的产物。模型生成图像前会先进行“语义推理”,理解提示词中的真实世界概念,再转化为视觉元素。

文字渲染一直是图像生成领域的难题,Stable Diffusion、Midjourney、早期DALL-E生成的含文字图像常出现字母错位、拼写错误、字体混乱等问题,根源在于传统扩散模型将文字视为视觉纹理而非语义符号系统。

Nano Banana 2在文字渲染上进步显著,官方称其能“更可靠地渲染文字”,支持多语言文本,保持字体清晰度和风格一致性。这得益于模型对文字的“双重理解”:既通过Gemini语言模型理解文字语义,又通过图像生成渲染能力掌握文字视觉呈现规律。例如,让Nano Banana 2设计“字母AI”Logo,它能清晰展示每个字,并以电路板元素强化AI概念。

02 Nano Banana 2背后的技术支撑

Nano Banana 2的另一重要特性是“对话式编辑”能力。虽然这不是新概念,但实际效果远超以往。它能完全通过对话进行图片编辑,如“把背景换成日落”“把衣服改成蓝色”“去掉左边的树”等。

这种交互方式的关键在于模型能在多轮对话中保持对图像的“记忆”。当第三轮对话要求“把刚才的蓝色衣服改回红色”时,模型需知道“刚才的蓝色衣服”指第二轮编辑中修改的那件。

这种上下文追踪能力被称为“思维签名”(Thought Signatures)。

简单来说,模型生成图像时会进行一系列思考,思维签名是每一步思考的标签。多轮对话编辑图像时,将上一轮思维签名传回模型,它就能记住之前的构图逻辑、光影关系和设计意图,实现连贯的局部修改。对已有图片修改时,模型通过思维签名理解原始图像整体结构,做出合理调整而不破坏画面一致性。

一致性是当前图像生成模型的最大难题之一。Nano Banana 2支持最多14张参考图像混合使用,包括5张人物角色图像和6张物体图像。模型能从参考图像中提取视觉特征,并在新生成图像中保持这些特征的一致性。例如,官方示例中将香蕉和恐龙玩偶结合,生成了以香蕉为身体的恐龙玩偶。

对比Nano Banana 2和GPT生成的图片,相同提示词下GPT带有明显AI生成感,而Nano Banana 2生成的图片更真实。

GPT:

Nano Banana 2:

此外,Nano Banana官方还展示了由Nano Banana 2生成的超长图片。

03 Nano Banana 2的竞争优势

Nano Banana 2是一款均衡的图片生成模型,兼具速度、质量与性价比。

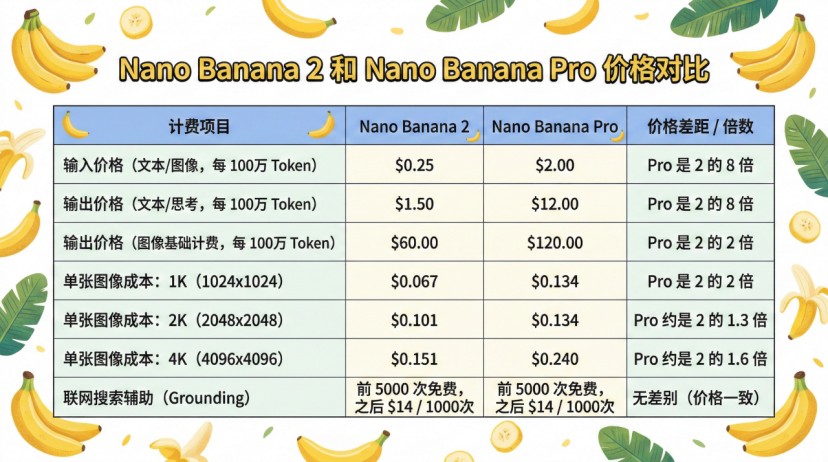

根据谷歌官方信息,Nano Banana 2生成1k图价格约0.067美元(不到5毛钱),2K图0.1美元(约7毛钱),4K图0.15美元(约1块钱),远低于Nano Banana Pro。

Pro版本的优势在于复杂场景把控、超写实光影渲染和小众艺术风格还原,适合专业视觉设计师、影视概念设计师等对画质有极致要求的用户。Nano Banana 2以画质上限的轻微让步,换取了效率的显著提升,定价更符合普通创作者及快速迭代、大批量生成的业务需求。

Midjourney仍是艺术创作的天花板,审美上限和风格化能力行业领先,尤其在生成电影质感、绘画笔触的艺术作品方面表现出色。但其V7版本生成速度约20秒/张,复杂场景下更长,且无对话式编辑功能,无法精准控制真实世界元素(如特定地点建筑风格、实时天气),API开放度低,主要通过Discord界面操作,不适合企业级集成。此前对比测试显示,Nano Banana Pro生成速度是Midjourney的10倍以上,Nano Banana 2更快。

Stable Diffusion 3的优势是开源、可本地部署、自定义程度高,适合有技术能力和数据隐私需求的开发者,支持LoRA微调、ControlNet等高级控制功能,可深度定制。但它需要配置本地环境、理解复杂参数、自行优化提示词,原生文字渲染准确度在学术评测中仅1.25-1.95分(满分5分),远低于Nano Banana 2,生成速度、事实准确性、对话式编辑能力也全面落后。

当然,Nano Banana 2并非完美。在极致艺术风格化创作、超复杂场景光影渲染上,与Nano Banana Pro和Midjourney仍有差距;多轮对话编辑中,虽支持最多5个角色的一致性维护,但特定场景仍可能出现细微变化,多轮后变化会累积;对小众冷门地点、物体,“世界知识”效果也会折扣。

但不可否认,Nano Banana 2为文生图行业带来新启示:未来AI图像生成不再是单纯“纹理匹配”,而是“大语言模型推理能力+视觉渲染能力+检索增强事实准确性”的深度融合。文生图工具终将从“画画的机器”,变成真正懂需求、懂世界的视觉创作助手。

本文来自微信公众号“字母AI”,作者:苗正,36氪经授权发布。

本文仅代表作者观点,版权归原创者所有,如需转载请在文中注明来源及作者名字。

免责声明:本文系转载编辑文章,仅作分享之用。如分享内容、图片侵犯到您的版权或非授权发布,请及时与我们联系进行审核处理或删除,您可以发送材料至邮箱:service@tojoy.com