谁能为马斯克建立世界上最强大的10万卡非常集群?

那些由埃隆·马斯克控制的公司-包括 SpaceX、特斯拉、xAI 甚至 X(原 Twitter)——全部需要大量的 GPU,而且都是为了自己的特定性。 AI 或者高性能计算(HPC)项目服务。但是问题是,市场根本不够充足。 GPU 能满足他们各自宏伟蓝图所承载的雄心壮志。所以,马斯克必须给自己能得到的限制。 GPU 规划最佳用途。

筹资比筹集 GPU 容易得多

早在 2015 2008年,马斯克变得慧眼独特。 OpenAI 的创始人。但在 2018 一年一度的权力斗争之后(我们猜测这场斗争很可能会推动。 AI 模型所消耗的巨额资金,以及对于这种类型 AI 模型化治理思路有很大关系),马斯克离开 OpenAI 并且给微软一个机会。软体巨头携带大笔资金进驻,并推动软件巨头。 OpenAI 快速成长为一种开发生成级生成 AI 主导力量。面临这样的现实,马斯克果断地 2023 年 4 月成立 xAI 从此以后,这家创业公司也一直在努力筹集资金,争取资金。 GPU 配额,希望建立足够的抵抗力。 OpenAI/ 微软,谷歌,亚马逊云技术,Anthropic 等待知名厂商的计算基础设施。

而且,筹资显然是最简单的部分。

截至 5 月底,Andreessen Horowitz、红杉资本、Fidelity Management、Lightspeed Venture Partners、Tribe Capital、Valor Equity Partners、Vy Capital 和 Kingdom Holding(沙特王室控股公司)纷纷加入 xAI 总额 60 亿美元 B 轮融资,一举推动其融资总值的到来 64 亿美金。这是一个好的开始。幸运的是,马斯克从特斯拉的全球运营中获得了成功。 450 一亿美元的工资收入,所以这笔巨款可以随时投入到 xAI GPU 后续发展的身体。这是一个好的开始。幸运的是,马斯克从特斯拉的全球运营中获得了成功。 450 一亿美元的工资收入,所以这笔巨款可以随时投入到 xAI GPU 后续发展。(当然,更明智的做法是保留一部分作为特斯拉,X 和 SpaceX 的 GPU 采购基金。)

从特定的角度来看,特斯拉相当于一次性付清了马斯克。 2022 年 4 月收购 X 全部投入 440 一亿美元,同时也给了他额外的钱。 10 亿美金。这笔钱足以作为备用资金购买。 2.4 万只 GPU 集群。必须承认,特斯拉作为电动汽车的先驱力量,已经震撼了整个汽车行业, 2023 年销售额为 968 亿美元,其中净利润为亿美元 150 一亿美元,公司现在掌握的现金是 291 亿美金。但是即便在当今财富分配极其不公平的时代,450 一亿美元的收入仍然是一个相当离谱的薪酬计划。但是马斯克有他的大事要做,所以他主导的股东会愿意牺牲特斯拉的利益,拿出更多的资金来哄骗这个时代的骄傲。

然而,根据相同的市值逻辑,我们似乎也可以使用它。 6500 一亿美元买下摩根大通,而美国银行、阿布扎比、美联储等资金来源仍是我们可以说服的资金来源。这样,在明年,我们就可以给自己一点薪水,比收购成本高一点——比如 6750 亿美金。这样还清欠款后,我们还可以剩下。 250 十亿美元随意编辑...很抱歉跑题了,但是这一幕真的让人想起来很开心。

总而言之,从目前的情况来看,xAI 在计算、存储和网络方面必须表现出强烈的需求。

Grok-0 拥有大型语言模型 330 十亿参数,就是在 xAI 成立几个星期后就可以了 2023 年 8 每月开始训练。Grok-1 对话式有可响应提示词。 AI 功能,有着 3140 亿参数,于 2023 年 11 月上市。这个模型跟在后面 2024 年 3 月亮开源,很快 Grok-1.5 模型也正式亮相。与 Grok-1 相比,1.5 该版本具有较长的前后文窗口和较高的平均认知测试绩点。

能够看见,Grok-1.5 智力水平略低于谷歌,OpenAI 和 Anthropic 等待竞争者创建的类似模型。

即将推出的 Grok-2 模型将在 8 月内与您见面,本模型计划在月内与您见面。 2.4 万张英伟达 H100 GPU 在上面练习。据报道,该模型采用甲骨文云基础设施。(甲骨文已与甲骨文结合。 OpenAI 签署协议,允许其使用。 xAI 剩下的没有尽用 GPU 容量。)

在多条推文中,马斯克曾经说过,Grok-3 还将于今年年底问世,需要 10 万只英伟达 H100 GPU 在集群中接受训练,并将能力与 OpenAI 和微软正在开发的下一代 GPT-5 模型堪比。甲骨文和 xAI 也积极就 GPU 讨论协议的容量分配方式。但是三个星期前的价值 100 亿美元 GPU 集群交易破坏消息一出,马斯克立即决定改变方向,在田纳西州孟菲斯南部的一家老伊莱克斯工厂建立了“计算超级工厂”,以容纳他自己的 10 万只 GPU 集群。假如你正好在孟菲斯周围,下一步的情况可能会有点疯狂-因为 xAI 号称将占用 150 区域供电,兆瓦。

根据彭博社的报道,目前该厂已分配到该厂。 8 在接下来的几个月里,兆瓦供电有望增加到 50 兆瓦。而且要想继续超越这一数字,就必须经过田纳西河谷管理局的繁琐审查。

但是现在看来,除非英伟达愿意全力支持, 今年马斯克似乎不太可能。 12 在月前得到你所有的东西。 10 万张 H100 GPU。

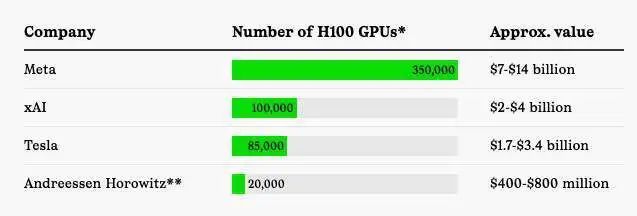

寻找英伟达的芯片公司名单很长,可能包括今天的大多数大型科技公司,但只有少数公司公开声称自己拥有多少。 H100 芯片。

据《The Information》报告,风险投资公司 Andreesen Horowitz 正囤积超出 2 万元昂贵的 GPU,它的作用是把它租给它 AI 创业公司以换取对方公司的股份。

OpenAI 而且还没有透露他们有多少? H100 芯片,但据《The Information》报道称,该公司租用了微软提供的专门用于培训的处理器集群,这是微软对微软提供的。 OpenAI 100 一部分亿美元投资。根据报道,这个训练集群的计算率相当于 12 万元 Nvidia 上一代的 A100 GPU,并且将在未来两年内花费。 50 亿美金从 Oracle 租用更多的训练集群。

一直在努力收集特斯拉的收集。 H100。今年 4 月份,马斯克在一次财务报告电话会议上表示,特斯拉希望在年底之前拥有它。 3.5 万至 8.5 万元 H100。

为了给 xAI 筹集 GPU,最近,马斯克也被特斯拉股东起诉,起诉他原本用于汽车制造商。 AI 训练基础设施 12,000 块 H100 芯片转给了 xAI。马斯克说,在昨天的特斯拉第二季度财务报告电话会议上,当被问及这一调配问题时, GPU 之所以被送到那里 xAI,因为“特斯拉的数据中心已经满了,实际上没有地方可以放置它们。”

10 万张 H100 单一集群, 谁有能力建造出来?

马斯克上周发了一条推文:

xAI、X、在当地时间凌晨,英伟达和各支持部门都做得很好,孟菲斯的集群训练已经在当地时间凌晨。 4:20 启动。

其单一 RDMA 在结构上承载 10 万张液冷 H100 GPU,它是世界上最强大的 AI 训练集群!

今年就要实现了 12 在月前训练出世界最强的世界。 AI 模型化目标,这一切无疑是一个显著的优势。

也许马斯克的这个系统最终会被称为 SuperCluster,也就是 Meta Platforms 对采购来说,不是自建的。 AI 在训练系统中指定名称。

此外 10 万张 GPU 恐怕这个结论只是一个愿景,也许到了 12 月时 xAI 能拿到的 GPU 总共也只有 2.5 万张。但是即便如此,这种规模还是足以训练出一套庞大的模型。我们看到的一些报告指出,孟菲斯非常集群。 2025 只有在年晚时期才能最终完成扩展,按照现在的情况来看。 GPU 就供应能力而言,这个说法其实是相当合理的。

另外,上线后,孟菲斯非常集群的供电也是个问题,但马斯克并没有说到底开始了多少张张。 H100。有网友讽刺说,马斯克的说法确实是在极端情况下建立起来的,比如只开始了。 1 个 GPU 练习,还有别的 99,999 个 GPU 没有足够的电源来连接。

现在只有 3.2 一万元上线,其他将在第四季度上线。如达到 10 万元 GPU,要不变电站提前完工,要不要需要大量这类设备。

同时,我们也可以服从 Supermicro 企业创始人兼 CEO Charles Liang 在推文中做一些推论,公司正负责为 xAI 在孟菲斯数据中心安排水冷设备:

我很高兴能和马斯克一起创造历史,和他的孟菲斯团队合作也是一次美好的经历!为了实现我们的目标,我们应该尽最大努力完美、快速、高效、环保地推进我们的工作——虽然我们需要付出很多努力,但我们也同样有意义和兴奋!

关于服务器基础设施的具体信息目前还不清楚,但是我们强烈怀疑该系统将采用八路。 HGX GPU 基板,而且属于 Supermicro 机架式系统,其设计灵活来自英伟达。 SuperPOD 配置方案,但同时又有独特的工程调整,以降低价格水平。选用八路 HGX 基板,该系统总计可容纳。 1.25 一万个节点,后端网络将承载 10 万张 GPU 和 10 一万个节点;前端网络也有 1.25 万个节点,即用于浏览集群中的数据和管理负载的节点。

瞻博网络CEO Rami Rahim 还讨论了该公司参与孟菲斯非常集群项目的情况:

祝贺马斯克,xAI 和 X!很高兴瞻博网络成为孟菲斯非常集群的一员,并且将我们的网络解决方案融入到这个创新项目中。

从这些文章的内容来看,瞻博似乎以某种方式赢得了孟菲斯非常集群的在线交易。考虑到 Arista Networks 和英伟达也是如此 AI 在集群网络方面有着浓厚的积累,马斯克最终选择瞻博实在令人惊讶。我们还没有服从 Arista 在那里可以看到任何与孟菲斯项目有关的消息;但是 5 月 22 日,英伟达在发其 2025 财年第一季度财务报告时,公司首席财务官 Colette Kress 曾经表示:

他说:“今年第一季度,我们开始瞄准。 AI 全新的发布经过优化 Spectrum-X 以太网络解决方案。其中包括我们的 Spectrum-4 交换机、BlueField-3 DPU 以及新的软件技术,用于克服以太网承载。 AI 工作负荷所面临的难题, AI 处理提供 1.6 网络性能是传统以太网的两倍。

Spectrum-X 销售额也在不断增长,吸引了众多顾客,其中包括一个巨大的 10 万 GPU 集群项目。Spectrum-X 为英伟达网络开辟了一个全新的市场,促使纯以太网数据中心也能容纳大规模的市场 AI 类负荷。我们预期 Spectrum-X 今后一年将跃升至价值数十亿美元的产品线。

首先要承认的是,这个世界上肯定没有多少项目可以大胆地叫出“10”。 万张 GPU”这么夸张的体积,所以英伟达在 5 月份声明中提到的几乎一定是孟菲斯非常集群。结合马斯克最近对该系统的评价,我们认为英伟达应该是通过 Spectrum-X 该设备获得了后端(或东西向)网络部分,而瞻博则负责实现前端(或南北向)网络部分。Arista 那儿没有任何声音。

但是到目前为止,我们还不清楚孟菲斯非常集群的具体存储解决方案。这可能是基于它 Supermicro 闪存加硬盘混合原始存储阵列,可以操作随机数量的文件系统;也可能是 Vast Data 或是 Pure Storage 提供全闪存阵列。但是如果非要选择一个胜算最大的方案,那么我们就会大胆地感到 Vast Data 这笔交易应该参与进来,并且获得了相当大的存储订单。然而,这种猜测并没有明确的依据,只是在过去几年的高性能计算和高性能计算中,根据公司的大规模存储阵列。 AI 市场吸引力在该领域表现出的假设。

参考链接:

https://www.nextplatform.com/2024/07/30/so-who-is-building-that-100000-gpu-cluster-for-xai/

https://sherwood.news/tech/companies-hoarding-nvidia-gpu-chips-meta-tesla/

https://techcrunch.com/2024/06/13/tesla-shareholders-sue-musk-for-starting-competing-ai-company/

https://www.youtube.com/watch?v=ktkCRVxTuEI&t=1325s

https://digitalassets.tesla.com/tesla-contents/image/upload/IR/TSLA-Q2-2024-Update.pdf

https://x.com/dylan522p//status/1815710429089509675

https://www.reddit.com/r/mlscaling/comments/1ea3vu1/xais_100k_h100_computing_cluster_goes_online/

本文来自微信微信官方账号“InfoQ”,作者:核子可乐,Tina,36氪经授权发布。

本文仅代表作者观点,版权归原创者所有,如需转载请在文中注明来源及作者名字。

免责声明:本文系转载编辑文章,仅作分享之用。如分享内容、图片侵犯到您的版权或非授权发布,请及时与我们联系进行审核处理或删除,您可以发送材料至邮箱:service@tojoy.com